Как найти дисперсию?

Полезная страница? Сохрани или расскажи друзьям

Дисперсия — это мера разброса значений случайной величины $X$ относительно ее математического ожидания $M(X)$ (см. как найти математическое ожидание случайной величины). Дисперсия показывает, насколько в среднем значения сосредоточены, сгруппированы около $M(X)$: если дисперсия маленькая — значения сравнительно близки друг к другу, если большая — далеки друг от друга (см. примеры нахождения дисперсии ниже).

Если случайная величина описывает физические объекты с некоторой размерностью (метры, секунды, килограммы и т.п.), то дисперсия будет выражаться в квадратных единицах (метры в квадрате, секунды в квадрате и т.п.). Ясно, что это не совсем удобно для анализа, поэтому часто вычисляют также корень из дисперсии — среднеквадратическое отклонение $sigma(X)=sqrt{D(X)}$, которое имеет ту же размерность, что и исходная величина и также описывает разброс.

Еще одно формальное определение дисперсии звучит так: «Дисперсия — это второй центральный момент случайной величины» (напомним, что первый начальный момент — это как раз математическое ожидание).

Нужна помощь? Решаем теорию вероятностей на отлично

Формула дисперсии случайной величины

Дисперсия случайной величины Х вычисляется по следующей формуле:

$$

D(X)=M(X-M(X))^2,

$$

которую также часто записывают в более удобном для расчетов виде:

$$

D(X)=M(X^2)-(M(X))^2.

$$

Эта универсальная формула для дисперсии может быть расписана более подробно для двух случаев.

Если мы имеем дело с дискретной случайной величиной (которая задана перечнем значений $x_i$ и соответствующих вероятностей $p_i$), то формула принимает вид:

$$

D(X)=sum_{i=1}^{n}{x_i^2 cdot p_i}-left(sum_{i=1}^{n}{x_i cdot p_i} right)^2.

$$

Если же речь идет о непрерывной случайной величине (заданной плотностью вероятностей $f(x)$ в общем случае), формула дисперсии Х выглядит следующим образом:

$$

D(X)=int_{-infty}^{+infty} f(x) cdot x^2 dx — left( int_{-infty}^{+infty} f(x) cdot x dx right)^2.

$$

Пример нахождения дисперсии

Рассмотрим простые примеры, показывающие как найти дисперсию по формулам, введеным выше.

Пример 1. Вычислить и сравнить дисперсию двух законов распределения:

$$

x_i quad 1 quad 2 \

p_i quad 0.5 quad 0.5

$$

и

$$

y_i quad -10 quad 10 \

p_i quad 0.5 quad 0.5

$$

Для убедительности и наглядности расчетов мы взяли простые распределения с двумя значениями и одинаковыми вероятностями. Но в первом случае значения случайной величины расположены рядом (1 и 2), а во втором — дальше друг от друга (-10 и 10). А теперь посмотрим, насколько различаются дисперсии:

$$

D(X)=sum_{i=1}^{n}{x_i^2 cdot p_i}-left(sum_{i=1}^{n}{x_i cdot p_i} right)^2 =\

= 1^2cdot 0.5 + 2^2 cdot 0.5 — (1cdot 0.5 + 2cdot 0.5)^2=2.5-1.5^2=0.25.

$$

$$

D(Y)=sum_{i=1}^{n}{y_i^2 cdot p_i}-left(sum_{i=1}^{n}{y_i cdot p_i} right)^2 =\

= (-10)^2cdot 0.5 + 10^2 cdot 0.5 — (-10cdot 0.5 + 10cdot 0.5)^2=100-0^2=100.

$$

Итак, значения случайных величин различались на 1 и 20 единиц, тогда как дисперсия показывает меру разброса в 0.25 и 100. Если перейти к среднеквадратическому отклонению, получим $sigma(X)=0.5$, $sigma(Y)=10$, то есть вполне ожидаемые величины: в первом случае значения отстоят в обе стороны на 0.5 от среднего 1.5, а во втором — на 10 единиц от среднего 0.

Ясно, что для более сложных распределений, где число значений больше и вероятности не одинаковы, картина будет более сложной, прямой зависимости от значений уже не будет (но будет как раз оценка разброса).

Пример 2. Найти дисперсию случайной величины Х, заданной дискретным рядом распределения:

$$

x_i quad -1 quad 2 quad 5 quad 10 quad 20 \

p_i quad 0.1 quad 0.2 quad 0.3 quad 0.3 quad 0.1

$$

Снова используем формулу для дисперсии дискретной случайной величины:

$$

D(X)=M(X^2)-(M(X))^2.

$$

В случае, когда значений много, удобно разбить вычисления по шагам. Сначала найдем математическое ожидание:

$$

M(X)=sum_{i=1}^{n}{x_i cdot p_i} =-1cdot 0.1 + 2 cdot 0.2 +5cdot 0.3 +10cdot 0.3+20cdot 0.1=6.8.

$$

Потом математическое ожидание квадрата случайной величины:

$$

M(X^2)=sum_{i=1}^{n}{x_i^2 cdot p_i}

= (-1)^2cdot 0.1 + 2^2 cdot 0.2 +5^2cdot 0.3 +10^2cdot 0.3+20^2cdot 0.1=78.4.

$$

А потом подставим все в формулу для дисперсии:

$$

D(X)=M(X^2)-(M(X))^2=78.4-6.8^2=32.16.

$$

Дисперсия равна 32.16 квадратных единиц.

Пример 3. Найти дисперсию по заданному непрерывному закону распределения случайной величины Х, заданному плотностью $f(x)=x/18$ при $x in(0,6)$ и $f(x)=0$ в остальных точках.

Используем для расчета формулу дисперсии непрерывной случайной величины:

$$

D(X)=int_{-infty}^{+infty} f(x) cdot x^2 dx — left( int_{-infty}^{+infty} f(x) cdot x dx right)^2.

$$

Вычислим сначала математическое ожидание:

$$

M(X)=int_{-infty}^{+infty} f(x) cdot x dx = int_{0}^{6} frac{x}{18} cdot x dx = int_{0}^{6} frac{x^2}{18} dx =

left.frac{x^3}{54} right|_0^6=frac{6^3}{54} = 4.

$$

Теперь вычислим

$$

M(X^2)=int_{-infty}^{+infty} f(x) cdot x^2 dx = int_{0}^{6} frac{x}{18} cdot x^2 dx = int_{0}^{6} frac{x^3}{18} dx = left.frac{x^4}{72} right|_0^6=frac{6^4}{72} = 18.

$$

Подставляем:

$$

D(X)=M(X^2)-(M(X))^2=18-4^2=2.

$$

Дисперсия равна 2.

Другие задачи с решениями по ТВ

Подробно решим ваши задачи на вычисление дисперсии

Вычисление дисперсии онлайн

Как найти дисперсию онлайн для дискретной случайной величины? Используйте калькулятор ниже.

- Введите число значений случайной величины К.

- Появится форма ввода для значений $x_i$ и соответствующих вероятностей $p_i$ (десятичные дроби вводятся с разделителем точкой, например: -10.3 или 0.5). Введите нужные значения (проверьте, что сумма вероятностей равна 1, то есть закон распределения корректный).

- Нажмите на кнопку «Вычислить».

- Калькулятор покажет вычисленное математическое ожидание $M(X)$ и затем искомое значение дисперсии $D(X)$.

Видео. Полезные ссылки

Видеоролики: что такое дисперсия и как найти дисперсию

Если вам нужно более подробное объяснение того, что такое дисперсия, как она вычисляется и какими свойствами обладает, рекомендую два видео (для дискретной и непрерывной случайной величины соответственно).

Лучшее спасибо — порекомендовать эту страницу

Полезные ссылки

Не забывайте сначала прочитать том, как найти математическое ожидание. А тут можно вычислить также СКО: Калькулятор математического ожидания, дисперсии и среднего квадратического отклонения.

Что еще может пригодиться? Например, для изучения основ теории вероятностей — онлайн учебник по ТВ. Для закрепления материала — еще примеры решений задач по теории вероятностей.

А если у вас есть задачи, которые надо срочно сделать, а времени нет? Можете поискать готовые решения в решебнике или заказать в МатБюро:

Непрерывная случайная величина

- Краткая теория

- Примеры решения задач

- Задачи контрольных и самостоятельных работ

Краткая теория

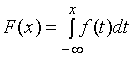

Случайная величина называется непрерывной, если ее функция

распределения

непрерывно дифференцируема. В этом случае

имеет производную, которую обозначим через

– плотность распределения вероятностей.

Плотностью распределения вероятностей непрерывной случайной

величины

называются функцию

– первую производную от функции распределения

:

Из этого определения следует, что функция распределения является

первообразной для плотности распределения.

Заметим, что для описания распределения вероятностей дискретной

случайной величины плотность распределения неприменима.

Вероятность того, что непрерывная случайная величина

примет значение, принадлежащее интервалу

равна определенному интегралу от плотности

распределения, взятому в пределах от

до

.

Зная плотность распределения

,

можно найти функцию распределения

по формуле:

Числовые характеристики непрерывной случайной величины

Математическое ожидание непрерывной случайной величины

,

возможные значения которой принадлежат всей оси

,

определяется равенством:

где

– плотность распределения случайной величины

.

Предполагается, что интеграл сходится абсолютно.

В частности, если все возможные значения принадлежат интервалу

,

то:

Все свойства математического ожидания, указанные для

дискретных случайных величин, сохраняются и для непрерывных величин.

Дисперсия непрерывной случайной величины

,

возможные значения которой принадлежат всей оси

,

определяется равенством:

или равносильным равенством:

В частности, если все возможные значения

принадлежат интервалу

,

то

или

Все свойства дисперсии, указанные для дискретных случайных

величин, сохраняются и для непрерывных случайных величин.

Среднее квадратическое отклонение

непрерывной случайной величины определяется так же, как и для дискретной

величины:

При решении задач, которые выдвигает практика, приходится

сталкиваться с различными распределениями непрерывных случайных величин.

Основные законы распределения непрерывных случайных величин

- Нормальный закон распределения СВ

- Показательный закон распределения СВ

- Равномерный закон распределения СВ

Примеры решения задач

Пример 1

Дана

функция распределения F(х) непрерывной случайной величины

Х.

Найти плотность распределения вероятностей f(x), математическое ожидание M(X), дисперсию D(X) и вероятность попадания X на отрезок [a,b]. Построить графики функций F(x) и f(x).

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Плотность

распределения вероятностей:

Математическое

ожидание:

Дисперсию

можно найти по формуле:

Вероятность

попадания на отрезок:

Построим графики функций F(x) и f(x).

График плотности

распределения

График функции

распределения

Пример 2

Случайная величина Х задана плотностью вероятности

Определить константу c, математическое ожидание, дисперсию, функцию распределения величины X, а также вероятность ее попадания в интервал [0;0,25].

Решение

Константу

определим,

используя свойство плотности вероятности:

В нашем случае:

Найдем математическое

ожидание:

Найдем дисперсию:

Искомая дисперсия:

Найдем функцию

распределения:

для

:

для

:

для

:

Искомая функция

распределения:

Вероятность попадания

в интервал

:

Пример 3

Плотность

распределения непрерывной случайной величины

имеет вид:

Найти:

а)

параметр

;

б)

функцию распределения

;

в)

вероятность попадания случайной величины

в интервал

г)

математическое ожидание

и дисперсию

д)

построить графики функций

и

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

а)

Постоянный параметр

найдем из

свойства плотности вероятности:

В нашем

случае эта формула имеет вид:

б)

Функцию распределения

найдем из

формулы:

Учитывая

свойства

, сразу можем отметить,

что:

Остается

найти выражение для

, когда

принадлежит

интервалу

:

Получаем:

в)

Вероятность

попадания случайной величины

в интервал

:

г)

Математическое ожидание находим по формуле:

Для

нашего примера:

Дисперсию

можно найти по формуле:

Среднее

квадратическое отклонение равно квадратному корню из дисперсии:

д) Построим графики

и

:

График плотности вероятности f(x)

График функции распределения F(x)

Задачи контрольных и самостоятельных работ

Задача 1

НСВ на всей

числовой оси oX задана интегральной функцией:

Найти

вероятность, что в результате 2 испытаний случайная величина примет значение,

заключенное в интервале (0;4).

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 2

Дана

дифференциальная функция непрерывной СВ Х. Найти: постоянную С, интегральную

функцию F(x).

Задача 3

Случайная

величина Х задана функцией распределения F(x):

а) Найти

плотность вероятности СВ Х — f(x).

б) Построить графики

f(x), F(x).

в) Найти вероятность

попадания НСВ в интервал (0; 3).

Задача 4

Дифференциальная

функция НСВ Х задана на всей числовой оси ОХ:

Найти:

а) постоянный

параметр С=const;

б) функцию

распределения F(x);

в) вероятность

попадания в интервал -4<X<4;

г) построить

графики f(x), F(X).

Задача 5

Случайная величина

Х задана функцией распределения F(x):

а) Найти

плотность вероятности СВ Х — f(x).

б) Построить

графики f(x), F(x).

в) Найти

вероятность попадания НСВ в интервал (0;π⁄2).

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 6

НСВ X имеет

плотность вероятности (закон Коши)

а) постоянный

параметр С=const;

б) функцию

распределения F(x);

в) вероятность

попадания в интервал -1<X<1;

г) построить

графики f(x), F(X).

Задача 7

Случайная

величина X задана интегральной F(x) или дифференциальной f(x)

функцией. Требуется:

а) найти

параметр C;

б) при

заданной интегральной функции F(x) найти дифференциальную

функцию f(x), а при заданной дифференциальной функции f(x) найти интегральную

функцию F(x);

в)

построить графики функций F(x) и f(x);

г) найти

математическое ожидание M(X), дисперсию D(X) и

среднее квадратическое отклонение σ(X);

д)

вычислить вероятность попадания в интервал P(a≤x≤b);

е)

определить, квантилем какого порядка является точка xp;

ж)

вычислить квантиль порядка p

Задание 8

Дана

интегральная функция распределения случайной величины X. Найти дифференциальную

функцию распределения, математическое ожидание M(X), дисперсию D(X) и

среднее квадратическое отклонение.

Задача 9

Случайная

величина X задана интегральной функцией распределения

Найти

дифференциальную функцию, математическое ожидание и дисперсию X.

Задача 10

СВ Х

задана функцией распределения F(x). Найдите вероятность

того, что в результате испытаний НСВ Х попадет в заданный интервал (0;0,5).

Постройте график функции распределения. Найдите плотность вероятности НСВ Х и

постройте ее график. Найдите числовые

характеристики НСВ Х, если

- Краткая теория

- Примеры решения задач

- Задачи контрольных и самостоятельных работ

-

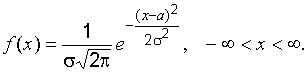

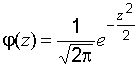

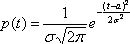

Нормальное распределение, его математическое ожидание, дисперсия.

Случайная

величина называется

распределенной по нормальному закону,

если ее плотность вероятности имеет

вид:

Здесь математическое

ожидание, дисперсия,

среднее

квадратическое отклонение. Как и

ранее,

однако, этот интеграл вычисляется

численными методами. Чтобы упростить

эту процедуру, пользуются преобразованием

случайной величины и

правилом сохранения элемента вероятности ,

где плотность

распределения вероятности случайной

величины :

Как

видим, индивидуальные числовые

характеристики распределения

(математическое ожидание и дисперсия)

в последнее выражение не входят, т.е.

вышеуказанным преобразованием нормальная

случайная величина приведена

к нормальной стандартной случайной

величине с

параметрами 0 (математическое ожидание)

и 1 (дисперсия). Дифференциальная и

интегральная функции стандартного

нормального распределения табулированы

(имеются таблицы), что существенно

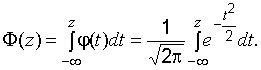

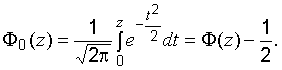

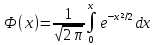

облегчает вычисления. Интегральная

функция распределения обозначается ,

Часто

используют функцию Лапласа:

Очевидны

следующие свойства:

где .

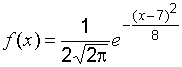

Пример.

Нормальная

случайная величина задана

математическим ожиданием и

средним квадратическим отклонением .

Записать соответствующую дифференциальную

функцию, схематично изобразить ее

график, вычислить вероятность попадания

случайной величины в

интервал

Решение:

Записать дифференциальную функцию

нормальной случайной величины с

заданными значениями математического

ожидания и дисперсии значит в общее

выражение для дифференциальной функции

нормальной случайной величины подставить

заданные и

.

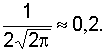

Например, если ,

то получим

При

изображении этой функции на схематичном

графике следует учесть, что эта функция

имеет максимум при ,

симметрична относительно (это

видно непосредственно из приведенной

выше формулы) и стремится к нулю при .

Однако правило (вероятность

того, что случайная величина примет

значение, по модулю отличающееся от

математического ожидания на или

более, пренебрежимо мала – составляет

всего около 0,0027) позволяет нам закончить

правую ветвь в точке а

левую – в точке Высота

максимума в точке составит

надо учесть, что перегибы ветвей будут

иметь место в точках

Вероятность

попадания случайной величины в

интервал вычислим

так:

При

этом следует воспользоваться таблицами

функции стандартного нормального

распределения или

функции Лапласа .

36. Нормальная кривая.

Центральная

предельная теорема. Если

случайная величина Х представляет собой

сумму очень большого числа взаимно

независимых случайных величин, влияние

каждой из которых на всю сумму ничтожно

мало, то Х имеет распределение, близкое

к нормальному.

Говорят,

что случайная величина Х распределена

по нормальному

закону с

параметрами а и ,

если плотность распределения вероятностей

имеет вид:

–¥<t<¥.

Вероятностный

смысл параметров а и таков: а –

математическое ожидание случайной

величины Х, s –

среднее квадратическое отклонение

величины.

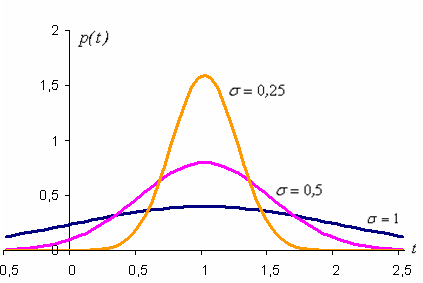

Иногда

такой закон распределения

называют Гауссовским. График плотности

нормального распределения называют

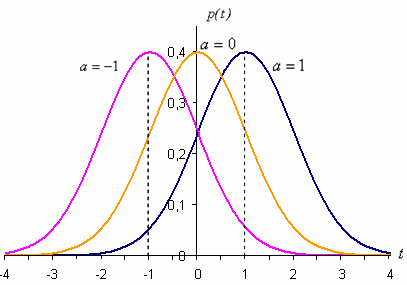

нормальной кривой (кривой Гаусса). На

рисунке изображены нормальные кривые

с параметрами а=1

и ,

,

.

Из

рисунка видно, что положение пика кривых

определяется параметром а=1,

а параметр s (среднее квадратическое отклонение)

характеризует форму нормальной кривой.

При увеличении s уменьшается

максимум кривой распределения, сама

кривая становится более пологой,

растягиваясь вдоль оси абсцисс. И,

наоборот, при уменьшении s возрастает

максимум кривой распределения, сама

кривая становится более «островершинной».

Площадь, ограниченная любой нормальной

кривой и осью абсцисс, равна единице.

Параметр а(математическое

ожидание величины) определяет положение

максимума на оси абсцисс, не влияя на

форму кривой. На рисeyrt

ниже показаны нормальные кривые с

одинаковым средним квадратическим отклонением и

разными математическими

ожиданиями а=–1, а=0, а=1.

Нормальное

распределение с параметрами а=0

и называется нормированным.

-

Вероятность

попадания в заданный интервал нормальной

случайной величины.

Вероятность

того, что Х примет значение, принадлежащее

интервалу (α,β)

P(α<X<β)=Ф((β-a)/σ)-Ф((α-a)/σ),

где

– функция Лапласа.

-

Ф(-∞)=0

-

Ф(+∞)=1

-

Ф(-х)=1-Ф(х)

P(mx-l<x<mx+l)=Ф(l/σ)-Ф(-l/σ)=2Ф(l/σ)-1

38.

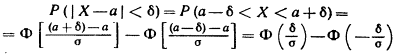

Вычисление вероятности заданного

отклонения.

Часто

требуется вычислить вероятность того,

что отклонение нормально распределенной

случайной величины Х по

абсолютной величине меньше заданного

положительного числа d, т.

е. требуется найти вероятность

осуществления неравенства |x —а|<d.

Заменим

это неравенство равносильным ему двойным

неравенством

Тогда

получим:

Приняв

во внимание равенство:

(функция

Лапласа—нечетная), окончательно имеем

Вероятность

заданного отклонения равна

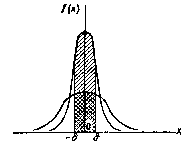

На

рисунке наглядно показано, что если две

случайные величины нормально распределены

и а = 0,

то вероятность принять значение,

принадлежащее интервалу (-d,d),больше

у той величины, которая имеет меньшее

значение d. Этот

факт полностью соответствует вероятностному

смыслу параметра s .

Пример.

Случайная величина Х распределена

нормально. Математическое ожидание и

среднее квадратическое

отклонение Х соответственно

равны 20 и 10. Найти вероятность того, что

отклонение по абсолютной величине будет

меньше трех.

Решение: Воспользуемся

формулой

По

условию ,

тогда

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Функции случайных величин

Определение функции случайных величин. Функция дискретного случайного аргумента и ее числовые характеристики. Функция непрерывного случайного аргумента и ее числовые характеристики. Функции двух случайных аргументов. Определение функции распределения вероятностей и плотности для функции двух случайных аргументов.

Закон распределения вероятностей функции одной случайной величины

При решении задач, связанных с оценкой точности работы различных автоматических систем, точности производства отдельных элементов систем и др., часто приходится рассматривать функции одной или нескольких случайных величин. Такие функции также являются случайными величинами. Поэтому при решении задач необходимо знать законы распределения фигурирующих в задаче случайных величин. При этом обычно известны закон распределения системы случайных аргументов и функциональная зависимость.

Таким образом, возникает задача, которую можно сформулировать так.

Дана система случайных величин , закон распределения которой известен. Рассматривается некоторая случайная величина Y как функция данных случайных величин:

(6.1)

Требуется определить закон распределения случайной величины , зная вид функций (6.1) и закон совместного распределения ее аргументов.

Рассмотрим задачу о законе распределения функции одного случайного аргумента

Пусть — дискретная случайная величина, имеющая ряд распределения

Тогда также дискретная случайная величина с возможными значениями

. Если все значения

различны, то для каждого

события

и

тождественны. Следовательно,

и искомый ряд распределения имеет вид

Если же среди чисел есть одинаковые, то каждой группе одинаковых значений

нужно отвести в таблице один столбец и соответствующие вероятности сложить.

Для непрерывных случайных величин задача ставится так: зная плотность распределения случайной величины

, найти плотность распределения

случайной величины

. При решении поставленной задачи рассмотрим два случая.

Предположим сначала, что функция является монотонно возрастающей, непрерывной и дифференцируемой на интервале

, на котором лежат все возможные значения величины

. Тогда обратная функция

существует, при этом являясь также монотонно возрастающей, непрерывной и дифференцируемой. В этом случае получаем

(6.2)

Пример 1. Случайная величина распределена с плотностью

Найти закон распределения случайной величины , связанной с величиной

зависимостью

.

Решение. Так как функция монотонна на промежутке

, то можно применить формулу (6.2). Обратная функция по отношению к функции

есть

, ее производная

. Следовательно,

Рассмотрим случай немонотонной функции. Пусть функция такова, что обратная функция

неоднозначна, т. е. одному значению величины

соответствует несколько значений аргумента

, которые обозначим

, где

— число участков, на которых функция

изменяется монотонно. Тогда

(6.3)

Пример 2. В условиях примера 1 найти распределение случайной величины .

Решение. Обратная функция неоднозначна. Одному значению аргумента

соответствуют два значения функции

Применяя формулу (6.3), получаем:

Закон распределения функции двух случайных величин

Пусть случайная величина является функцией двух случайных величин, образующих систему

, т. е.

. Задача состоит в том, чтобы по известному распределению системы

найти распределение случайной величины

.

Пусть — плотность распределения системы случайных величин

. Введем в рассмотрение новую величину

, равную

, и рассмотрим систему уравнений

Будем полагать, что эта система однозначно разрешима относительно

и удовлетворяет условиям дифференцируемости.

Плотность распределения случайной величины

Заметим, что рассуждения не изменяются, если введенную новую величину положить равной

.

Математическое ожидание функции случайных величин

На практике часто встречаются случаи, когда нет особой надобности полностью определять закон распределения функции случайных величин, а достаточно только указать его числовые характеристики. Таким образом, возникает задача определения числовых характеристик функций случайных величин помимо законов распределения этих функций.

Пусть случайная величина является функцией случайного аргумента

с заданным законом распределения

Требуется, не находя закона распределения величины , определить ее математическое ожидание

Пусть — дискретная случайная величина, имеющая ряд распределения

Составим таблицу значений величины и вероятностей этих значений:

Эта таблица не является рядом распределения случайной величины , так как в общем случае некоторые из значений могут совпадать между собой и значения в верхней строке не обязательно идут в возрастающем порядке. Однако математическое ожидание случайной величины

можно определить по формуле

(6.4)

так как величина, определяемая формулой (6.4), не может измениться от того, что под знаком суммы некоторые члены будут заранее объединены, а порядок членов изменен.

Формула (6.4) не содержит в явном виде закон распределения самой функции , а содержит только закон распределения аргумента

. Таким образом, для определения математического ожидания функции

вовсе не требуется знать закон распределения функции

, а достаточно знать закон распределения аргумента

.

Для непрерывной случайной величины математическое ожидание вычисляется по формуле

где — плотность распределения вероятностей случайной величины

.

Рассмотрим случаи, когда для нахождения математического ожидания функции случайных аргументов не требуется знание даже законов распределения аргументов, а достаточно знать только некоторые их числовые характеристики. Сформулируем эти случаи в виде теорем.

Теорема 6.1. Математическое ожидание суммы как зависимых, так и независимых двух случайных величин равно сумме математических ожиданий этих величин:

Теорема 6.2. Математическое ожидание произведения двух случайных величин равно произведению их математических ожиданий плюс корреляционный момент:

Следствие 6.1. Математическое ожидание произведения двух некоррелированных случайных величин равно произведению их математических ожиданий.

Следствие 6.2. Математическое ожидание произведения двух независимых случайных величин равно произведению их математических ожиданий.

Дисперсия функции случайных величин

По определению дисперсии имеем . Следовательно,

, где

.

Приведем расчетные формулы только для случая непрерывных случайных аргументов. Для функции одного случайного аргумента дисперсия выражается формулой

(6.5)

где — математическое ожидание функции

;

— плотность распределения величины

.

Формулу (6.5) можно заменить на следующую:

Рассмотрим теоремы о дисперсиях, которые играют важную роль в теории вероятностей и ее приложениях.

Теорема 6.3. Дисперсия суммы случайных величин равна сумме дисперсий этих величин плюс удвоенная сумма корреляционных моментов каждой из слагаемых величин со всеми последующими:

Следствие 6.3. Дисперсия суммы некоррелированных случайных величин равна сумме дисперсий слагаемых:

Теорема 6.4. Дисперсия произведения двух независимых случайных величин вычисляется по формуле

Корреляционный момент функций случайных величин

Согласно определению корреляционного момента двух случайных величин и

, имеем

Раскрывая скобки и применяя свойства математического ожидания, получаем

(6.6)

Рассмотрим две функции случайной величины

Согласно формуле (6.6)

отсюда

т.е. корреляционный момент двух функций случайных величин равен математическому ожиданию произведения этих функций минус произведение из математических ожиданий.

Рассмотрим основные свойства корреляционного момента и коэффициента корреляции.

Свойство 1. От прибавления к случайным величинам постоянных величин корреляционный момент и коэффициент корреляции не изменяются.

Свойство 2. Для любых случайных величин и

абсолютная величина корреляционного момента не превосходит среднего геометрического дисперсий данных величин:

где — средние квадратические отклонения величин

и

.

Следствие 6.5. Для любых случайных величин и

абсолютная величина коэффициента корреляции не превосходит единицы:

Математический форум (помощь с решением задач, обсуждение вопросов по математике).

Если заметили ошибку, опечатку или есть предложения, напишите в комментариях.

Числовые характеристики распределения вероятностей. Математическое ожидание, дисперсия и стандартное отклонение

- Закон распределения дискретной случайной величины

- Математическое ожидание

- Дисперсия

- Среднее квадратичное отклонение

- Правило трёх сигм

- Примеры

п.1. Закон распределения дискретной случайной величины

Законом распределения дискретной случайной величины называют соответствие между полученными на опыте значениями этой величины X= {xi} и их вероятностями pi = P(xi).

При этом сумма всех вероятностей равна 1: (mathrm{sum_{i=1}^n p_i=1})

Закон распределения можно задать таблицей, графиком или аналитически (в виде формулы).

Например:

Закон распределения случайной величины X = {0;1;2;3}, равной числу выпадения орлов при 3 бросках монеты, аналитически задаётся формулой: $$ mathrm{ p_i=P(x_i)=P_3(i)=frac{C_3^{i}}{2^3}, i={0;1;2;3} } $$

В табличном виде:

|

xi |

pi |

|

0 |

1/8 |

|

1 |

3/8 |

|

2 |

3/8 |

|

3 |

1/8 |

В виде графика:

п.2. Математическое ожидание

Математическое ожидание дискретной случайной величины X = {xi} равно сумме произведений всех возможных значений xi на соответствующие вероятности pi: $$ mathrm{ M(X)=x_1p_1+x_2p_2+…+x_{n}p_{n}=sum_{i=1}^n x_{i}p_{i} } $$ Математическое ожидание является средним значением величины X.

Свойства математического ожидания

1) Размерность математического ожидания равна размерности случайной величины.

2) Математическое ожидание может быть любым действительным числом: положительным, равным 0, отрицательным.

3) Математическое ожидание постоянной величины равно этой постоянной:

M(C) = C

4) Математическое ожидание суммы независимых случайных величин равно сумме математических ожиданий:

M(X + Y) = M(X) + M(Y)

5) Математическое ожидание произведения двух независимых случайных величин равно произведению математических ожиданий:

M(XY) = M(X) · M(Y)

6) Постоянный множитель можно вынести за знак математического ожидания:

M(CX) = C · M(X)

Например:

Пусть в результате экспериментов получено следующее распределение случайной величины X – числа появления белых шаров (см. пример 1, §40 данного справочника):

| Число белых шаров, xi | 0 | 1 | 2 | 3 | 4 | 5 |

| pi | (mathrm{C_5^0q^5}) | (mathrm{C_5^1pq^4}) | (mathrm{C_5^2p^2q^3}) | (mathrm{C_5^3p^3q^2}) | (mathrm{C_5^4p^4q}) | (mathrm{C_5^5p^5}) |

| 0,0074 | 0,0618 | 0,2060 | 0,3433 | 0,2861 | 0,0954 |

Найдём математическое ожидание для данного распределения:

M(X) = 0 · 0,0074 + 1 · 0,0618 + … + 5 · 0,0954 = 3,125

п.3. Дисперсия

Дисперсия дискретной случайной величины X = {xi} – это математическое ожидание квадрата отклонения случайной величины от её математического ожидания: $$ mathrm{ D(X)=M(X-M(X))^2 } $$ На практике дисперсия рассчитывается по формуле: $$ mathrm{ D(X)=M(X)^2-M^2(X)=sum_{i=1}^n x_i^2p_i-M^2(X) } $$

Свойства дисперсии

1) Размерность дисперсии равна квадрату размерности случайной величины.

2) Дисперсия может быть любым неотрицательным действительным числом.

3) Дисперсия постоянной величины равна нулю:

D(C) = 0

4) Дисперсия суммы независимых случайных величин равна сумме дисперсий:

D(X + Y) = D(X) + D(Y)

5) Постоянный множитель можно вынести за знак дисперсии:

D(CX) = C2 · D(X)

Например:

Продолжим исследование и найдём дисперсию для распределения случайной величины X – числа появления белых шаров. Составим расчётную таблицу:

pi

0,0074

0,0618

0,2060

0,3433

0,2861

0,0954

1

xip1

0

0,0618

0,4120

1,0300

1,1444

0,4768

3,125

(mathrm{x_i^2})

0

1

4

9

16

25

–

(mathrm{x_i^2p_i})

0

0,0618

0,8240

3,0899

4,5776

2,3842

10,9375

Получаем: D(X) = 10,9375 – 3,1252 ≈ 1,1719.

п.4. Среднее квадратичное отклонение

Среднее квадратичное отклонение (СКО) дискретной случайной величины X = {xi} – это корень квадратный от дисперсии: $$ mathrm{ sigma(X)=sqrt{D(X)} } $$ СКО характеризует степень отклонения случайной величины от среднего значения.

Свойства СКО

1) Размерность СКО равна размерности случайной величины.

2) СКО может быть любым неотрицательным действительным числом.

3) СКО постоянной величины равно нулю:

σ(C) = 0

4) Постоянный множитель можно вынести за знак СКО:

σ(CX) = C · σ(X)

п.5. Правило трёх сигм

Большое количество случайных величин, измеряемых в экспериментах (например, в школьных лабораторных работах), имеет так называемое нормальное распределение.

В частности, при больших n, биномиальное распределение можно с хорошей точностью описывать как нормальное с M(X) = np и (mathrm{sigma(X)=sqrt{npq}}).

График плотности нормального распределения p(x) похож на колокол, с максимумом, соответствующим M(X) = Xcp – среднему значению измеряемой величины.

Величина СКО σ(X) характеризует степень отклонения X от среднего значения M(X).

Если величина X имеет нормальное распределение, то в пределах

±σ лежит 68,26% значений, принимаемых этой величиной

±2σ лежит 95,44% значений, принимаемых этой величиной

±3σ лежит 99,72% значений, принимаемых этой величиной

Вероятность того, что нормально распределённая величина примет значение, отклоняющееся от среднего больше, чем на «три сигмы», равна 0,28%, т.е. пренебрежимо мала.

п.6. Примеры

Пример 1. Найдите математическое ожидание, дисперсию и СКО при бросании кубика.

Закон распределения величины X – очки на верхней грани при бросании кубика и расчётная таблица:

pi

1/6

1/6

1/6

1/6

1/6

1/6

1

xip1

1/6

1/3

1/2

2/3

5/6

1

3,5

(mathrm{x_i^2})

1

4

9

16

25

36

–

(mathrm{x_i^2p_i})

(mathrm{frac16})

(mathrm{frac23})

(mathrm{1frac12})

(mathrm{2frac23})

(mathrm{4frac16})

6

(mathrm{15frac16})

Получаем: begin{gather*} mathrm{ M(X)=sum_{i=1}^6 x_ip_i=3,5 }\ mathrm{ D(X)=sum_{i=1}^6 x_i^2p_i-M^2(X)=15frac16-3,5^3=2frac{11}{12} }\ mathrm{ sigma(X)=sqrt{D(X)}=sqrt{2frac{11}{12}}approx 1,7 } end{gather*} Ответ: (mathrm{M(X)=3,5; D(X)=2frac{11}{12}; sigma(X)approx 1,7}).

Пример 2*. Найти математическое ожидание, дисперсию и СКО суммы очков при бросании двух кубиков.

Используем свойства мат.ожиданий и дисперсий.

Пусть X – очки на первом кубике, Y – на втором.

Параметры распределения для каждого из кубиков рассчитаны в примере 1.

(mathrm{M(X)=M(Y)=3,5, D(X)=D(Y)=2frac{11}{12}}).

Для суммы очков получаем:

(mathrm{M(X+Y)=M(X)+M(Y)=3,5+3,5=7})

(mathrm{D(X+Y)=D(X)+D(Y)=2frac{11}{12}+2frac{11}{12}=5frac56})

(mathrm{sigma(X+Y)=sqrt{D(X+Y)}=sqrt{5frac56}approx 2,4})

Ответ: (mathrm{M(X+Y)=7; D(X+Y)=5frac56; sigma(X+Y)approx 2,4}).

Пример 3*. Докажите, что в опытах по схеме Бернулли математическое ожидание M(X)=np, а дисперсия D(X)=npq.

Проведем один опыт. В нём может быть только два исхода: «успех» и «неудача».

Составим расчётную таблицу:

(mathrm{x_i^2p_i})

0

p

p

Мат.ожидание первого опыта (mathrm{M(X)=sum x_ip_i=p}).

Общее число успехов при n опытах складывается из числа успехов при каждом опыте, т.е. (mathrm{X=X_1+X_2+…+X_n}). Все опыты между собой независимы.

По свойству мат.ожидания суммы независимых событий: begin{gather*} mathrm{ M(X)=M(X_1+X_2+…+X_n)=M(X_1)+M(X_2)+…+M(X_n)= }\ mathrm{=underbrace{p+p+…+p}_{n text{раз}}=np } end{gather*} Дисперсия первого опыта (mathrm{D(X)=sum x_i^2p_i-M(X)=p-p^2=p(1-p)=pq})

По свойству дисперсии суммы независимых событий: begin{gather*} mathrm{ D(X)=D(X_1+X_2+…+X_n)=D(X_1)+D(X_2)+…+D(X_n)= }\ mathrm{=underbrace{pq+pq+…+pq}_{n text{раз}}=npq } end{gather*} Что и требовалось доказать.

Пример 4. 100 канцелярских кнопок высыпали на стул. Вероятность, что кнопка упала острием вверх, равна 0,4. Найдите среднее количество, дисперсию и СКО для числа кнопок, упавших острием вверх. Найдите интервал оценки для количества этих кнопок по правилу «трёх сигм».

По условию n = 100, p = 0,4.

Для каждой кнопки может быть два исхода: упасть острием вверх или вниз.

Таким образом, это испытание Бернулли с биномиальным распределением случайной величины. begin{gather*} mathrm{ M(X)=np=100cdot 0,4=40 }\ mathrm{D(X)=npq=100cdot 0,4cdot 0,6=24 }\ mathrm{sigma(X)=sqrt{D(X)}=sqrt{24}approx 4,9} end{gather*} Интервал оценки «три сигмы»: begin{gather*} mathrm{ M(X)-3sigma(X)lt Xlt M(X)+3sigma(X) }\ mathrm{40-3cdot 4,9lt Xlt 40+3cdot 4,9 }\ mathrm{25,3lt Xlt 54,7}\ mathrm{26leq Xleq 54} end{gather*} Скорее всего (99,7%), от 26 до 54 кнопок будут острием вверх.

Ответ: (mathrm{M(X)=40; D(X)=24; sigma(X)approx 4,9; 26leq Xleq 54})

Пример 5*. В тесте 10 задач с 4 вариантами ответов. Ответы выбираются наугад. Постройте распределение величины X = «количество угаданных ответов», найдите числовые характеристики этого распределения.

Найдите интервал оценки для количества угаданных ответов по правилу «трёх сигм».

Какова вероятность угадать хотя бы 1 ответ? Хотя бы 5 ответов? Угадать все 10 ответов?

По условию: (mathrm{n=10, p=frac14, q=frac34}).

Для каждого ответа может быть два исхода: «угадал»/ «не угадал».

Таким образом, это испытание Бернулли с биномиальным распределением случайной величины. $$ mathrm{ P_{10}(k)=C_{10}^kp^kq^{10-k}=C_{10}^kfrac{3^{10-k}}{4^{10}}=left(frac34right)^{10}frac{C_{10}^k}{3^k} } $$ Строим расчётную таблицу. Для (mathrm{C_{10}^k}) используем рекуррентную формулу (см. §36 данного справочника): $$ mathrm{ C_{n}^k=frac{n-k+1}{k}C_n^{k-1} } $$

| (mathrm{x_i=k}) | (mathrm{C_k}) | (mathrm{3^k}) | (mathrm{p_i(x_i)}) | (mathrm{x_icdot p_i}) | (mathrm{x_i^2}) | (mathrm{x_i^2cdot p_i}) |

| 0 | 1 | 1 | 0,0563135 | 0,0000000 | 0 | 0,0000000 |

| 1 | 10 | 3 | 0,1877117 | 0,1877117 | 1 | 0,1877117 |

| 2 | 45 | 9 | 0,2815676 | 0,5631351 | 4 | 1,1262703 |

| 3 | 120 | 27 | 0,2502823 | 0,7508469 | 9 | 2,2525406 |

| 4 | 210 | 81 | 0,1459980 | 0,5839920 | 16 | 2,3359680 |

| 5 | 252 | 243 | 0,0583992 | 0,2919960 | 25 | 1,4599800 |

| 6 | 210 | 729 | 0,0162220 | 0,0973320 | 36 | 0,5839920 |

| 7 | 120 | 2187 | 0,0030899 | 0,0216293 | 49 | 0,1514053 |

| 8 | 45 | 6561 | 0,0003862 | 0,0030899 | 64 | 0,0247192 |

| 9 | 10 | 19683 | 0,0000286 | 0,0002575 | 81 | 0,0023174 |

| 10 | 1 | 59049 | 0,0000010 | 0,0000095 | 100 | 0,0000954 |

| Σ | 1 | 2,5 | 8,125 |

Получаем: begin{gather*} mathrm{ M(X)=sum_{i=0}^{10} x_ip_i=2,5 }\ mathrm{ D(X)=sum_{i=0}^{10} x_i^2p_i-M^2(X)=8,125=2,5^2=1,875 }\ mathrm{ sigma(X)=sqrt{D(X)}=sqrt{1,875}approx 1,37 } end{gather*}

Интервал оценки «три сигмы»: begin{gather*} mathrm{ M(X)-3sigma(X) lt Xlt M(X)+3sigma(X) }\ mathrm{ 2,5-3cdot 1,37lt X lt 2,5+3cdot 1,37 }\ mathrm{ -1,61lt Xlt 6,61 }\ mathrm{ 0leq Xleq 6 } end{gather*} Скорее всего (по расчетам – 99,65%), вы угадаете от 0 до 6 ответов.

Вероятность угадать хотя бы один ответ: begin{gather*} mathrm{ P(Xgeq 1)=1-p_0approx 1-0,0563=0,9437 }end{gather*} Очень хорошие шансы – 94,37%.

Вероятность угадать хотя бы 5 ответов: begin{gather*} mathrm{ P(Xgeq 5)=1-left(sum_{i=0}^{4}{p_i} right)approx 1-(0,0563+0,1877+…+0,1460)=0,0781 }end{gather*} Шансов мало – 7,81%. Т.е. «средний балл» при сдаче тестов мало достижим методом научного тыка.

Вероятность угадать все 10 ответов: p10≈ 0,000001. Шанс – один из миллиона.