Линейно зависимые и линейно независимые вектора.

Навигация по странице:

- Определение линейной комбинации векторов

- Определение линейно независимой комбинации векторов

- Определение линейно зависимой комбинации векторов

- Свойства линейно зависимых векторов

- Примеры задач на линейную зависимость и линейную независимость векторов

Определение. Линейной комбинацией векторов a1, …, an с коэффициентами x1, …, xn называется вектор

x1a1 + … + xnan.

Определение. Линейная комбинация x1a1 + … + xnan называется тривиальной, если все коэффициенты x1, …, xn равны нулю.

Определение. Линейная комбинация x1a1 + … + xnan называется нетривиальной, если хотя быбы один из коэффициентов x1, …, xn не равен нулю.

Определение. Вектора a1, …, an называются линейно независимыми, если не существует нетривиальной комбинации этих векторов равной нулевому вектору.

То есть вектора a1, …, an линейно независимы если x1a1 + … + xnan = 0 тогда и только тогда, когда x1 = 0, …, xn = 0.

Определение. Вектора a1, …, an называются линейно зависимыми, если существует нетривиальная комбинация этих векторов равная нулевому вектору.

Свойства линейно зависимых векторов:

-

Для 2-х и 3-х мерных векторов.

Два линейно зависимые вектора — коллинеарные. (Коллинеарные вектора — линейно зависимы.)

. -

Для 3-х мерных векторов.

Три линейно зависимые вектора — компланарные. (Три компланарные вектора — линейно зависимы.)

-

Для n -мерных векторов.

n + 1 вектор всегда линейно зависимы.

Примеры задач на линейную зависимость и линейную независимость векторов:

Пример 1. Проверить будут ли вектора a = {3; 4; 5}, b = {-3; 0; 5}, c = {4; 4; 4}, d = {3; 4; 0} линейно независимыми.

Решение:

Вектора будут линейно зависимыми, так как размерность векторов меньше количества векторов.

Пример 2. Проверить будут ли вектора a = {1; 1; 1}, b = {1; 2; 0}, c = {0; -1; 1} линейно независимыми.

Решение: Найдем значения коэффициентов при котором линейная комбинация этих векторов будет равна нулевому вектору.

x1a + x2b + x3c1 = 0

Это векторное уравнение можно записать в виде системы линейных уравнений

| x1 + x2 = 0 | |

| x1 + 2x2 — x3 = 0 | |

| x1 + x3 = 0 |

Решим эту систему используя метод Гаусса

1100

12-10

1010

~

из второй строки вычтем первую; из третей строки вычтем первую:

1100

1 — 12 — 1-1 — 00 — 0

1 — 10 — 11 — 00 — 0

~

1100

01-10

0-110

~

из первой строки вычтем вторую; к третей строке добавим вторую:

1 — 01 — 10 — (-1)0 — 0

01-10

0 + 0-1 + 11 + (-1)0 + 0

~

1010

01-10

0000

Данное решение показывает, что система имеет множество решений, то есть существует не нулевая комбинация значений чисел x1, x2, x3 таких, что линейная комбинация векторов a, b, c равна нулевому вектору, например:

—a + b + c = 0

а это значит вектора a, b, c линейно зависимы.

Ответ: вектора a, b, c линейно зависимы.

Пример 3. Проверить будут ли вектора a = {1; 1; 1}, b = {1; 2; 0}, c = {0; -1; 2} линейно независимыми.

Решение: Найдем значения коэффициентов при котором линейная комбинация этих векторов будет равна нулевому вектору.

x1a + x2b + x3c1 = 0

Это векторное уравнение можно записать в виде системы линейных уравнений

| x1 + x2 = 0 | |

| x1 + 2x2 — x3 = 0 | |

| x1 + 2x3 = 0 |

Решим эту систему используя метод Гаусса

1100

12-10

1020

~

из второй строки вычтем первую; из третей строки вычтем первую:

1100

1 — 12 — 1-1 — 00 — 0

1 — 10 — 12 — 00 — 0

~

1100

01-10

0-120

~

из первой строки вычтем вторую; к третей строке добавим вторую:

1 — 01 — 10 — (-1)0 — 0

01-10

0 + 0-1 + 12 + (-1)0 + 0

~

1010

01-10

0010

~

из первой строки вычтем третью; к второй строке добавим третью:

1 — 00 — 01 — 10 — 0

0 + 01 + 0-1 + 10 + 0

0010

~

1010

0100

0010

Данное решение показывает, что система имеет единственное решение x1 = 0, x2 = 0, x3 = 0, а это значит вектора a, b, c линейно независимые.

Ответ: вектора a, b, c линейно независимые.

10. Определение линейной зависимости и независимости векторов. Введем важные понятия, играющие большую роль в линейных уравнениях, например, – понятия линейной зависимости и независимости векторов

Определение 1. Линейной

комбинацией векторовназывается сумма произведений этих

векторов на скаляры:

.

(2.8)

Определение 2. Система

векторовназывается линейно зависимой системой,

если линейная комбинация их (2.8) обращается

в нуль:

=0,

(2.9)

причем среди чиселсуществует хотя бы одно, отличное от

нуля.

Определение 3. Векторыназываются линейно независимыми, если

их линейная комбинация (2.8) обращается

в нуль лишь в случае, когда все числа.

Из этих определений можно

получить следующие следствия.

Следствие 1. В линейно

зависимой системе векторов хотя бы один

вектор может быть выражен как линейная

комбинация остальных.

Доказательство. Пусть

выполнено (2.9) и пусть для определенности,

коэффициент.

Имеем тогда:.

Заметим, что справедливо и обратное

утверждение.

Следствие 2. Если система

векторовсодержит нулевой вектор, то эта система

(обязательно) линейно зависима –

доказательство очевидно.

Следствие 3. Если средиnвекторовкакие либоk(

)

векторов линейно зависимы, то и всеnвекторов линейно зависимы (опустим

доказательство).

20. Линейные

комбинации двух, трех и четырех векторов.

Рассмотрим вопросы линейной зависимости

и независимости векторов на прямой,

плоскости и в пространстве. Приведем

соответствующие теоремы.

Теорема 1. Для того чтобы

два вектора были линейно зависимы,

необходимо и достаточно, чтобы они были

коллинеарны.

Необходимость. Пусть векторыи

линейно зависимы. Это означает, что их

линейная комбинация=0

и (ради определенности).

Отсюда следует равенство,

и (по определению умножения вектора на

число) векторыи

коллинеарны.

Достаточность. Пусть векторыи

коллинеарны (

║

)

(предполагаем, что они отличны от нулевого

вектора; иначе их линейная зависимость

очевидна).

По теореме (2.7)

(см. §2.1,п.20) тогдатакое, что

,

или– линейная комбинация равна нулю, причем

коэффициент приравен 1 – векторы

и

линейно зависимы.

Из этой теоремы вытекает

следующее следствие.

Следствие. Если векторыи

не коллинеарны, то они линейно независимы.

Теорема 2. Для того чтобы

три вектора были линейно зависимы,

необходимо и достаточно, чтобы они были

компланарны.

Необходимость. Пусть векторы,

и

линейно зависимы. Покажем, что они

компланарны.

Из определения

линейной зависимости векторов следует

существование чисел

и

таких, что линейная комбинация

,

и при этом (для определенности).

Тогда из этого равенства можно выразить

вектор:

=

,

то есть векторравен диагонали параллелограмма,

построенного на векторах, стоящих в

правой части этого равенства (рис.2.6).

Это означает, что векторы,

и

лежат в одной плоскости.

Достаточность. Пусть векторы,

и

компланарны. Покажем, что они линейно

зависимы.

Исключим случай

коллинеарности какой либо пары векторов

(ибо тогда эта пара линейно зависима и

по следствию 3 (см.п.10) все три

вектора линейно зависимы). Заметим, что

такое предположение исключает также

существование нулевого вектора среди

указанных трех.

Перенесем три компланарных

вектора в одну плоскость и приведем их

к общему началу. Через конец вектора

проведем прямые, параллельные векторам

и

;

получим при этом векторыи

(рис.2.7) – их существование обеспечено

тем, что векторыи

не коллинеарные по предположению

векторы. Отсюда следует, что вектор=

+

.

Переписав это равенство в виде

(–1)+

+

=0,

заключаем, что векторы,

и

линейно зависимы.

Из доказанной теоремы вытекает

два следствия.

Следствие 1. Пустьи

не коллинеарные векторы, вектор

– произвольный, лежащий в плоскости,

определяемой векторамии

,

вектор. Существуют тогда числаи

такие, что

=

+

.

(2.10)

Следствие 2. Если векторы,

и

не компланарны, то они линейно независимы.

Теорема 3. Любые четыре

вектора линейно зависимы.

Доказательство опустим; с

некоторыми изменениями оно копирует

доказательство теоремы 2. Приведем

следствие из этой теоремы.

Следствие. Для любых

некомпланарных векторов,

,

и любого вектора

и

такие, что

.

(2.11)

Замечание. Для векторов в

(трехмерном) пространстве понятия

линейной зависимости и независимости

имеют, как это следует из приведенных

выше теорем 1-3, простой геометрический

смысл.

Пусть имеются два линейно

зависимых вектора

и

.

В таком случае один из них является

линейной комбинацией второго, то есть

просто отличается от него численным

множителем (например,).

Геометрически это означает, что оба

вектора находятся на общей прямой; они

могут иметь одинаковое или противоположное

направления (рис.2.8 хх ).

Если же два вектора расположены

под углом друг к другу (рис.2.9 хх ), то в

этом случае нельзя получить один из них

умножением другого на число – такие

векторы линейно независимы. Следовательно,

линейная независимость двух векторов

и

означает, что эти векторы не могут быть

уложены на одну прямую.

Выясним геометрический смысл

линейной зависимости и независимости

трех векторов.

Пусть векторы

,

и

линейно зависимы и пусть (для определенности)

векторявляется линейной комбинацией векторов

и

,

то есть расположен в плоскости, содержащей

векторыи

.

Это означает, что векторы,

и

лежат в одной плоскости. Справедливо и

обратное утверждение: если векторы,

и

лежат в одной плоскости, то они линейно

зависимы.

Таким образом,

векторы

,

и

линейно независимы в том и только в том

случае, если они не лежат в одной

плоскости.

30. Понятие

базиса. Одним из важнейших понятий

линейной и векторной алгебры является

понятие базиса. Введем определения.

Определение 1. Пара векторов

называется упорядоченной, если указано,

какой вектор этой пары считается первым,

а какой вторым.

Определение 2. Упорядоченная

пара,

неколлинеарных векторов называется

базисом на плоскости, определяемой

заданными векторами.

Теорема 1. Всякий векторна плоскости может быть представлен

как линейная комбинация базисной системы

векторов,

:

(2.12)

и это представление единственно.

Доказательство. Пусть

векторыи

образуют базис. Тогда любой вектор

можно представить в виде

.

Для доказательства единственности

предположим, что имеется еще одно

разложение

.

Имеем тогда=0,

причем хотя бы одна из разностей отлична

от нуля. Последнее означает, что векторыи

линейно зависимы, то есть коллинеарны;

это противоречит утверждению, что они

образуют базис.

Но тогда

– разложение единственно.

Определение 3. Тройка

векторов называется упорядоченной,

если указано, какой вектор ее считается

первым, какой вторым, а какой третьим.

Определение 4. Упорядоченная

тройка некомпланарных векторов называется

базисом в пространстве.

Здесь также справедлива теорема

разложения и единственности.

Теорема 2. Любой векторможет быть представлен как линейная

комбинация базисной системы векторов,

,

:

(2.13)

и это представление единственно

(опустим доказательство теоремы).

В разложениях (2.12) и (2.13) величины

называются координатами вектора

в заданном базисе (точнее, аффинными

координатами).

При фиксированном базисе

и

можно писать

.

Например, если задан базис

и дано, что

,

то это означает, что имеет место

представление (разложение).

40. Линейные

операции над векторами в координатной

форме. Введение базиса позволяет

линейные операции над векторами заменить

обычными линейными операциями над

числами – координатами этих векторов.

Пусть задан некоторый базис

.

Очевидно, задание координат вектора в

этом базисе полностью определяет сам

вектор. Имеют место следующие предложения:

а) два вектора

и

равны тогда и только тогда, когда равны

их соответственные координаты:

;

(2.14)

б) при умножении вектора

на число

его координаты умножаются на это число:

;

(2.15)

в) при сложении векторов

складываются их соответственные

координаты:

.

(2.16)

Доказательства этих свойств

опустим; докажем лишь для примера

свойство б). Имеем

=

=

==

.

Замечание. В пространстве

(на плоскости) можно выбрать бесконечно

много базисов.

Приведем пример перехода от

одного базиса к другому, установим

соотношения между координатами вектора

в различных базисах.

Пример 1. В базисной системезаданы три вектора:

,

и

.

В базисе,

,

вектор

имеет разложение

.

Найти координаты векторав базисе

.

Решение. Имеем разложения:,

,

;

следовательно,=

+2

+

=

=,

то естьв базисе

.

Пример 2. Пусть в некотором

базисечетыре вектора заданы своими координатами:

,

,

и

.

Выяснить,

образуют ли векторы

базис; в случае положительного ответа

найти разложение векторав этом базисе.

Решение. 1) векторы образуют

базис, если они линейно независимы.

Составим линейную комбинацию векторов(

)

и выясним, при какихи

она обращается в нуль:

=0.

Имеем:

=

+

+

=

=.

По определению

равенства векторов в координатной форме

получим следующую систему (линейных

однородных алгебраических) уравнений:

;

;

,

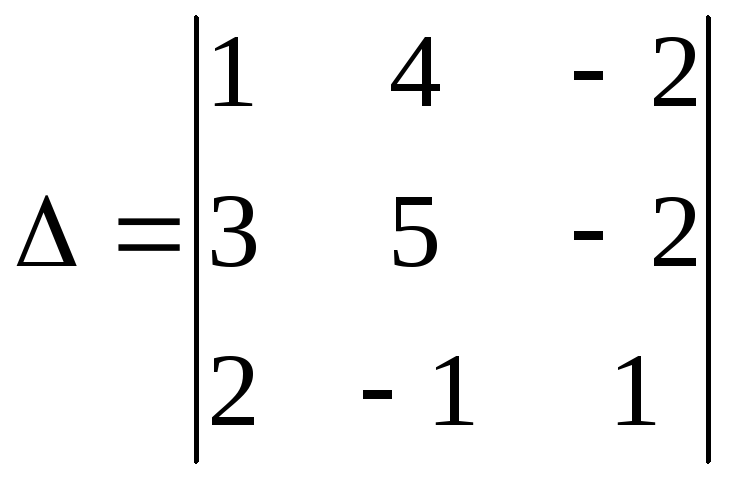

определитель которой

,

то есть система имеет (лишь) тривиальное

решение.

Это означает линейную независимость

векторови, следовательно, они образуют базис.

2) разложим вектор

в этом базисе. Имеем:

=

или в координатной форме

.

Переходя к

равенству векторов в координатной

форме, получим систему линейных

неоднородных алгебраических уравнений:

;

;

.

Решая ее (например, по правилу Крамера),

получим:,

,

и (

)

.

Имеем разложение векторав базисе

:

=

.

50. Проекция

вектора на ось. Свойства проекций. Пусть

имеется некоторая осьl,

то есть прямая с выбранным на ней

направлением и пусть задан некоторый

вектор.Определим

понятие проекции векторана осьl.

Определение. Проекцией

векторана осьlназывается

произведение модуля этого вектора на

косинус угла между осьюlи вектором (рис.2.10):

.

(2.17)

Следствием этого определения

является утверждение о том, что равные

векторы имеют равные проекции (на одну

и ту же ось).

Отметим свойства

проекций.

1) проекция суммы векторов на

некоторую ось lравна

сумме проекций слагаемых векторов на

ту же ось:

.

(2.18)

2) проекция произведения скаляра

на вектор равна произведению этого

скаляра на проекцию вектора на ту же

ось:

=

.

(2.19)

Следствие. Проекция линейной

комбинации векторов на ось равна линейной

комбинации их проекций:

.

(2.20)

Доказательства свойств опустим.

60. Прямоугольная

декартова система координат в пространстве.Разложение вектора по ортам осей.

Пусть в качестве базиса выбраны три

взаимно перпендикулярных орта; для них

вводим специальные обозначения.

Поместив их начала в точкуO,

направим по ним (в соответствии с ортами)

координатные осиOx,OyиOz(ось с выбранным на ней положительным

направлением, началом отсчета и единицей

длины называется координатной осью).

Определение. Упорядоченная

система трех взаимно перпендикулярных

координатных осей с общим началом и

общей единицей длины называется

прямоугольной декартовой системой

координат в пространстве.

Ось Ox

называется осью абсцисс,Oy– осью ординат иOz

– осью аппликат.

Займемся

разложением произвольного вектора по

базису

.

Из теоремы (см.§2.2,п.30, (2.13)) следует,

чтоможет быть и единственным образом

разложен по базису(здесь вместо обозначения координат

употребляют

):

.

(2.21)

В (2.21)

суть (декартовы прямоугольные) координаты

вектора.

Смысл декартовых координат устанавливает

следующая теорема.

Теорема. Декартовы

прямоугольные координатывектора

являются проекциями этого вектора

соответственно на осиOx,OyиOz.

Доказательство.Поместим

векторв начало системы координат – точкуO.

Тогда его конец будет совпадать с

некоторой точкой.

Проведем через

точку

три плоскости, параллельные координатным

плоскостямOyz,OxzиOxy(рис.2.11 хх ). Получим

тогда:

.

(2.22)

В (2.22) векторы

и

называются составляющими вектора

по осямOx,OyиOz.

Пусть через

и

обозначены соответственно углы,

образованные векторомс ортами

.

Тогда для составляющих получим следующие

формулы:

=

=

,

=

=

,

=

=

(2.23)

Из (2.21), (2.22) (2.23)

находим:

=

=

;

=

=

;

=

=

(2.23)

– координаты

вектора

есть проекции этого вектора на координатные

осиOx,OyиOzсоответственно.

Замечание . Числаназываются направляющими косинусами

вектора.

Модуль вектора

(диагональ прямоугольного параллелепипеда)

вычисляется по формуле:

.

(2.24)

Из формул (2.23) и (2.24) следует,

что направляющие косинусы могут быть

вычислены по формулам:

=

;

=

;

=

.

(2.25)

Возводя обе части каждого из

равенств в (2.25) и складывая почленно

левые и правые части полученных равенств,

придем к формуле:

(2.26)

– не любые три угла образуют

некоторое направление в пространстве,

но лишь те, косинусы которых связаны

соотношением (2.26).

70. Радиус-вектор

и координаты точки.Определение

вектора по его началу и концу. Введем

определение.

Определение. Радиусом-вектором

(обозначается)

называется вектор, соединяющий начало

координатOс этой

точкой (рис.2.12 хх ):

.

(2.27)

Любой точке пространства

соответствует определенный радиус-вектор

(и обратно). Таким образом, точки

пространства представляются в векторной

алгебре их радиус-векторами.

Очевидно, координаты

точкиMявляются

проекциями ее радиус-векторана координатные оси:

(2.28’)

и, таким образом,

(2.28)

– радиус-вектор точки есть

вектор, проекции которого на оси координат

равны координатам этой точки. Отсюда

следует две записи:

и

.

Получим формулы для вычисления

проекций вектора

по координатам его начала – точке

и конца – точке

.

Проведем радиус-векторы

и вектор

(рис.2.13). Получим, что

=

=

(2.29)

– проекции вектора на координатные

орты равны разностям соответствующих

координат конца и начала вектора.

80. Некоторые

задачи на декартовы координаты.

1) условия коллинеарности

векторов. Из теоремы (см.§2.1,п.20,

формула (2.7)) следует, что для коллинеарности

векторови

необходимо и достаточно, чтобы выполнялось

соотношение:=

.

Из этого векторного равенства получаем

три в координатной форме равенства:,

откуда следует условие коллинеарности

векторов в координатной форме:

(2.30)

– для коллинеарности векторов

и

необходимо и достаточно, чтобы их

соответствующие координаты были

пропорциональны.

2) расстояние между

точками. Из представления (2.29)

следует, что расстояниемежду точками

и

определяется формулой

=

=

.

(2.31)

3) деление отрезка в

данном отношении. Пусть даны точкии

и отношение

.

Нужно найти– координаты точкиM

(рис.2.14).

Имеем из условия коллинеарности

векторов:

,

откудаи

.

(2.32)

Из (2.32) получим в координатной

форме:

.

(2.32’)

Из формул (2.32’) можно получить

формулы для вычисления координат

середины отрезка

,

полагая:

.

(2.32”)

Замечание. Будем считать

отрезкии

положительными или отрицательными в

зависимости от того, совпадает их

направление с направлением от началаотрезка к концу

,

или не совпадает. Тогда по формулам

(2.32) – (2.32”) можно находить координат

точки, делящей отрезоквнешним образом, то есть так, что делящая

точкаMнаходится на

продолжении отрезка,

а не внутри его. При этом конечно,.

4) уравнение сферической

поверхности. Составим уравнение

сферической поверхности – геометрического

места точек,

равноудаленных на расстояниеот некоторого фиксированного центра –

точки.

Очевидно, что в данном случаеи с учетом формулы (2.31)

.

(2.33)

Уравнение (2.33) и есть уравнение

искомой сферической поверхности.

For linear dependence of random variables, see Covariance.

Linearly independent vectors in

Linearly dependent vectors in a plane in

In the theory of vector spaces, a set of vectors is said to be linearly independent if there exists no nontrivial linear combination of the vectors that equals the zero vector. If such a linear combination exists, then the vectors are said to be linearly dependent. These concepts are central to the definition of dimension.[1]

A vector space can be of finite dimension or infinite dimension depending on the maximum number of linearly independent vectors. The definition of linear dependence and the ability to determine whether a subset of vectors in a vector space is linearly dependent are central to determining the dimension of a vector space.

Definition[edit]

A sequence of vectors

where

This implies that at least one of the scalars is nonzero, say

if

Thus, a set of vectors is linearly dependent if and only if one of them is zero or a linear combination of the others.

A sequence of vectors

can only be satisfied by

If a sequence of vectors contains the same vector twice, it is necessarily dependent. The linear dependency of a sequence of vectors does not depend of the order of the terms in the sequence. This allows defining linear independence for a finite set of vectors: A finite set of vectors is linearly independent if the sequence obtained by ordering them is linearly independent. In other words, one has the following result that is often useful.

A sequence of vectors is linearly independent if and only if it does not contain the same vector twice and the set of its vectors is linearly independent.

Infinite case[edit]

An infinite set of vectors is linearly independent if every nonempty finite subset is linearly independent. Conversely, an infinite set of vectors is linearly dependent if it contains a finite subset that is linearly dependent, or equivalently, if some vector in the set is a linear combination of other vectors in the set.

An indexed family of vectors is linearly independent if it does not contain the same vector twice, and if the set of its vectors is linearly independent. Otherwise, the family is said linearly dependent.

A set of vectors which is linearly independent and spans some vector space, forms a basis for that vector space. For example, the vector space of all polynomials in x over the reals has the (infinite) subset {1, x, x2, …} as a basis.

Geometric examples[edit]

Geographic location[edit]

A person describing the location of a certain place might say, «It is 3 miles north and 4 miles east of here.» This is sufficient information to describe the location, because the geographic coordinate system may be considered as a 2-dimensional vector space (ignoring altitude and the curvature of the Earth’s surface). The person might add, «The place is 5 miles northeast of here.» This last statement is true, but it is not necessary to find the location.

In this example the «3 miles north» vector and the «4 miles east» vector are linearly independent. That is to say, the north vector cannot be described in terms of the east vector, and vice versa. The third «5 miles northeast» vector is a linear combination of the other two vectors, and it makes the set of vectors linearly dependent, that is, one of the three vectors is unnecessary to define a specific location on a plane.

Also note that if altitude is not ignored, it becomes necessary to add a third vector to the linearly independent set. In general, n linearly independent vectors are required to describe all locations in n-dimensional space.

Evaluating linear independence[edit]

The zero vector[edit]

If one or more vectors from a given sequence of vectors

To see why, suppose that

Simplifying

Because not all scalars are zero (in particular,

As a consequence, the zero vector can not possibly belong to any collection of vectors that is linearly independent.

Now consider the special case where the sequence of

A collection of vectors that consists of exactly one vector is linearly dependent if and only if that vector is zero.

Explicitly, if

Linear dependence and independence of two vectors[edit]

This example considers the special case where there are exactly two vector

The vectors

is a scalar multiple of

(explicitly, this means that there exists a scalar

such that

) or

is a scalar multiple of

(explicitly, this means that there exists a scalar

such that

).

If

If

If

This shows that if

If

Moreover, if exactly one of

The vectors

Vectors in R2[edit]

Three vectors: Consider the set of vectors

or

Row reduce this matrix equation by subtracting the first row from the second to obtain,

Continue the row reduction by (i) dividing the second row by 5, and then (ii) multiplying by 3 and adding to the first row, that is

Rearranging this equation allows us to obtain

which shows that non-zero ai exist such that

Two vectors: Now consider the linear dependence of the two vectors

or

The same row reduction presented above yields,

This shows that

Vectors in R4[edit]

In order to determine if the three vectors in

are linearly dependent, form the matrix equation,

Row reduce this equation to obtain,

Rearrange to solve for v3 and obtain,

This equation is easily solved to define non-zero ai,

where

Alternative method using determinants[edit]

An alternative method relies on the fact that

In this case, the matrix formed by the vectors is

We may write a linear combination of the columns as

We are interested in whether AΛ = 0 for some nonzero vector Λ. This depends on the determinant of

Since the determinant is non-zero, the vectors

Otherwise, suppose we have

Furthermore, the reverse is true. That is, we can test whether the

for all possible lists of

More vectors than dimensions[edit]

If there are more vectors than dimensions, the vectors are linearly dependent. This is illustrated in the example above of three vectors in

Natural basis vectors[edit]

Let

Then

Proof

Suppose that

Since

then

Linear independence of functions[edit]

Let

Proof[edit]

Suppose

Take the first derivative of the above equation:

for all values of

Space of linear dependencies[edit]

A linear dependency or linear relation among vectors v1, …, vn is a tuple (a1, …, an) with n scalar components such that

If such a linear dependence exists with at least a nonzero component, then the n vectors are linearly dependent. Linear dependencies among v1, …, vn form a vector space.

If the vectors are expressed by their coordinates, then the linear dependencies are the solutions of a homogeneous system of linear equations, with the coordinates of the vectors as coefficients. A basis of the vector space of linear dependencies can therefore be computed by Gaussian elimination.

Generalizations[edit]

Affine independence[edit]

A set of vectors is said to be affinely dependent if at least one of the vectors in the set can be defined as an affine combination of the others. Otherwise, the set is called affinely independent. Any affine combination is a linear combination; therefore every affinely dependent set is linearly dependent. Conversely, every linearly independent set is affinely independent.

Consider a set of

![{textstyle left(left[{begin{smallmatrix}1\mathbf {v} _{1}end{smallmatrix}}right],ldots ,left[{begin{smallmatrix}1\mathbf {v} _{m}end{smallmatrix}}right]right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bedef6dbcd38b445b141b49ec618600e574a614b)

Linearly independent vector subspaces[edit]

Two vector subspaces

More generally, a collection

The vector space

See also[edit]

- Matroid – Abstraction of linear independence of vectors

References[edit]

- ^ G. E. Shilov, Linear Algebra (Trans. R. A. Silverman), Dover Publications, New York, 1977.

- ^ Friedberg, Insel, Spence, Stephen, Arnold, Lawrence (2003). Linear Algebra. Pearson, 4th Edition. pp. 48–49. ISBN 0130084514.

{{cite book}}: CS1 maint: multiple names: authors list (link) - ^ Lovász, László; Plummer, M. D. (1986), Matching Theory, Annals of Discrete Mathematics, vol. 29, North-Holland, ISBN 0-444-87916-1, MR 0859549

- ^ a b Bachman & Narici 2000, pp. 3−7.

- Bachman, George; Narici, Lawrence (2000). Functional Analysis (Second ed.). Mineola, New York: Dover Publications. ISBN 978-0486402512. OCLC 829157984.

External links[edit]

- «Linear independence», Encyclopedia of Mathematics, EMS Press, 2001 [1994]

- Linearly Dependent Functions at WolframMathWorld.

- Tutorial and interactive program on Linear Independence.

- Introduction to Linear Independence at KhanAcademy.

10. Линейная зависимость и независимость векторов

Рассмотрим далее основополагающие в линейной алгебре понятие о линейной зависимости и независимости векторов, а также определение базиса системы векторов.

Любую конечную последовательность векторов

Система векторов

Линейная зависимость и независимость есть свойства системы векторов. Однако часто соответствующие прилагательные относят и к самим векторам. Поэтому вместо «линейно независимая система векторов» допустимо говорить «линейно независимые векторы».

Например, двумерные арифметические векторы

Если взять векторы

Из определения линейной зависимости (независимости) системы векторов вытекают следующие утверждения.

1) Если некоторая система векторов содержит нулевой вектор, то она является линейно зависимой.

Пусть для определенности первый вектор системы является нулевым, т. е.

Тогда линейная комбинация векторов вида

2) Если среди векторов системы есть такие, которые сами образуют линейно зависимую подсистему, то вся система также линейно зависима.

Так как исходная подсистема линейно зависима, то среди коэффициентов линейной комбинации векторов подсистемы имеется хотя бы один отличный от нуля. Добавим к этой линейной комбинацию линейную комбинацию векторов, не вошедших в исходную подсистему, с числовыми коэффициентами, равными нулю. Мы получим линейную комбинацию из векторов полной системы, которая равна нулевому вектору, причем имеется хотя бы один коэффициент отличный от нуля. Таким образом, наше утверждение доказано.

3) Если система векторов линейно независима, то и любая ее подсистема также линейно независима.

Если предположить обратное, т. е. существование некоторой линейно зависимой подсистемы, то по предыдущему утверждению отсюда следует зависимость исходной системы, что противоречит условию доказываемой теоремы. Полученное противоречие доказывает сформулированное утверждение.

4) Для того чтобы система из

Необходимость. Пусть система векторов

Достаточность. Пусть имеется некоторый вектор

По аналогичной схеме доказывается следующее утверждение.

5) Система векторов линейно зависима тогда и только тогда, когда хотя бы один из векторов системы может быть представлен в виде линейной комбинации остальных векторов.

Как найти подсистему системы векторов

Определение 1. Система векторов

Определение 1´. Система векторов

Покажем, что эти определения эквивалентны.

Пусть выполняется определение 1, т.е. один из векторов системы равен линейной комбинации остальных:

Линейная комбинация системы векторов равна нулевому вектору, причем не все коэффициенты этой комбинации равны нулю, т.е. выполняется определение 1´.

Пусть выполняется определение 1´. Линейная комбинация системы векторов равна

Один из векторов системы мы представили в виде линейной комбинации остальных, т.е. выполняется определение 1.

Определение 2. Единичным вектором, или ортом,

.

Теорема 1. Различные единичные векторы n -мерного пространства линейно независимы.

Доказательство. Пусть линейная комбинация этих векторов с произвольными коэффициентами равна нулевому вектору.

Из этого равенства следует, что все коэффициенты равны нулю. Получили противоречие.

Каждый вектор n -мерного пространства ā(а 1 , а 2 , . а n ) может быть представлен в виде линейной комбинации единичных векторов с коэффициентами, равными координатам вектора

Теорема 2. Если системы векторов содержит нулевой вектор, то она линейно зависима.

Доказательство. Пусть дана система векторов

Следовательно, система линейно зависима.

Теорема 3. Если некоторая подсистема системы векторов линейно зависима, то и вся система линейно зависима.

Доказательство. Дана система векторов

Получилось, что линейная комбинация векторов всей системы равна

Следствие. Если система векторов линейно независима, то и любая ее подсистема также линейно независима.

Предположим противное, т.е. некоторая подсистема линейно зависима. Из теоремы следует, что вся система линейно зависима. Мы пришли к противоречию.

Теорема 4 (теорема Штейница). Если каждый из векторов

Следствие. В любой системе n -мерных векторов не может быть больше чем n линейно независимых.

Доказательство. Каждый n -мерный вектор выражается в виде линейной комбинации n единичных векторов. Поэтому, если система содержит m векторов и m > n , то, по теореме, данная система линейно зависима.

Как найти подсистему системы векторов

1.4. РАНГ СИСТЕМЫ ВЕКТОРОВ

Рассмотрим систему векторов (1.1), где . Максимальной линейно независимой подсистемой системы векторов (1.1) называется любой набор векторов последней, удовлетворяющий следующим условиям: векторы этого набора линейно независимы; всякий вектор из системы (1.1) линейно выражается через векторы этого набора. В общем, система векторов (1.1) может иметь несколько разных максимальных линейно независимых подсистем.

Теорема 1. 6. Все максимальные линейно независимые подсистемы данной системы векторов содержат одно и то же число векторов.

Число векторов в максимальной линейно независимой подсистеме системы векторов (1.1) называется рангом последней. Системы векторов (1.1) и (1.2) называются эквивалентными, если векторы системы (1.1) линейно выражаются через систему векторов (1.2) и наоборот.

Теорема 1. 7. Ранги эквивалентных систем векторов равны.

Операции, переводящие систему векторов (1.1) в систему, ей эквивалентную, следующие:

1) изменение нумерации векторов в системе;

2) удаление нулевого вектора;

3) удаление вектора, являющегося линейной комбинацией остальных векторов системы;

4) умножение произвольного вектора системы на любое, не равное нулю число;

5) прибавление к одному из векторов системы линейной комбинации остальных векторов системы.

http://lms2.sseu.ru/courses/eresmat/course1/razd8z1/par8_5z1.htm

http://www.math.mrsu.ru/text/courses/method/rang_sist_vect.htm