Введение в Байесовские методы

Reading time

6 min

Views 169K

В качестве введения

В настоящее время Байесовские методы получили достаточно широкое распространение и активно используются в самых различных областях знаний. Однако, к сожалению, не так много людей имеют представление о том, что же это такое и зачем это нужно. Одной из причин является отсутствие большого количества литературы на русском языке. Поэтому здесь попытаюсь изложить их принципы настолько просто, насколько смогу, начав с самых азов (прошу прощения, если кому-то это покажется слишком простым).

В дальнейшем я бы хотел перейти к непосредственно Байесовскому анализу и рассказать об обработке реальных данных и о, на мой взгляд, отличной альтернативе языку R (о нем немного писалось тут) — Python с модулем pymc. Лично мне Python кажется гораздо более понятным и логичным, чем R с пакетами JAGS и BUGS, к тому же Python дает гораздо большую свободу и гибкость (хотя в Python есть и свои трудности, но они преодолимы, да и в простом анализе встречаются нечасто).

Немного истории

В качестве краткой исторической справки скажу, что формула Байеса была опубликована аж в 1763 году спустя 2 года после смерти ее автора, Томаса Байеса. Однако, методы, использующие ее, получили действительно широкое распространение только к концу ХХ века. Это объясняется тем, что расчеты требуют определенных вычислительных затрат, и они стали возможны только с развитием информационных технологий.

О вероятности и теореме Байеса

Формула Байеса и все последующее изложение требует понимания вероятности. Подробнее о вероятности можно почитать на Википедии.

На практике вероятность наступления события есть частота наступления этого события, то есть отношение количества наблюдений события к общему количеству наблюдений при большом (теоретически бесконечном) общем количестве наблюдений.

Рассмотрим следующий эксперимент: мы называем любое число из отрезка [0, 1] и смотрим за тем, что это число будет между, например, 0.1 и 0.4. Как нетрудно догадаться, вероятность этого события будет равна отношению длины отрезка [0.1, 0.4] к общей длине отрезка [0, 1] (другими словами, отношение «количества» возможных равновероятных значений к общему «количеству» значений), то есть (0.4 — 0.1) / (1 — 0) = 0.3, то есть вероятность попадания в отрезок [0.1, 0.4] равна 30%.

Теперь посмотрим на квадрат [0, 1] x [0, 1].

Допустим, мы должны называть пары чисел (x, y), каждое из которых больше нуля и меньше единицы. Вероятность того, что x (первое число) будет в пределах отрезка [0.1, 0.4] (показан на первом рисунке как синяя область, на данный момент для нас второе число y не важно), равна отношению площади синей области к площади всего квадрата, то есть (0.4 — 0.1) * (1 — 0) / (1 * 1) = 0.3, то есть 30%. Таким образом можно записать, что вероятность того, что x принадлежит отрезку [0.1, 0.4] равна p(0.1 <= x <= 0.4) = 0.3 или для краткости p(X) = 0.3.

Если мы теперь посмотрим на y, то, аналогично, вероятность того, что y находится внутри отрезка [0.5, 0.7] равна отношению площади зеленой области к площади всего квадрата p(0.5 <= y <= 0.7) = 0.2, или для краткости p(Y) = 0.2.

Теперь посмотрим, что можно узнать о значениях одновременно x и y.

Если мы хотим знать, какова вероятность того, что одновременно x и y находятся в соответствующих заданных отрезках, то нам нужно посчитать отношение темной площади (пересечения зеленой и синей областей) к площади всего квадрата: p(X, Y) = (0.4 — 0.1) * (0.7 — 0.5) / (1 * 1) = 0.06.

А теперь допустим мы хотим знать какова вероятность того, что y находится в интервале [0.5, 0.7], если x уже находится в интервале [0.1, 0.4]. То есть фактически у нас есть фильтр и когда мы называем пары (x, y), то мы сразу отбрасывает те пары, которые не удовлетворяют условию нахождения x в заданном интервале, а потом из отфильтрованных пар мы считаем те, для которых y удовлетворяет нашему условию и считаем вероятность как отношение количества пар, для которых y лежит в вышеупомянутом отрезке к общему количеству отфильтрованных пар (то есть для которых x лежит в отрезке [0.1, 0.4]). Мы можем записать эту вероятность как p(Y|X). Очевидно, что эта вероятность равна отношению площади темной области (пересечение зеленой и синей областей) к площади синей области. Площадь темной области равна (0.4 — 0.1) * (0.7 — 0.5) = 0.06, а площадь синей (0.4 — 0.1) * (1 — 0) = 0.3, тогда их отношение равно 0.06 / 0.3 = 0.2. Другими словами, вероятность нахождения y на отрезке [0.5, 0.7] при том, что x уже принадлежит отрезку [0.1, 0.4] равна p(Y|X) = 0.2.

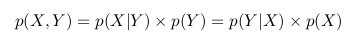

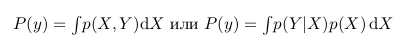

Можно заметить, что с учетом всего вышесказанного и всех приведенных выше обозначений, мы можем написать следующее выражение

p(Y|X) = p(X, Y) / p(X)

Кратко воспроизведем всю предыдущую логику теперь по отношению к p(X|Y): мы называем пары (x, y) и фильтруем те, для которых y лежит между 0.5 и 0.7, тогда вероятность того, что x находится в отрезке [0.1, 0.4] при условии, что y принадлежит отрезку [0.5, 0.7] равна отношению площади темной области к площади зеленой:

p(X|Y) = p(X, Y) / p(Y)

В двух приведенных выше формулах мы видим, что член p(X, Y) одинаков, и мы можем его исключить:

Мы можем переписать последнее равенство как

Это и есть теорема Байеса.

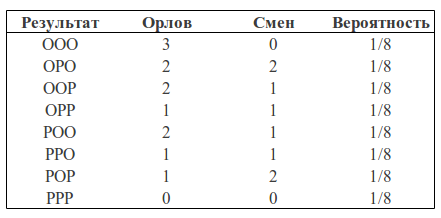

Интересно еще заметить, что p(Y) это фактически p(X,Y) при всех значениях X. То есть, если мы возьмем темную область и растянем ее так, что она будет покрывать все значения X, она будет в точности повторять зеленую область, а значит, она будет равна p(Y). На языке математики это будет означать следующее:

Тогда мы можем переписать формулу Байеса в следующем виде:

Применение теоремы Байеса

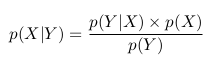

Давайте рассмотрим следующий пример. Возьмем монетку и подкинем ее 3 раза. С одинаковой вероятностью мы можем получить следующие результаты (О — орел, Р — решка): ООО, ООР, ОРО, ОРР, РОО, РОР, РРО, РРР.

Мы можем посчитать какое количество орлов выпало в каждом случае и сколько при этом было смен орел-решка, решка-орел:

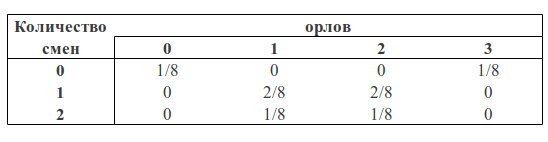

Мы можем рассматривать количество орлов и количество изменений как две случайные величины. Тогда таблица вероятностей будет иметь следуюший вид:

Теперь мы можем увидеть формулу Байеса в действии.

Но прежде проведем аналогию с квадратом, который мы рассматривали ранее.

Можно заметить, что p(1O) есть сумма третьего столбца («синяя область» квадрата) и равна сумме всех значений ячеек в этом столбце: p(1O) = 2/8 + 1/8 = 3/8

p(1С) есть сумма третьей строки («зеленая область» квадрата) и, аналогично, равна сумме всех значений ячеек в этой строке p(1С) = 2/8 + 2/8 = 4/8

Вероятность того, что мы получили одного орла и одну смену равна пересечению этих областей (то есть значение в клетке пересечения третьего столбца и третьей строки) p(1С, 1О) = 2/8

Тогда, следуя формулам описанным выше, мы можем посчитать вероятность получить одну смену, если мы получили одного орла в трех бросках:

p(1С|1О) = p(1С, 1О) / p(1О) = (2/8) / (3/8) = 2/3

или вероятность получить одного орла, если мы получили одну смену:

p(1О|1С) = p(1С, 1О) / p(1С) = (2/8) / (4/8) = 1/2

Если мы посчитаем вероятность получить одну смену при наличии одного орла p(1О|1С) через формулу Байеса, то получим:

p(1О|1С) = p(1С|1О) * p(1О) / p(1С) = (2/3) * (3/8) / (4/8) = 1/2

Что мы и получили выше.

Но какое практическое значение имеет приведенный выше пример?

Дело в том, что, когда мы анализируем реальные данные, обычно нас интересует какой-то параметр этих данных (например, среднее, дисперсия и пр.). Тогда мы можем провести следующую аналогию с вышеприведенной таблицей вероятностей: пусть строки будут нашими экспериментальными данными (обозначим их Data), а столбцы — возможными значениями интересующего нас параметра этих данных (обозначим его

Мы можем применить формулу Баейса и записать следующее:

А вспомнив формулу с интегралом, можно записать следующее:

То есть фактически как результат нашего анализа мы имеет вероятность как функцию параметра. Теперь мы можем, например, максимизировать эту функцию и найти наиболее вероятное значение параметра, посчитать дисперсию и среднее значение параметра, посчитать границы отрезка, внутри которого интересующий нас параметр лежит с вероятностью 95% и пр.

Вероятность

Функция правдоподобия определяется нашей моделью. То есть мы создаем модель сбора данных, которая зависит от интересующего нас параметра. К примеру, мы хотим интерполировать данные с помощью прямой y = a * x + b (таким образом мы предполагаем, что все данные имеют линейную зависимость с наложенным на нее гауссовым шумом с известной дисперсией). Тогда a и b — это наши параметры, и мы хотим узнать их наиболее вероятные значения, а функция правдоподобия — гаусс со средним, заданным уравнением прямой, и данной дисперсией.

Априорная вероятность включает в себя информацию, которую мы знаем до проведения анализа. Например, мы точно знаем, что прямая должна иметь положительный наклон, или, что значение в точке пересечения с осью x должно быть положительным, — все это и не только мы можем инкорпорировать в наш анализ.

Как можно заметить, знаменатель дроби является интегралом (или в случае, когда параметры могут принимать только определенные дискретные значения, суммой) числителя по всем возможным значениям параметра. Практически это означает, что знаменатель является константой и служит для того, что нормализировать апостериорную вероятность (то есть, чтобы интеграл апостериорной вероятности был равен единице).

На этом я бы хотел закончить свой пост (продолжение тут). Буду рад вашим комментариям.

Содержание:

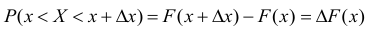

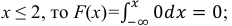

Непрерывные случайные величины: функция распределения случайной величины:

Если вычислить вероятность появления непрерывной случайной величины не составляет особого труда, то решение основной задачи теории вероятностей для непрерывной случайной величины несёт большие трудности. Поэтому в материалах сегодняшней лекции мы рассмотрим методы определения вероятности попадания непрерывной случайной величины на интервал с помощью функции распределения.

Функция распределения непрерывной случайной величины

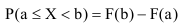

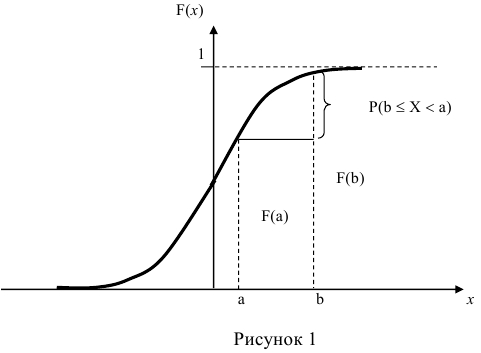

Зная функцию распределения непрерывной случайной величины, задача определения вероятности её попадания на интервал (а; b) может быть решена следующим образом.

По известной функции распределения вероятность попадания непрерывной случайной величины на интервал (а; b) равна приращению функции распределения на этом участке (рис. 1).

Во всех рассмотренных выше случаях случайная величина определялась путём задания значений самой величины и вероятностей этих значений.

Однако такой метод применим далеко не всегда. Например, в случае непрерывной случайной величины, её значения могут заполнять некоторый произвольный интервал. Очевидно, что в этом случае задать все значения случайной величины просто нереально.

Даже в случае, когда это сделать можно, зачастую задача решается чрезвычайно сложно. Рассмотренный только что пример даже при относительно простом условии (приборов только четыре) приводит к достаточно неудобным вычислениям, а если в задаче будет несколько сотен приборов?

Поэтому встает задача по возможности отказаться от индивидуального подхода к каждой задаче и найти по возможности наиболее общий способ задания любых типов случайных величин.

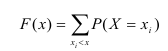

Пусть х — действительное число. Вероятность события, состоящего в том, что X примет значение, меньшее х, т.е. X

Определение. Функцией распределения называют функцию F(x), определяющую вероятность того, что случайная величина X в результате испытания примет значение, меньшее х.

F(x) = Р(Х < х)

Функцию распределения также называют интегральной функцией. Функция распределения существует как для непрерывных, так и для дискретных случайных величин. Она полностью характеризует случайную величину и является одной из форм закона распределения.

Для дискретной случайной величины функция распределения имеет

Знак неравенства под знаком суммы показывает, что суммирование распространяется на те возможные значения случайной величины, которые меньше аргумента х.

Функция распределения дискретной случайной величины X разрывна и возрастает скачками при переходе через каждое значение

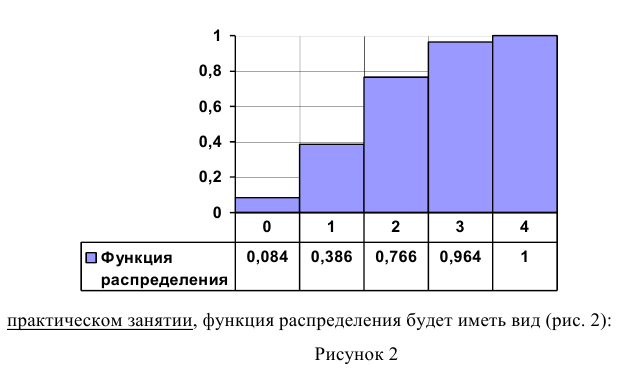

Так для примера, который мы будем рассматривать на следующем

Свойства функции распределения

1) значения функции распределения принадлежат отрезку [0, 1].

2) F(x) — неубывающая функция.

3) Вероятность того, что случайная величина примет значение, заключенное в интервале (а, b) , равна приращению функции распределения на этом интервале.

4) На минус бесконечности функция распределения равна нулю, на плюс бесконечности функция распределения равна единице.

5) Вероятность того, что непрерывная случайная величина X примет одно определенное значение, равна нулю.

Таким образом, не имеет смысла говорить о каком — либо конкретном значении случайной величины. Интерес представляет только вероятность попадания случайной величины в какой — либо интервал, что соответствует большинству практических задач.

Заключение по лекции:

В лекции мы рассмотрели методы решения основной задачи теории вероятностей — определения вероятности попадания непрерывной случайной величины на интервал с помощью функции распределения.

Плотность вероятности. Числовые характеристики. Моменты случайных величин

Если вычислить вероятность появления непрерывной случайной величины не составляет особого труда, то решение основной задачи теории вероятностей для непрерывной случайной величины несёт большие трудности. Поэтому в материалах сегодняшней лекции мы рассмотрим методы определения вероятности попадания непрерывной случайной величины на интервал с помощью плотности

распределения.

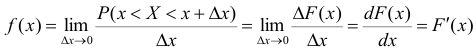

Плотность распределения

Функция распределения полностью характеризует случайную величину, однако, имеет один недостаток. По функции распределения трудно судить о характере распределения случайной величины в небольшой окрестности той или иной точки числовой оси.

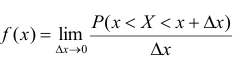

Определение. Плотностью распределения вероятностей непрерывной случайной величины X называется функция f(x) — первая производная от функции распределения F(x).

Плотность распределения также называют дифференциальной функцией. Для описания дискретной случайной величины плотность распределения неприемлема.

Смысл плотности распределения состоит в том, что она показывает как часто появляется случайная величина X в некоторой окрестности точки х при повторении опытов.

После введения функций распределения и плотности распределения можно дать следующее определение непрерывной случайной величины.

Определение. Случайная величина X называется непрерывной, если её функция распределения F(x) непрерывна на всей оси ОХ, а плотность распределения f(x) существует везде, за исключением (может быть, конечного числа точек).

Зная плотность распределения, можно вычислить вероятность того, что некоторая случайная величина X примет значение, принадлежащее заданному интервалу.

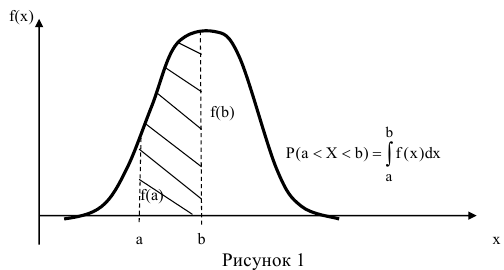

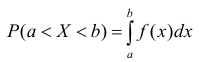

Теорема. Вероятность того, что непрерывная случайная величина X примет значение, принадлежащее интервалу (а, b), равна определенному интегралу от плотности распределения, взятому в пределах от а до b.

Доказательство этой теоремы основано на определении плотности распределения и третьем свойстве функции распределения (см. лекцию тема № 10).

Геометрически это означает, что вероятность того, что непрерывная случайная величина примет значение, принадлежащее интервалу (а, b), равна площади криволинейной трапеции, ограниченной осью ОХ, кривой распределения f(x) и прямыми х=а и х=b.

Геометрически вероятность Р(а < X < b) представляется в виде заштрихованной области, ограниченной кривой распределения и осью Ох на интервале(а; b) (рис 1).

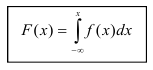

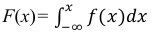

Функция распределения может быть легко найдена, если известна плотность распределения, по формуле:

Свойства плотности распределения

1) Плотность распределения — неотрицательная функция.

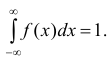

2) Несобственный интеграл от плотности распределения в пределах от —

Плотность распределения

можно представить как:

тогда

Поэтому иногда функцию плотности распределения f(x) называют также дифференциальной функцией распределения или дифференциальным законом распределения величины X, а функцию распределения F(x) -интегральной функцией распределения или интегральным законом распределения.

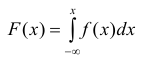

Следует заметить, что интеграл

Р(х < X < х + dx) = dF(x) = f(x)dx

Величину f(x)dx называют элементом вероятности.

По своему содержанию элемент вероятности есть вероятность попадания случайной величины X на элементарный участок dx, прилежащий к точке X.

Функция распределения случайной величины X по известной плотности распределения может быть найдена, как интеграл от плотности распределения в интервале от

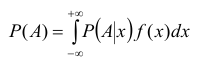

В схеме непрерывных случайных величин можно вывести аналогии формулы полной вероятности и формулы Бейеса, рассмотренные при изучении темы 4.

Обозначим Р(А /х) условную вероятность события А при условии Х= х. Заменяя в формуле полной вероятности вероятность гипотезы элементом вероятности f(x)dx, а сумму — интегралом, получим полную вероятность события А.

Данная формула называется интегральной формулой полной вероятности.

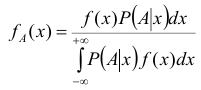

Соответствующий аналог в схеме непрерывных случайных величин имеет и формула Бейеса. Обозначив условную плотность распределения случайной величины X при условии, что в результате опыта появилось событие A через

Данная формула называется интегральной формулой Бейеса.

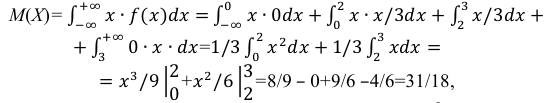

Числовые характеристики непрерывных случайных величин

Пусть непрерывная случайная величина X задана функцией распределения f(x). Допустим, что все возможные значения случайной величины принадлежат отрезку [а,b].

Математическое ожидание

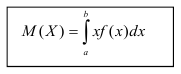

Определение. Математическим ожиданием непрерывной случайной величины X, возможные значения которой принадлежат отрезку [а,b], называется определенный интеграл

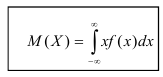

Если возможные значения случайной величины рассматриваются на всей числовой оси, то математическое ожидание находится по формуле:

При этом, конечно, предполагается, что несобственный интеграл сходится.

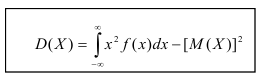

Дисперсия

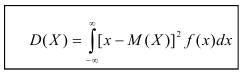

Определение. Дисперсией непрерывной случайной величины называется математическое ожидание квадрата её отклонения.

По аналогии с дисперсией дискретной случайной величины, для практического вычисления дисперсии используется формула:

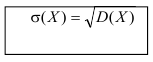

Среднеквадратичное отклонение

Определение. Средним квадратичным отклонением называется квадратный корень из дисперсии.

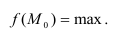

Мода

Определение. Модой

Если многоугольник распределения для дискретной случайной величины или кривая распределения для непрерывной случайной величины имеет два или несколько максимумов, то такое распределение называется двухмодальным или многомодальным.

Если распределение имеет минимум, но не имеет максимума, то оно

называется антимодальным.

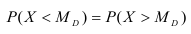

Медиана

Определение. Медианой

Геометрически медиана — абсцисса точки, в которой площадь, ограниченная кривой распределения делится пополам.

Отметим, что если распределение одномодальное, то мода и медиана совпадают с математическим ожиданием.

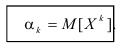

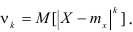

Начальный момент

Определение. Начальным моментом порядка k случайной величины X называется математическое ожидание величины

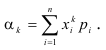

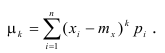

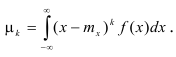

Для дискретной случайной величины:

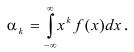

Для непрерывной случайной величины:

Начальный момент первого порядка равен математическому ожиданию.

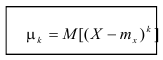

Центральный момент

Определение. Центральным моментом порядка k случайной величины X называется математическое ожидание величины

Для дискретной случайной величины:

Для непрерывной случайной величины:

Центральный момент первого порядка всегда равен нулю, а центральный момент второго порядка равен дисперсии. Центральный момент третьего порядка характеризует асимметрию распределения.

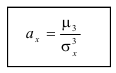

Коэффициент асимметрии

Определение. Отношение центрального момента третьего порядка к среднеквадратическому отклонению в третьей степени называется коэффициентом асимметрии.

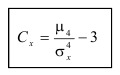

Эксцесс

Определение. Для характеристики островершинности и плосковершинности распределения используется величина, называемая эксцессом.

Кроме рассмотренных величин используются также так называемые абсолютные моменты:

Абсолютный начальный момент:

Абсолютный центральный момент:

Абсолютный центральный момент первого порядка называется средним арифметическим отклонением.

Заключение по лекции:

В лекции мы рассмотрели методы решения основной задачи теории вероятностей — определения вероятности попадания непрерывной случайной величины на интервал с помощью плотности распределения.

Законы распределения непрерывных величин: нормальное, равномерное, показательное

В материалах сегодняшней лекции мы рассмотрим законы распределения непрерывных величин.

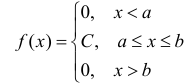

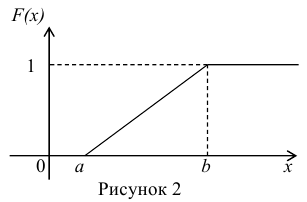

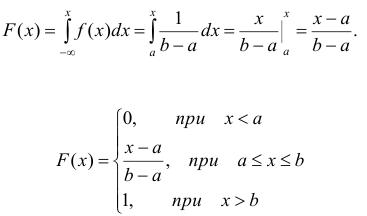

Равномерное распределение

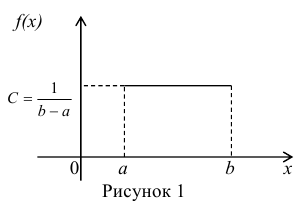

Определение. Непрерывная случайная величина имеет равномерное распределение на отрезке [а,b], если на этом отрезке плотность

распределения случайной величины постоянна, а вне его равна нулю.

Постоянная величина С может быть определена из условия равенства единице площади, ограниченной кривой распределения, представленной на рис. 1

Получаем

Найдём функцию распределения F(x) на отрезке [а,b] (рис. 2).

Для того, чтобы случайная величина подчинялась закону равномерного распределения необходимо, чтобы её значения лежали внутри некоторого определенного интервала, и внутри этого интервала значения этой случайной величины были бы равновероятны.

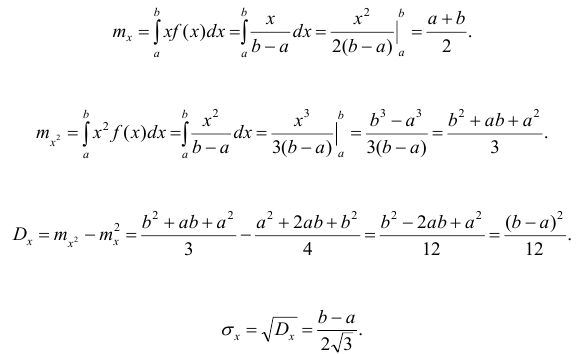

Определим математическое ожидание и дисперсию случайной величины, подчиненной равномерному закону распределения.

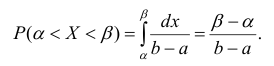

Вероятность попадания случайной величины в заданный интервал:

Показательное распределение

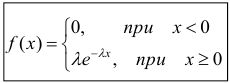

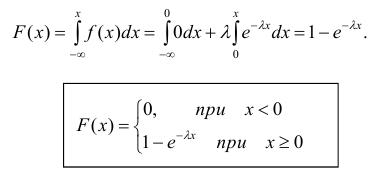

Определение. Показательным (экспоненциальным) называется распределение вероятностей непрерывной случайной величины X, которое описывается плотностью

где

Найдём закон распределения.

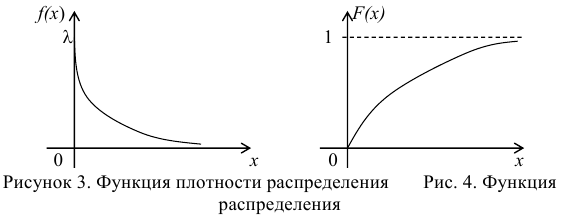

Графики функции распределения и плотности распределения представлены на рис. 3, 4.

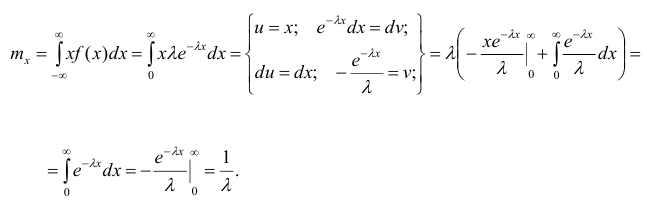

Найдём математическое ожидание случайной величины, подчинённой показательному распределению.

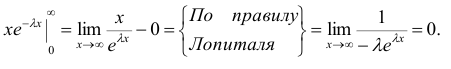

Результат получен с использованием того факта, что

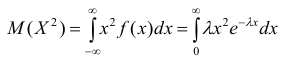

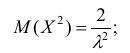

Для нахождения дисперсии найдём величину

Дважды интегрируя по частям, аналогично рассмотренному случаю, получим:

Тогда

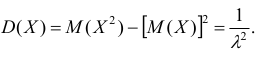

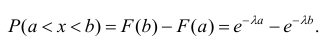

Итого:

Видно, что в случае показательного распределения математическое ожидание и среднеквадратическое отклонение равны.

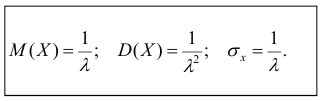

Также легко определить и вероятность попадания случайной величины, подчиненной показательному закону распределения, в заданный интервал.

Показательное распределение широко используется в теории надёжности.

Допустим, некоторое устройство начинает работать в момент времени to=0, а через какое- то время t происходит отказ устройства.

Обозначим Т непрерывную случайную величину — длительность безотказной работы устройства.

Таким образом, функция распределения F(t) = P(T

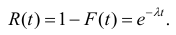

Вероятность противоположного события (безотказная работа в течение времени t) равна R(t) = P(T>t) — l — F(t).

Функция надежности

Определение. Функцией надёжности R(t) называют функцию, определяющую вероятность безотказной работы устройства в течение времени t.

Часто на практике длительность безотказной работы подчиняется показательному закону распределению.

Вообще говоря, если рассматривать новое устройство, то вероятность отказа в начале его функционирования будет больше, затем количество отказов снизится и будет некоторое время иметь практически одно и то же значение. Затем (когда устройство выработает свой ресурс) количество отказов будет возрастать.

Другими словами, можно сказать, что функционирование устройства на протяжении всего существования (в смысле количества отказов) можно описать комбинацией двух показательных законов (в начале и конце функционирования) и равномерного закона распределения.

Функция надёжности для какого- либо устройства при показательном законе распределения равна:

Данное соотношение называют показательным законом надежности.

Важным свойством, позволяющим значительно упростить решение задач теории надежности, является то, что вероятность безотказной работы устройства на интервале времени t не зависит от времени предшествующей работы до начала рассматриваемого интервала, а зависит только от длительности времени t.

Таким образом, безотказная работа устройства зависит только от интенсивности отказов

прошлом.

Так как подобным свойством обладает только показательный закон распределения, то этот факт позволяет определить, является ли закон распределения случайной величины показательным или нет.

Нормальный закон распределения

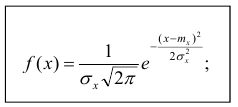

Определение. Нормальным называется распределение вероятностей непрерывной случайной величины, которое описывается плотностью вероятности

Нормальный закон распределения также называется законом Гаусса.

Нормальный закон распределения занимает центральное место в теории вероятностей. Это обусловлено тем, что этот закон проявляется во всех случаях, когда случайная величина является результатом действия большого числа различных факторов. К нормальному закону приближаются все остальные законы распределения.

Можно легко показать, что параметры

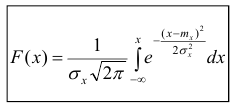

Найдём функцию распределения F(x).

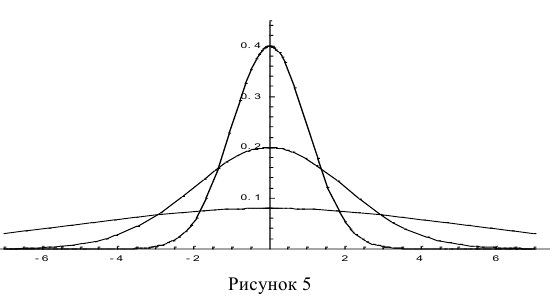

График плотности нормального распределения называется нормальной кривой или кривой Гаусса.

Нормальная кривая обладает следующими свойствами:

1) Функция определена на всей числовой оси.

2) При всех х функция распределения принимает только положительные значения.

3) Ось ОХ является горизонтальной асимптотой графика плотности вероятности, т.к. при неограниченном возрастании по абсолютной величине аргумента л значение функции стремится к нулю.

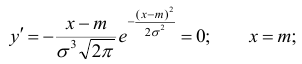

4) Найдём экстремум функции.

Т.к. при

5) Функция является симметричной относительно прямой x = а, т.к. разность

(х — а) входит в функцию плотности распределения в квадрате.

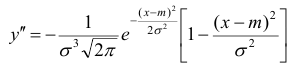

6) Для нахождения точек перегиба графика найдем вторую производную функции плотности.

При

В этих точках значение функции равно

Построим график функции плотности распределения (рис. 5).

Построены графики при м =0 и трёх возможных значениях среднеквадратичного отклонения

Если а > 0, то график сместится в положительном направлении, если а < 0 — в отрицательном.

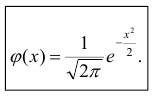

При а = 0 и

Функция Лапласа

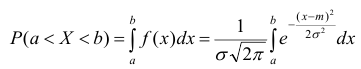

Найдём вероятность попадания случайной величины, распределенной по нормальному закону, в заданный интервал.

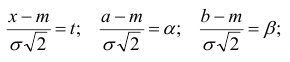

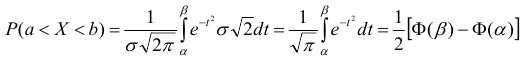

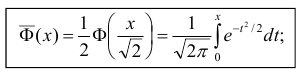

Обозначим

Тогда

Т.к. интеграл

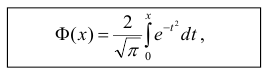

которая называется функцией Лапласа или интегралом вероятностей.

Значения этой функции при различных значениях х посчитаны и приводятся в специальных таблицах.

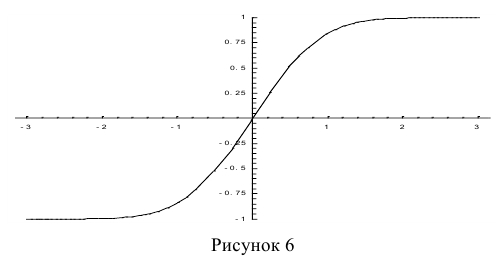

На рис. 6 показан график функции Лапласа.

Функция Лапласа обладает следующими свойствами:

- 1) Ф(0) = 0;

- 2) Ф(-х) = — Ф(х);

- 3)

Функцию Лапласа также называют функцией ошибок и обозначают

erf х.

Ещё используется нормированная функция Лапласа, которая связана с функцией Лапласа соотношением:

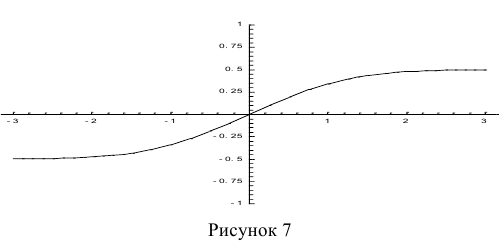

На рис. 7 показан график нормированной функции Лапласа.

Правило трёх сигм

При рассмотрении нормального закона распределения выделяется важный частный случай, известный как правило трех сигм.

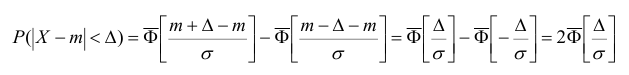

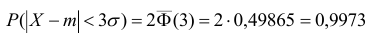

Запишем вероятность того, что отклонение нормально распределенной случайной величины от математического ожидания меньше заданной величины

Если принять

Т.е. вероятность того, что случайная величина отклонится от своего математического ожидание на величину, большую, чем утроенное среднее квадратичное отклонение, практически равна нулю.

Это правило называется правилом трех сигм.

Не практике считается, что если для какой-либо случайной величины выполняется правило трёх сигм, то эта случайная величина имеет нормальное распределение.

Пример:

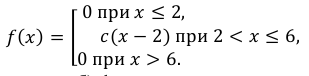

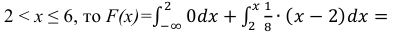

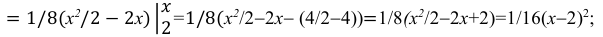

Случайная величина Х задана плотностью распределения вероятностей:

Найти: а) значение с; б) функцию распределения F(х) и построить ее график; в)

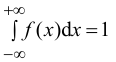

Решение:

а) Значение с найдем из условия нормировки:

Следовательно,

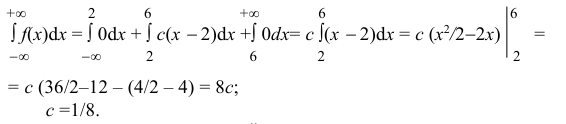

б) Известно, что

Поэтому, если

если

если

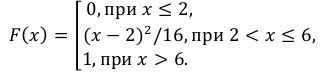

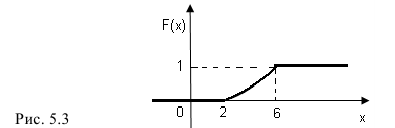

Таким образом,

График функции F(х) изображен на рис. 5. 3.

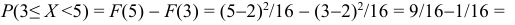

в)

Пример:

Случайная величина Х задана функцией распределения:

Найти дифференциальную функцию распределения

Решение:

Так как

Пример:

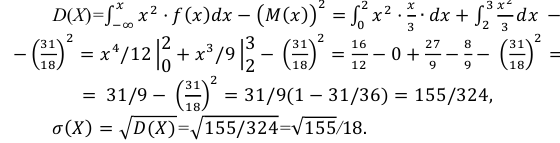

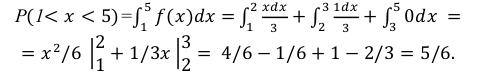

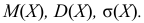

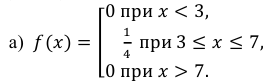

Случайная величина Х задана дифференциальной функцией

Найти

Решение:

Некоторые законы распределения непрерывной случайной величины

Пример:

Случайная величина Х равномерно распределена на отрезке [3;7]. Найти:

а) плотность распределения вероятностей

б) функцию распределения

в)

Решение: Воспользовавшись формулами, рассмотренными выше, при а = 3, b = 7, находим:

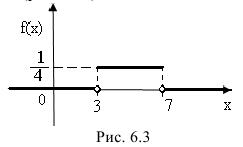

Построим ее график (рис. 6.3):

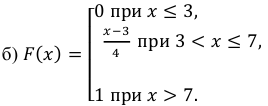

Построим ее график (рис. 6.4):

Пример:

Среднее время безотказной работы прибора равно 100 ч.

Полагая, что время безотказной работы прибора имеет показательный закон распределения, найти:

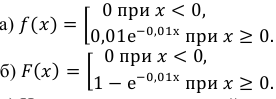

а) плотность распределения вероятностей;

б) функцию распределения;

в) вероятность того, что время безотказной работы прибора превысит 120 ч.

Решение.

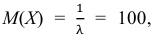

По условию математическое ожидание

откуда

Следовательно,

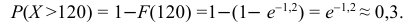

в) Искомую вероятность найдем, используя функцию распределения:

Пример:

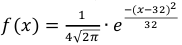

Случайная величина Х распределена нормально с математическим ожиданием 32 и дисперсией 16. Найти: а) плотность распределения вероятностей

Решение:

По условию m = 32, σ2 = 16, следовательно, σ = 4, тогда

а)

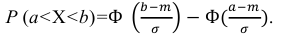

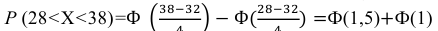

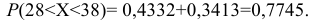

б) Воспользуемся формулой:

Подставив a = 28, b = 38, m = 32, σ = 4, получим

По таблице значений функции Ф(х) находим Ф(1,5) = 0,4332, Ф(1) = 0,3413.

Итак, искомая вероятность:

Заключение по лекции:

В лекции мы рассмотрели законы распределения непрерывных величин.

- Закон больших чисел

- Генеральная и выборочная совокупности

- Интервальные оценки параметров распределения

- Алгебра событий — определение и вычисление

- Правило «трех сигм» в теории вероятности

- Производящие функции

- Теоремы теории вероятностей

- Основные законы распределения дискретных случайных величин

Результат любого измерения не определён однозначно и имеет случайную составляющую.

Поэтому адекватным языком для описания погрешностей является язык вероятностей.

Тот факт, что значение некоторой величины «случайно», не означает, что

она может принимать совершенно произвольные значения. Ясно, что частоты, с которыми

возникает те или иные значения, различны. Вероятностные законы, которым

подчиняются случайные величины, называют распределениями.

2.1 Случайная величина

Случайной будем называть величину, значение которой не может быть достоверно определено экспериментатором. Чаще всего подразумевается, что случайная величина будет изменяться при многократном повторении одного и того же эксперимента. При интерпретации результатов измерений в физических экспериментах, обычно случайными также считаются величины, значение которых является фиксированным, но не известно экспериментатору. Например смещение нуля шкалы прибора. Для формализации работы со случайными величинами используют понятие вероятности. Численное значение вероятности того, что какая-то величина примет то или иное значение определяется либо как относительная частота наблюдения того или иного значения при повторении опыта большое количество раз, либо как оценка на основе данных других экспериментов.

Замечание.

Хотя понятия вероятности и случайной величины являются основополагающими, в литературе нет единства в их определении. Обсуждение формальных тонкостей или построение строгой теории лежит за пределами данного пособия. Поэтому на начальном этапе лучше использовать «интуитивное» понимание этих сущностей. Заинтересованным читателям рекомендуем обратиться к специальной литературе: [5].

Рассмотрим случайную физическую величину x, которая при измерениях может

принимать непрерывный набор значений. Пусть

P[x0,x0+δx] — вероятность того, что результат окажется вблизи

некоторой точки x0 в пределах интервала δx: x∈[x0,x0+δx].

Устремим интервал

δx к нулю. Нетрудно понять, что вероятность попасть в этот интервал

также будет стремиться к нулю. Однако отношение

w(x0)=P[x0,x0+δx]δx будет оставаться конечным.

Функцию w(x) называют плотностью распределения вероятности или кратко

распределением непрерывной случайной величины x.

Замечание. В математической литературе распределением часто называют не функцию

w(x), а её интеграл W(x)=∫w(x)𝑑x. Такую функцию в физике принято

называть интегральным или кумулятивным распределением. В англоязычной литературе

для этих функций принято использовать сокращения:

pdf (probability distribution function) и

cdf (cumulative distribution function)

соответственно.

Гистограммы.

Проиллюстрируем наглядно понятие плотности распределения. Результат

большого числа измерений случайной величины удобно представить с помощью

специального типа графика — гистограммы.

Для этого область значений x, размещённую на оси абсцисс, разобьём на

равные малые интервалы — «корзины» или «бины» (англ. bins)

некоторого размера h. По оси ординат будем откладывать долю измерений w,

результаты которых попадают в соответствующую корзину. А именно,

пусть k — номер корзины; nk — число измерений, попавших

в диапазон x∈[kh,(k+1)h]. Тогда на графике изобразим «столбик»

шириной h и высотой wk=nk/n.

В результате получим картину, подобную изображённой на рис. 2.1.

σ=1,0, h=0,1, n=104)

Высоты построенных столбиков будут приближённо соответствовать значению

плотности распределения w(x) вблизи соответствующей точки x.

Если устремить число измерений к бесконечности (n→∞), а ширину корзин

к нулю (h→0), то огибающая гистограммы будет стремиться к некоторой

непрерывной функции w(x).

Самые высокие столбики гистограммы будут группироваться вблизи максимума

функции w(x) — это наиболее вероятное значение случайной величины.

Если отклонения в положительную и отрицательную стороны равновероятны,

то гистограмма будет симметрична — в таком случае среднее значение ⟨x⟩

также будет лежать вблизи этого максимума. Ширина гистограммы будет характеризовать разброс

значений случайной величины — по порядку величины

она, как правило, близка к среднеквадратичному отклонению sx.

Свойства распределений.

Из определения функции w(x) следует, что вероятность получить в результате

эксперимента величину x в диапазоне от a до b

можно найти, вычислив интеграл:

| Px∈[a,b]=∫abw(x)𝑑x. | (2.1) |

Согласно определению вероятности, сумма вероятностей для всех возможных случаев

всегда равна единице. Поэтому интеграл распределения w(x) по всей области

значений x (то есть суммарная площадь под графиком w(x)) равен единице:

Это соотношение называют условием нормировки.

Среднее и дисперсия.

Вычислим среднее по построенной гистограмме. Если размер корзин

h достаточно мал, все измерения в пределах одной корзины можно считать примерно

одинаковыми. Тогда среднее арифметическое всех результатов можно вычислить как

Переходя к пределу, получим следующее определение среднего значения

случайной величины:

где интегрирование ведётся по всей области значений x.

В теории вероятностей x¯ также называют математическим ожиданием

распределения.

Величину

| σ2=(x-x¯)2¯=∫(x-x¯)2w𝑑x | (2.3) |

называют дисперсией распределения. Значение σ есть

срекднеквадратичное отклонение в пределе n→∞. Оно имеет ту

же размерность, что и сама величина x и характеризует разброс распределения.

Именно эту величину, как правило, приводят как характеристику погрешности

измерения x.

Доверительный интервал.

Обозначим как P|Δx|<δ вероятность

того, что отклонение от среднего Δx=x-x¯ составит величину,

не превосходящую по модулю значение δ:

| P|Δx|<δ=∫x¯-δx¯+δw(x)𝑑x. | (2.4) |

Эту величину называют доверительной вероятностью для

доверительного интервала |x-x¯|≤δ.

2.2 Нормальное распределение

Одним из наиболее примечательных результатов теории вероятностей является

так называемая центральная предельная теорема. Она утверждает,

что сумма большого количества независимых случайных слагаемых, каждое

из которых вносит в эту сумму относительно малый вклад, подчиняется

универсальному закону, не зависимо от того, каким вероятностным законам

подчиняются её составляющие, — так называемому нормальному

распределению (или распределению Гаусса).

Доказательство теоремы довольно громоздко и мы его не приводим (его можно найти

в любом учебнике по теории вероятностей). Остановимся

кратко на том, что такое нормальное распределение и его основных свойствах.

Плотность нормального распределения выражается следующей формулой:

| w𝒩(x)=12πσe-(x-x¯)22σ2. | (2.5) |

Здесь x¯ и σ

— параметры нормального распределения: x¯ равно

среднему значению x, a σ —

среднеквадратичному отклонению, вычисленным в пределе n→∞.

Как видно из рис. 2.1, распределение представляет собой

симметричный

«колокол», положение вершины которого

соответствует x¯ (ввиду симметрии оно же

совпадает с наиболее вероятным значением — максимумом

функции w𝒩(x)).

При значительном отклонении x от среднего величина

w𝒩(x)

очень быстро убывает. Это означает, что вероятность встретить отклонения,

существенно большие, чем σ, оказывается пренебрежимо

мала. Ширина «колокола» по порядку величины

равна σ — она характеризует «разброс»

экспериментальных данных относительно среднего значения.

Замечание. Точки x=x¯±σ являются точками

перегиба графика w(x) (в них вторая производная по x

обращается в нуль, w′′=0), а их положение по высоте составляет

w(x¯±σ)/w(x¯)=e-1/2≈0,61

от высоты вершины.

Универсальный характер центральной предельной теоремы позволяет широко

применять на практике нормальное (гауссово) распределение для обработки

результатов измерений, поскольку часто случайные погрешности складываются из

множества случайных независимых факторов. Заметим, что на практике

для приближённой оценки параметров нормального распределения

случайной величины используются выборочные значения среднего

и дисперсии: x¯≈⟨x⟩, sx≈σx.

Вычислим некоторые доверительные вероятности (2.4) для нормально Замечание. Значение интеграла вида ∫e-x2/2𝑑x Вероятность того, что результат отдельного измерения x окажется Вероятность отклонения в пределах x¯±2σ: а в пределах x¯±3σ: Иными словами, при большом числе измерений нормально распределённой Пример. В сообщениях об открытии бозона Хиггса на Большом адронном коллайдере Полученные значения доверительных вероятностей используются при означает, что измеренное значение лежит в диапазоне (доверительном Замечание. Хотя нормальный закон распределения встречается на практике довольно Теперь мы можем дать количественный критерий для сравнения двух измеренных Пусть x1 и x2 (x1≠x2) измерены с Допустим, одна из величин известна с существенно большей точностью: Пусть погрешности измерений сравнимы по порядку величины: Замечание. Изложенные здесь соображения применимы, только если x¯ иx-x0σ2=2w(x)σ1=1

Доверительные вероятности.

распределённых случайных величин.

(его называют интегралом ошибок) в элементарных функциях не выражается,

но легко находится численно.

в пределах x¯±σ оказывается равна

P|Δx|<σ=∫x¯-σx¯+σw𝒩𝑑x≈0,68.

величины можно ожидать, что лишь треть измерений выпадут за пределы интервала

[x¯-σ,x¯+σ]. При этом около 5%

измерений выпадут за пределы [x¯-2σ;x¯+2σ],

и лишь 0,27% окажутся за пределами

[x¯-3σ;x¯+3σ].

говорилось о том, что исследователи ждали подтверждение результатов

с точностью «5 сигма». Используя нормальное распределение (2.5)

нетрудно посчитать, что они использовали доверительную вероятность

P≈1-5,7⋅10-7=0,99999943. Такую точность можно назвать фантастической.

стандартной записи результатов измерений. В физических измерениях

(в частности, в учебной лаборатории), как правило, используется P=0,68,

то есть, запись

интервале) x∈[x¯-δx;x¯+δx] с

вероятностью 68%. Таким образом погрешность ±δx считается

равной одному среднеквадратичному отклонению: δx=σ.

В технических измерениях чаще используется P=0,95, то есть под

абсолютной погрешностью имеется в виду удвоенное среднеквадратичное

отклонение, δx=2σ. Во избежание разночтений доверительную

вероятность следует указывать отдельно.

часто, стоит помнить, что он реализуется далеко не всегда.

Полученные выше соотношения для вероятностей попадания значений в

доверительные интервалы можно использовать в качестве простейшего

признака нормальности распределения: в частности, если количество попадающих

в интервал ±σ результатов существенно отличается от 2/3 — это повод

для более детального исследования закона распределения ошибок.Сравнение результатов измерений.

величин или двух результатов измерения одной и той же величины.

погрешностями σ1 и σ2 соответственно.

Ясно, что если различие результатов |x2-x1| невелико,

его можно объяснить просто случайными отклонениями.

Если же теория предсказывает, что вероятность обнаружить такое отклонение

слишком мала, различие результатов следует признать значимым.

Предварительно необходимо договориться о соответствующем граничном значении

вероятности. Универсального значения здесь быть не может,

поэтому приходится полагаться на субъективный выбор исследователя. Часто

в качестве «разумной» границы выбирают вероятность 5%,

что, как видно из изложенного выше, для нормального распределения

соответствует отклонению более, чем на 2σ.

σ2≪σ1 (например, x1 — результат, полученный

студентом в лаборатории, x2 — справочное значение).

Поскольку σ2 мало, x2 можно принять за «истинное»:

x2≈x¯. Предполагая, что погрешность измерения

x1 подчиняется нормальному закону с и дисперсией σ12,

можно утверждать, что

различие считают будет значимы, если

σ1∼σ2. В теории вероятностей показывается, что

линейная комбинация нормально распределённых величин также имеет нормальное

распределение с дисперсией σ2=σ12+σ22

(см. также правила сложения погрешностей (2.7)). Тогда

для проверки гипотезы о том, что x1 и x2 являются измерениями

одной и той же величины, нужно вычислить, является ли значимым отклонение

|x1-x2| от нуля при σ=σ12+σ22.

Пример. Два студента получили следующие значения для теплоты испарения

некоторой жидкости: x1=40,3±0,2 кДж/моль и

x2=41,0±0,3 кДж/моль, где погрешность соответствует

одному стандартному отклонению. Можно ли утверждать, что они исследовали

одну и ту же жидкость?

Имеем наблюдаемую разность |x1-x2|=0,7 кДж/моль,

среднеквадратичное отклонение для разности

σ=0,22+0,32=0,36 кДж/моль.

Их отношение |x2-x1|σ≈2. Из

свойств нормального распределения находим вероятность того, что измерялась

одна и та же величина, а различия в ответах возникли из-за случайных

ошибок: P≈5%. Ответ на вопрос, «достаточно»

ли мала или велика эта вероятность, остаётся на усмотрение исследователя.

его стандартное отклонение σ получены на основании достаточно

большой выборки n≫1 (или заданы точно). При небольшом числе измерений

(n≲10) выборочные средние ⟨x⟩ и среднеквадратичное отклонение

sx сами имеют довольно большую ошибку, а

их распределение будет описываться не нормальным законом, а так

называемым t-распределением Стъюдента. В частности, в зависимости от

значения n интервал ⟨x⟩±sx будет соответствовать несколько

меньшей доверительной вероятности, чем P=0,68. Особенно резко различия

проявляются при высоких уровнях доверительных вероятностей P→1.

2.3 Независимые величины

Величины x и y называют независимыми если результат измерения одной

из них никак не влияет на результат измерения другой. Для таких величин вероятность того, что x окажется в некоторой области X, и одновременно y — в области Y,

равна произведению соответствующих вероятностей:

Обозначим отклонения величин от их средних как Δx=x-x¯ и

Δy=y-y¯.

Средние значения этих отклонений равны, очевидно, нулю: Δx¯=x¯-x¯=0,

Δy¯=0. Из независимости величин x и y следует,

что среднее значение от произведения Δx⋅Δy¯

равно произведению средних Δx¯⋅Δy¯

и, следовательно, равно нулю:

| Δx⋅Δy¯=Δx¯⋅Δy¯=0. | (2.6) |

Пусть измеряемая величина z=x+y складывается из двух независимых

случайных слагаемых x и y, для которых известны средние

x¯ и y¯, и их среднеквадратичные погрешности

σx и σy. Непосредственно из определения (1.1)

следует, что среднее суммы равно сумме средних:

Найдём дисперсию σz2. В силу независимости имеем

| Δz2¯=Δx2¯+Δy2¯+2Δx⋅Δy¯≈Δx2¯+Δy2¯, |

то есть:

Таким образом, при сложении независимых величин их погрешности

складываются среднеквадратичным образом.

Подчеркнём, что для справедливости соотношения (2.7)

величины x и y не обязаны быть нормально распределёнными —

достаточно существования конечных значений их дисперсий. Однако можно

показать, что если x и y распределены нормально, нормальным

будет и распределение их суммы.

Замечание. Требование независимости

слагаемых является принципиальным. Например, положим y=x. Тогда

z=2x. Здесь y и x, очевидно, зависят друг от друга. Используя

(2.7), находим σ2x=2σx,

что, конечно, неверно — непосредственно из определения

следует, что σ2x=2σx.

Отдельно стоит обсудить математическую структуру формулы (2.7).

Если одна из погрешностей много больше другой, например,

σx≫σy,

то меньшей погрешностью можно пренебречь, σx+y≈σx.

С другой стороны, если два источника погрешностей имеют один порядок

σx∼σy, то и σx+y∼σx∼σy.

Эти обстоятельства важны при планирования эксперимента: как правило,

величина, измеренная наименее точно, вносит наибольший вклад в погрешность

конечного результата. При этом, пока не устранены наиболее существенные

ошибки, бессмысленно гнаться за повышением точности измерения остальных

величин.

Пример. Пусть σy=σx/3,

тогда σz=σx1+19≈1,05σx,

то есть при различии двух погрешностей более, чем в 3 раза, поправка

к погрешности составляет менее 5%, и уже нет особого смысла в учёте

меньшей погрешности: σz≈σx. Это утверждение

касается сложения любых независимых источников погрешностей в эксперименте.

2.4 Погрешность среднего

Выборочное среднее арифметическое значение ⟨x⟩, найденное

по результатам n измерений, само является случайной величиной.

Действительно, если поставить серию одинаковых опытов по n измерений,

то в каждом опыте получится своё среднее значение, отличающееся от

предельного среднего x¯.

Вычислим среднеквадратичную погрешность среднего арифметического

σ⟨x⟩.

Рассмотрим вспомогательную сумму n слагаемых

Если {xi} есть набор независимых измерений

одной и той же физической величины, то мы можем, применяя результат

(2.7) предыдущего параграфа, записать

| σZ=σx12+σx22+…+σxn2=nσx, |

поскольку под корнем находится n одинаковых слагаемых. Отсюда с

учётом ⟨x⟩=Z/n получаем

Таким образом, погрешность среднего значения x по результатам

n независимых измерений оказывается в n раз меньше погрешности

отдельного измерения. Это один из важнейших результатов, позволяющий

уменьшать случайные погрешности эксперимента за счёт многократного

повторения измерений.

Подчеркнём отличия между σx и σ⟨x⟩:

величина σx — погрешность отдельного

измерения — является характеристикой разброса значений

в совокупности измерений {xi}, i=1..n. При

нормальном законе распределения примерно 68% измерений попадают в

интервал ⟨x⟩±σx;

величина σ⟨x⟩ — погрешность

среднего — характеризует точность, с которой определено

среднее значение измеряемой физической величины ⟨x⟩ относительно

предельного («истинного») среднего x¯;

при этом с доверительной вероятностью P=68% искомая величина x¯

лежит в интервале

⟨x⟩-σ⟨x⟩<x¯<⟨x⟩+σ⟨x⟩.

2.5 Результирующая погрешность опыта

Пусть для некоторого результата измерения известна оценка его максимальной

систематической погрешности Δсист и случайная

среднеквадратичная

погрешность σслуч. Какова «полная»

погрешность измерения?

Предположим для простоты, что измеряемая величина в принципе

может быть определена сколь угодно точно, так что можно говорить о

некотором её «истинном» значении xист

(иными словами, погрешность результата связана в основном именно с

процессом измерения). Назовём полной погрешностью измерения

среднеквадратичное значения отклонения от результата измерения от

«истинного»:

Отклонение x-xист можно представить как сумму случайного

отклонения от среднего δxслуч=x-x¯

и постоянной (но, вообще говоря, неизвестной) систематической составляющей

δxсист=x¯-xист=const:

Причём случайную составляющую можно считать независимой от систематической.

В таком случае из (2.7) находим:

| σполн2=⟨δxсист2⟩+⟨δxслуч2⟩≤Δсист2+σслуч2. | (2.9) |

Таким образом, для получения максимального значения полной

погрешности некоторого измерения нужно квадратично сложить максимальную

систематическую и случайную погрешности.

Если измерения проводятся многократно, то согласно (2.8)

случайная составляющая погрешности может быть уменьшена, а систематическая

составляющая при этом остаётся неизменной:

Отсюда следует важное практическое правило

(см. также обсуждение в п. 2.3): если случайная погрешность измерений

в 2–3 раза меньше предполагаемой систематической, то

нет смысла проводить многократные измерения в попытке уменьшить погрешность

всего эксперимента. В такой ситуации измерения достаточно повторить

2–3 раза — чтобы убедиться в повторяемости результата, исключить промахи

и проверить, что случайная ошибка действительно мала.

В противном случае повторение измерений может иметь смысл до

тех пор, пока погрешность среднего

σ⟨x⟩=σxn

не станет меньше систематической.

Замечание. Поскольку конкретная

величина систематической погрешности, как правило, не известна, её

можно в некотором смысле рассматривать наравне со случайной —

предположить, что её величина была определена по некоторому случайному

закону перед началом измерений (например, при изготовлении линейки

на заводе произошло некоторое случайное искажение шкалы). При такой

трактовке формулу (2.9) можно рассматривать просто

как частный случай формулы сложения погрешностей независимых величин

(2.7).

Подчеркнем, что вероятностный закон, которому подчиняется

систематическая ошибка, зачастую неизвестен. Поэтому неизвестно и

распределение итогового результата. Из этого, в частности, следует,

что мы не можем приписать интервалу x±Δсист какую-либо

определённую доверительную вероятность — она равна 0,68

только если систематическая ошибка имеет нормальное распределение.

Можно, конечно, предположить,

— и так часто делают — что, к примеру, ошибки

при изготовлении линеек на заводе имеют гауссов характер. Также часто

предполагают, что систематическая ошибка имеет равномерное

распределение (то есть «истинное» значение может с равной вероятностью

принять любое значение в пределах интервала ±Δсист).

Строго говоря, для этих предположений нет достаточных оснований.

Пример. В результате измерения диаметра проволоки микрометрическим винтом,

имеющим цену деления h=0,01 мм, получен следующий набор из n=8 значений:

Вычисляем среднее значение: ⟨d⟩≈386,3 мкм.

Среднеквадратичное отклонение:

σd≈9,2 мкм. Случайная погрешность среднего согласно

(2.8):

σ⟨d⟩=σd8≈3,2

мкм. Все результаты лежат в пределах ±2σd, поэтому нет

причин сомневаться в нормальности распределения. Максимальную погрешность

микрометра оценим как половину цены деления, Δ=h2=5 мкм.

Результирующая полная погрешность

σ≤Δ2+σd28≈6,0 мкм.

Видно, что σслуч≈Δсист и проводить дополнительные измерения

особого смысла нет. Окончательно результат измерений может быть представлен

в виде (см. также правила округления

результатов измерений в п. 4.3.2)

d=386±6мкм,εd=1,5%.

Заметим, что поскольку случайная погрешность и погрешность

прибора здесь имеют один порядок величины, наблюдаемый случайный разброс

данных может быть связан как с неоднородностью сечения проволоки,

так и с дефектами микрометра (например, с неровностями зажимов, люфтом

винта, сухим трением, деформацией проволоки под действием микрометра

и т. п.). Для ответа на вопрос, что именно вызвало разброс, требуются

дополнительные исследования, желательно с использованием более точных

приборов.

Пример. Измерение скорости

полёта пули было осуществлено с погрешностью δv=±1 м/c.

Результаты измерений для n=6 выстрелов представлены в таблице:

Усреднённый результат ⟨v⟩=162,0м/с,

среднеквадратичное отклонение σv=13,8м/c, случайная

ошибка для средней скорости

σv¯=σv/6=5,6м/с.

Поскольку разброс экспериментальных данных существенно превышает погрешность

каждого измерения, σv≫δv, он почти наверняка связан

с реальным различием скоростей пули в разных выстрелах, а не с ошибками

измерений. В качестве результата эксперимента представляют интерес

как среднее значение скоростей ⟨v⟩=162±6м/с

(ε≈4%), так и значение σv≈14м/с,

характеризующее разброс значений скоростей от выстрела к выстрелу.

Малая инструментальная погрешность в принципе позволяет более точно

измерить среднее и дисперсию, и исследовать закон распределения выстрелов

по скоростям более детально — для этого требуется набрать

бо́льшую статистику по выстрелам.

Пример. Измерение скорости

полёта пули было осуществлено с погрешностью δv=10 м/c. Результаты

измерений для n=6 выстрелов представлены в таблице:

Усреднённый результат ⟨v⟩=163,3м/с,

σv=12,1м/c, σ⟨v⟩=5м/с,

σполн≈11,2м/с. Инструментальная

погрешность каждого измерения превышает разброс данных, поэтому в

этом опыте затруднительно сделать вывод о различии скоростей от выстрела

к выстрелу. Результат измерений скорости пули:

⟨v⟩=163±11м/с,

ε≈7%. Проводить дополнительные выстрелы при такой

большой инструментальной погрешности особого смысла нет —

лучше поработать над точностью приборов и методикой измерений.

2.6 Обработка косвенных измерений

Косвенными называют измерения, полученные в результате расчётов,

использующих результаты прямых (то есть «непосредственных»)

измерений физических величин. Сформулируем основные правила пересчёта

погрешностей при косвенных измерениях.

2.6.1 Случай одной переменной

Пусть в эксперименте измеряется величина x, а её «наилучшее»

(в некотором смысле) значение равно x⋆ и оно известно с

погрешностью σx. После чего с помощью известной функции

вычисляется величина y=f(x).

В качестве «наилучшего» приближения для y используем значение функции

при «наилучшем» x:

Найдём величину погрешности σy. Обозначая отклонение измеряемой

величины как Δx=x-x⋆, и пользуясь определением производной,

при условии, что функция y(x) — гладкая

вблизи x≈x⋆, запишем

где f′≡dydx — производная фукнции f(x), взятая в точке

x⋆. Возведём полученное в квадрат, проведём усреднение

(σy2=⟨Δy2⟩,

σx2=⟨Δx2⟩), и затем снова извлечём

корень. В результате получим

Пример. Для степенной функции

y=Axn имеем σy=nAxn-1σx, откуда

σyy=nσxx,или εy=nεx,

то есть относительная погрешность степенной функции возрастает пропорционально

показателю степени n.

Пример. Для y=1/x имеем ε1/x=εx

— при обращении величины сохраняется её относительная

погрешность.

Упражнение. Найдите погрешность логарифма y=lnx, если известны x

и σx.

Упражнение. Найдите погрешность показательной функции y=ax,

если известны x и σx. Коэффициент a задан точно.

2.6.2 Случай многих переменных

Пусть величина u вычисляется по измеренным значениям нескольких

различных независимых физических величин x, y, …

на основе известного закона u=f(x,y,…). В качестве

наилучшего значения можно по-прежнему взять значение функции f

при наилучших значениях измеряемых параметров:

Для нахождения погрешности σu воспользуемся свойством,

известным из математического анализа, — малые приращения гладких

функции многих переменных складываются линейно, то есть справедлив

принцип суперпозиции малых приращений:

где символом fx′≡∂f∂x обозначена

частная производная функции f по переменной x —

то есть обычная производная f по x, взятая при условии, что

все остальные аргументы (кроме x) считаются постоянными параметрами.

Тогда пользуясь формулой для нахождения дисперсии суммы независимых

величин (2.7), получим соотношение, позволяющее вычислять

погрешности косвенных измерений для произвольной функции

u=f(x,y,…):

| σu2=fx′2σx2+fy′2σy2+… | (2.11) |

Это и есть искомая общая формула пересчёта погрешностей при косвенных

измерениях.

Отметим, что формулы (2.10) и (2.11) применимы

только если относительные отклонения всех величин малы

(εx,εy,…≪1),

а измерения проводятся вдали от особых точек функции f (производные

fx′, fy′ … не должны обращаться в бесконечность).

Также подчеркнём, что все полученные здесь формулы справедливы только

для независимых переменных x, y, …

Остановимся на некоторых важных частных случаях формулы

(2.11).

Пример. Для суммы (или разности) u=∑i=1naixi имеем

σu2=∑i=1nai2σxi2.

(2.12)

Пример. Найдём погрешность степенной функции:

u=xα⋅yβ⋅…. Тогда нетрудно получить,

что

σu2u2=α2σx2x2+β2σy2y2+…

или через относительные погрешности

εu2=α2εx2+β2εy2+…

(2.13)

Пример. Вычислим погрешность произведения и частного: u=xy или u=x/y.

Тогда в обоих случаях имеем

εu2=εx2+εy2,

(2.14)

то есть при умножении или делении относительные погрешности складываются

квадратично.

Пример. Рассмотрим несколько более сложный случай: нахождение угла по его тангенсу

u=arctgyx.

В таком случае, пользуясь тем, что (arctgz)′=11+z2,

где z=y/x, и используя производную сложной функции, находим

ux′=uz′zx′=-yx2+y2,

uy′=uz′zy′=xx2+y2, и наконец

σu2=y2σx2+x2σy2(x2+y2)2.

Упражнение. Найти погрешность вычисления гипотенузы z=x2+y2

прямоугольного треугольника по измеренным катетам x и y.

По итогам данного раздела можно дать следующие практические рекомендации.

-

•

Как правило, нет смысла увеличивать точность измерения какой-то одной

величины, если другие величины, используемые в расчётах, остаются

измеренными относительно грубо — всё равно итоговая погрешность

скорее всего будет определяться самым неточным измерением. Поэтому

все измерения имеет смысл проводить примерно с одной и той же

относительной погрешностью. -

•

При этом, как следует из (2.13), особое внимание

следует уделять измерению величин, возводимых при расчётах в степени

с большими показателями. А при сложных функциональных зависимостях

имеет смысл детально проанализировать структуру формулы

(2.11):

если вклад от некоторой величины в общую погрешность мал, нет смысла

гнаться за высокой точностью её измерения, и наоборот, точность некоторых

измерений может оказаться критически важной. -

•

Следует избегать измерения малых величин как разности двух близких

значений (например, толщины стенки цилиндра как разности внутреннего

и внешнего радиусов): если u=x-y, то абсолютная погрешность

σu=σx2+σy2

меняется мало, однако относительная погрешность

εu=σux-y

может оказаться неприемлемо большой, если x≈y.

Мода и медиана случайной величины.

Квантиль уровня случайной величины

- Краткая теория

- Примеры решения задач

Краткая теория

Кроме

математического ожидания и дисперсии, в теории вероятностей применяется еще ряд

числовых характеристик, отражающих те или иные особенности распределения.

Мода непрерывной и дискретной случайной величины

Модой

случайной величины называется ее наиболее вероятное значение, для которого

вероятность

или плотность вероятности

достигает максимума.

В

частности, наивероятнейшее значение числа успехов в схеме Бернулли – это мода

биномиального распределения.

Если

вероятность или плотность вероятности достигает максимума не в одной, а в

нескольких точках, распределение называется полимодальным.

Полимодальное распределение

Медиана непрерывной и дискретной случайной величины

Медианой случайной величины

называют число

, такое, что

.

То есть вероятность того, что

случайная величина

примет

значение, меньшее медианы

или больше ее,

одна и та же и равна

.

Для дискретной случайной величины

это число может

не совпадать ни с одним из значений

. Поэтому медиану дискретной случайной величины

определяют как любое число

, лежащее между двумя соседними возможными значениями

и

такими, что

.

Для непрерывной случайной величины,

геометрически, вертикальная прямая

, проходящая через точку с абсциссой, равной

, делит площадь фигуры под кривой распределения на две

равные части.

Медиана на графике плотности вероятности непрерывной

случайной величины

Очевидно, что в точке

функция распределения непрерывной случайной

величины равна

, то есть

.

Медиана на графике функции распределения непрерывной

случайной величины

Квантили и процентные точки случайной величины

Наряду с отмеченными выше числовыми

характеристиками для описания случайной величины используется понятие квантилей

и процентных точек.

Квантилем уровня

(или

– квантилем)

называется такое значение

случайной

величины, при котором функция ее распределения принимает значение, равное

, то есть:

Некоторые квантили получили особое

называние. Очевидно, что введенная выше медиана случайной величины есть

квантиль уровня 0,5, то есть

. Квантили

и

получили

название соответственно верхнего и нижнего квантилей. Также в литературе

встречаются термины: децили (под которыми понимают квантили

) и процентили (квантили

).

С понятием квантиля тесно связано

понятие процентной точки. Под

точкой

подразумевается квантиль

, то есть такое значение случайной величины

, при котором

.

Смежные темы решебника:

- Структурные средние в статистике — мода, медиана, квантиль, дециль

- Дискретная случайная величина

- Непрерывная случайная величина

Примеры решения задач

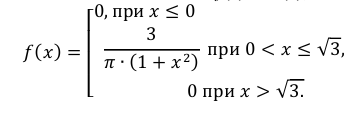

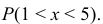

Пример 1

Найти

моду, медиану, квантиль

и 40%-ну точку случайной величины

c плотностью распределения:

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Исследуем

функцию на наибольшее и наименьшее значение на отрезке

Производная:

Производная

не обращается в нуль.

Значения

на концах отрезка:

Следовательно,

мода:

Медиану

найдем из условия:

В нашем

случае получаем:

Значение

принадлежит отрезку

,

следовательно, искомая медиана:

Квантиль

найдем из уравнения:

Значение

принадлежит отрезку

,

следовательно, искомый квантиль:

Найдем

40%-ную точку случайной величины

, или квантиль

из уравнения:

Значение

принадлежит отрезку

,

следовательно, искомая точка:

Ответ:

.

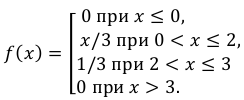

Пример 2

Найти

моду, медиану, квантиль

случайной величины

, заданной функцией

распределения:

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

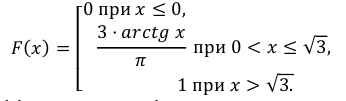

Найдем

плотность распределения:

Исследуем

функцию на наибольшее и наименьшее значение на отрезке

Производная:

Значения

функции

в стационарных точках и на концах отрезка:

Распределение

полимодальное:

Медиану

найдем из уравнения:

Итак,

медиана:

Квантиль

найдем из уравнения:

Итак:

Ответ:

.

- Краткая теория

- Примеры решения задач