In linear algebra, linear transformations can be represented by matrices. If

for some

Uses[edit]

Matrices allow arbitrary linear transformations to be displayed in a consistent format, suitable for computation.[3] This also allows transformations to be composed easily (by multiplying their matrices).

Linear transformations are not the only ones that can be represented by matrices. Some transformations that are non-linear on an n-dimensional Euclidean space Rn can be represented as linear transformations on the n+1-dimensional space Rn+1. These include both affine transformations (such as translation) and projective transformations. For this reason, 4×4 transformation matrices are widely used in 3D computer graphics. These n+1-dimensional transformation matrices are called, depending on their application, affine transformation matrices, projective transformation matrices, or more generally non-linear transformation matrices. With respect to an n-dimensional matrix, an n+1-dimensional matrix can be described as an augmented matrix.

In the physical sciences, an active transformation is one which actually changes the physical position of a system, and makes sense even in the absence of a coordinate system whereas a passive transformation is a change in the coordinate description of the physical system (change of basis). The distinction between active and passive transformations is important. By default, by transformation, mathematicians usually mean active transformations, while physicists could mean either.

Put differently, a passive transformation refers to description of the same object as viewed from two different coordinate frames.

Finding the matrix of a transformation[edit]

If one has a linear transformation

For example, the function

The matrix representation of vectors and operators depends on the chosen basis; a similar matrix will result from an alternate basis. Nevertheless, the method to find the components remains the same.

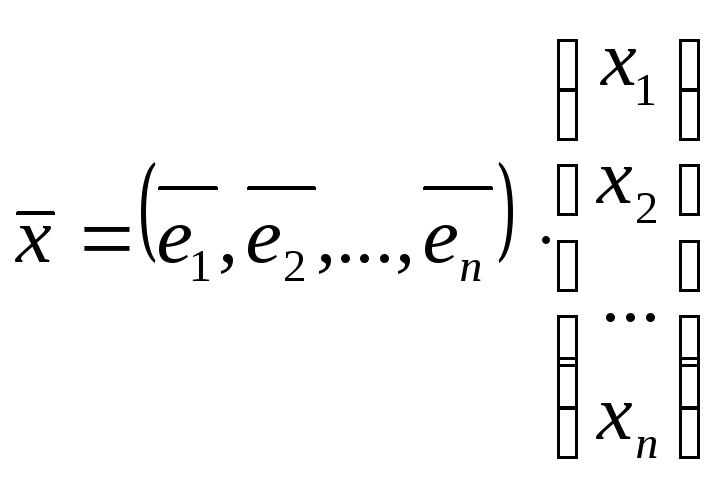

To elaborate, vector

![{displaystyle [mathbf {v} ]_{E}={begin{bmatrix}v_{1}&v_{2}&cdots &v_{n}end{bmatrix}}^{mathrm {T} }}](https://wikimedia.org/api/rest_v1/media/math/render/svg/99c191b7fbcd3d20b54295dbd8203c79c0bac76f)

Now, express the result of the transformation matrix A upon

The

This equation defines the wanted elements,

Eigenbasis and diagonal matrix[edit]

Yet, there is a special basis for an operator in which the components form a diagonal matrix and, thus, multiplication complexity reduces to n. Being diagonal means that all coefficients

With diagonalization, it is often possible to translate to and from eigenbases.

Examples in 2 dimensions[edit]

Most common geometric transformations that keep the origin fixed are linear, including rotation, scaling, shearing, reflection, and orthogonal projection; if an affine transformation is not a pure translation it keeps some point fixed, and that point can be chosen as origin to make the transformation linear. In two dimensions, linear transformations can be represented using a 2×2 transformation matrix.

Stretching[edit]

A stretch in the xy-plane is a linear transformation which enlarges all distances in a particular direction by a constant factor but does not affect distances in the perpendicular direction. We only consider stretches along the x-axis and y-axis. A stretch along the x-axis has the form x’ = kx; y’ = y for some positive constant k. (Note that if k > 1, then this really is a «stretch»; if k < 1, it is technically a «compression», but we still call it a stretch. Also, if k = 1, then the transformation is an identity, i.e. it has no effect.)

The matrix associated with a stretch by a factor k along the x-axis is given by:

Similarly, a stretch by a factor k along the y-axis has the form x’ = x; y’ = ky, so the matrix associated with this transformation is

Squeezing[edit]

If the two stretches above are combined with reciprocal values, then the transformation matrix represents a squeeze mapping:

A square with sides parallel to the axes is transformed to a rectangle that has the same area as the square. The reciprocal stretch and compression leave the area invariant.

Rotation[edit]

For rotation by an angle θ counterclockwise (positive direction) about the origin the functional form is

Similarly, for a rotation clockwise (negative direction) about the origin, the functional form is

These formulae assume that the x axis points right and the y axis points up.

Shearing[edit]

For shear mapping (visually similar to slanting), there are two possibilities.

A shear parallel to the x axis has

A shear parallel to the y axis has

Reflection[edit]

For reflection about a line that goes through the origin, let

Orthogonal projection[edit]

To project a vector orthogonally onto a line that goes through the origin, let

As with reflections, the orthogonal projection onto a line that does not pass through the origin is an affine, not linear, transformation.

Parallel projections are also linear transformations and can be represented simply by a matrix. However, perspective projections are not, and to represent these with a matrix, homogeneous coordinates can be used.

Examples in 3D computer graphics[edit]

Rotation[edit]

The matrix to rotate an angle θ about any axis defined by unit vector (x,y,z) is [7]

Reflection[edit]

To reflect a point through a plane

Note that these are particular cases of a Householder reflection in two and three dimensions. A reflection about a line or plane that does not go through the origin is not a linear transformation — it is an affine transformation — as a 4×4 affine transformation matrix, it can be expressed as follows (assuming the normal is a unit vector):

where

If the 4th component of the vector is 0 instead of 1, then only the vector’s direction is reflected and its magnitude remains unchanged, as if it were mirrored through a parallel plane that passes through the origin. This is a useful property as it allows the transformation of both positional vectors and normal vectors with the same matrix. See homogeneous coordinates and affine transformations below for further explanation.

Composing and inverting transformations[edit]

One of the main motivations for using matrices to represent linear transformations is that transformations can then be easily composed and inverted.

Composition is accomplished by matrix multiplication. Row and column vectors are operated upon by matrices, rows on the left and columns on the right. Since text reads from left to right, column vectors are preferred when transformation matrices are composed:

If A and B are the matrices of two linear transformations, then the effect of first applying A and then B to a column vector

In other words, the matrix of the combined transformation A followed by B is simply the product of the individual matrices.

When A is an invertible matrix there is a matrix A−1 that represents a transformation that «undoes» A since its composition with A is the identity matrix. In some practical applications, inversion can be computed using general inversion algorithms or by performing inverse operations (that have obvious geometric interpretation, like rotating in opposite direction) and then composing them in reverse order. Reflection matrices are a special case because they are their own inverses and don’t need to be separately calculated.

Other kinds of transformations[edit]

Affine transformations[edit]

Effect of applying various 2D affine transformation matrices on a unit square. Note that the reflection matrices are special cases of the scaling matrix.

Affine transformations on the 2D plane can be performed in three dimensions. Translation is done by shearing parallel to the xy plane, and rotation is performed around the z axis.

To represent affine transformations with matrices, we can use homogeneous coordinates. This means representing a 2-vector (x, y) as a 3-vector (x, y, 1), and similarly for higher dimensions. Using this system, translation can be expressed with matrix multiplication. The functional form

All ordinary linear transformations are included in the set of affine transformations, and can be described as a simplified form of affine transformations. Therefore, any linear transformation can also be represented by a general transformation matrix. The latter is obtained by expanding the corresponding linear transformation matrix by one row and column, filling the extra space with zeros except for the lower-right corner, which must be set to 1. For example, the counter-clockwise rotation matrix from above becomes:

Using transformation matrices containing homogeneous coordinates, translations become linear, and thus can be seamlessly intermixed with all other types of transformations. The reason is that the real plane is mapped to the w = 1 plane in real projective space, and so translation in real Euclidean space can be represented as a shear in real projective space. Although a translation is a non-linear transformation in a 2-D or 3-D Euclidean space described by Cartesian coordinates (i.e. it can’t be combined with other transformations while preserving commutativity and other properties), it becomes, in a 3-D or 4-D projective space described by homogeneous coordinates, a simple linear transformation (a shear).

More affine transformations can be obtained by composition of two or more affine transformations. For example, given a translation T’ with vector

When using affine transformations, the homogeneous component of a coordinate vector (normally called w) will never be altered. One can therefore safely assume that it is always 1 and ignore it. However, this is not true when using perspective projections.

Perspective projection[edit]

Comparison of the effects of applying 2D affine and perspective transformation matrices on a unit square.

Another type of transformation, of importance in 3D computer graphics, is the perspective projection. Whereas parallel projections are used to project points onto the image plane along parallel lines, the perspective projection projects points onto the image plane along lines that emanate from a single point, called the center of projection. This means that an object has a smaller projection when it is far away from the center of projection and a larger projection when it is closer (see also reciprocal function).

The simplest perspective projection uses the origin as the center of projection, and the plane at

After carrying out the matrix multiplication, the homogeneous component

More complicated perspective projections can be composed by combining this one with rotations, scales, translations, and shears to move the image plane and center of projection wherever they are desired.

See also[edit]

- 3D projection

- Change of basis

- Image rectification

- Pose (computer vision)

- Rigid transformation

- Transformation (function)

- Transformation geometry

References[edit]

- ^ Rafael Artzy (1965) Linear Geometry

- ^ J. W. P. Hirschfeld (1979) Projective Geometry of Finite Fields, Clarendon Press

- ^ Gentle, James E. (2007). «Matrix Transformations and Factorizations». Matrix Algebra: Theory, Computations, and Applications in Statistics. Springer. ISBN 9780387708737.

- ^ Nearing, James (2010). «Chapter 7.3 Examples of Operators» (PDF). Mathematical Tools for Physics. ISBN 978-0486482125. Retrieved January 1, 2012.

- ^ Nearing, James (2010). «Chapter 7.9: Eigenvalues and Eigenvectors» (PDF). Mathematical Tools for Physics. ISBN 978-0486482125. Retrieved January 1, 2012.

- ^ http://ocw.mit.edu/courses/aeronautics-and-astronautics/16-07-dynamics-fall-2009/lecture-notes/MIT16_07F09_Lec03.pdf[bare URL PDF]

- ^ Szymanski, John E. (1989). Basic Mathematics for Electronic Engineers:Models and Applications. Taylor & Francis. p. 154. ISBN 0278000681.

- ^ Cédric Jules (February 25, 2015). «2D transformation matrices baking».

External links[edit]

- The Matrix Page Practical examples in POV-Ray

- Reference page — Rotation of axes

- Linear Transformation Calculator

- Transformation Applet — Generate matrices from 2D transformations and vice versa.

- Coordinate transformation under rotation in 2D

- Excel Fun — Build 3D graphics from a spreadsheet

Все курсы > Линейная алгебра > Занятие 3

На прошлых занятиях мы поговорили про векторы и векторные пространства. Сегодня рассмотрим матрицы и линейные преобразования.

Ноутбук к сегодняшнему занятию⧉

Как матрицы преобразовывают пространство

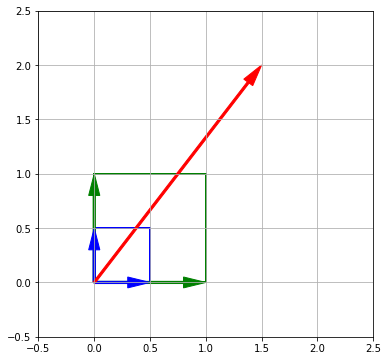

Посмотрим, как матрица может изменить положение вектора.

Преобразование базисных векторов

Начнем с базисных векторов. Возьмем матрицу $A$ и два базисных вектора $mathbf i$ и $mathbf j$.

|

A = np.array([[2, 3], [5, 1]]) i = np.array([1, 0]) j = np.array([0, 1]) |

Если поочередно умножить матрицу на каждый из векторов, то первый столбец матрицы $A$ определит новые координаты вектора $mathbf i$, второй столбец — вектора $mathbf j$.

$$ begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} cdot begin{bmatrix} 1 \ 0 end{bmatrix} = begin{bmatrix} 2 \ 5 end{bmatrix} $$

$$ begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} cdot begin{bmatrix} 0 \ 1 end{bmatrix} = begin{bmatrix} 3 \ 1 end{bmatrix} $$

Так трансформационная матрица (transformation matrix, левый множитель) оказывает влияние на базисные (и все остальные) векторы и, таким образом, меняет пространство.

Посмотрим на результат на графике.

|

ax = plt.axes() plt.xlim([—0.5, 5]) plt.ylim([—0.5, 6]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # найдем координаты с помощью произведения arrow_a = ax.arrow(0, 0, np.dot(A, i)[0], np.dot(A, i)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘r’, ec = ‘r’) arrow_b = ax.arrow(0, 0, np.dot(A, j)[0], np.dot(A, j)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘r’, ec = ‘r’) plt.show() |

Продемонстрируем, что при преобразовании любого вектора, мы по сути меняем базисные векторы, умноженные на скаляр. Рассмотрим, как в результате умножения матрицы A на вектор $mathbf r$, мы получим новый вектор $mathbf r’$.

$$A cdot mathbf r = mathbf r’ $$

Очевидно, мы можем умножать векторы $mathbf r$ и $mathbf r’$ на скаляр $n$ или представить их в виде суммы двух (базисных) векторов.

$$A cdot n mathbf r = n mathbf r’ $$

$$A cdot (mathbf i + mathbf j) = (mathbf i + mathbf j)’ $$

Тогда справедливо, что

$$A cdot (n mathbf i+m mathbf j) = (n mathbf i+m mathbf j)’ $$

Выполним умножение.

$$ A cdot (n mathbf i + m mathbf j) = (nA mathbf i+mA mathbf j) = n mathbf i’ + m mathbf j’ $$

Обратите внимание, что умножение матрицы на скаляр коммутативно, то есть $A n mathbf i = n A mathbf i $.

Таким образом, можно сказать, что при преобразовании пространства матрица преобразует масштабированные (scaled) базисные векторы. Приведем пример.

$$ begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} begin{bmatrix} 2 \ 4 end{bmatrix} = begin{bmatrix} 16 \ 14 end{bmatrix} $$

$$ begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} left( 2 begin{bmatrix} 1 \ 0 end{bmatrix} + 4 begin{bmatrix} 0 \ 1 end{bmatrix} right) = begin{bmatrix} 16 \ 14 end{bmatrix} $$

$$ 2 begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} begin{bmatrix} 1 \ 0 end{bmatrix} + 4 begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} begin{bmatrix} 0 \ 1 end{bmatrix} = begin{bmatrix} 16 \ 14 end{bmatrix} $$

$$ 2 begin{bmatrix} 2 \ 5 end{bmatrix} + 4 begin{bmatrix} 3 \ 1 end{bmatrix} = begin{bmatrix} 16 \ 14 end{bmatrix} $$

Иначе говоря, «новые», преобразованные векторы будут иметь те же координаты относительно нового базиса, что и исходный вектор, относительно исходного базиса (потому что $n$ и $m$ или 2 и 4 в примере выше не изменяются при преобразовании).

Свойства преобразований

Вначале дадим описательное определение линейной трансформации пространства.

При линейном преобразовании начало координат не смещается, а линии координатной сетки остаются параллельными и сохраняют исходное расстояние друг от друга (origin remains fixed, grid lines remain parallel and evenly spaced).

Более формально свойства трансформации ($T$), которую также можно назвать функцией (function) или отображением (mapping) относительно векторов $mathbf v$ и $mathbf w$ можно выразить через две заданные в линейном пространстве операции сложения и умножения на скаляр.

- $ T(mathbf v + mathbf w) = T(mathbf v) + T(mathbf w) $

- $ T(c mathbf v) = c T(mathbf v) $

Примечение. Несмещение начала координат можно рассматривать как частный случай свойства 2, так как преобразование нулевого вектора должно дать нулевой вектор $T(mathbf 0) = mathbf 0 $. Приведем пример линейного и нелинейного преобразований.

Пример 1. Проекция

Рассмотрим проекцию $T: mathbb R^2 rightarrow mathbb R^2 $.

Проверим приведенные выше свойства:

- $ T(mathbf v + mathbf w) = T(mathbf v) + T(mathbf w) $

- если, например, вектор $mathbf v$ увеличить в два раза, то и проекция увеличится в два раза

- начало координат при проекции не смещается, то есть $T(mathbf 0) = mathbf 0 $

Пример 2. Нелинейное преобразование

Предположим, что мы хотим сместить каждый вектор проскости (в частности, вектор $ mathbf v $) на некоторый вектор $ mathbf d $.

Очевидно нарушается второе свойство, например, $ T(2 mathbf v) not= 2T(mathbf v) $. Более того, смещается начало координат, $T(mathbf 0) = mathbf d $.

Умножение матрицы на вектор

Важно, что умножение матрицы $A$ на векторы $mathbf v$ и $mathbf w$, т.е. $T(mathbf v) = A mathbf v$ и $T(mathbf w) = A mathbf w$ всегда линейно, так как

- $ A(mathbf v + mathbf w) = A(mathbf v) + A(mathbf w) $

- $ A(c mathbf v) = c A(mathbf v) $

Соответственно, задача линейного преобразования сводится к нахождению правильной трансформационной матрицы (причем в известной, заданной системе координат).

Например, если мы хотим перейти от трех измерений к двум, $T: mathbb R^3 rightarrow mathbb R^2$, то нам потребуется матрица $2 times 3$:

В общем случае матрица $A$ размерностью $m times n$ соответствует $ T: R^n rightarrow R^m $.

Смена базиса

Как уже было сказано, если линейное преобразование задано матрицей, то введена система координат (базис).

- На вход матрица получает базис $ mathbf v_1,…, mathbf v_n in R^n $

- На выходе выдает $ mathbf w_1,…, mathbf w_m in R^m $

Другими словами, при преобразовании линейной комбинации $mathbf v_1,…, mathbf v_n$ в линейную комбинацию $mathbf w_1,…, mathbf w_m$ происходит смена базиса. Например,

$$ mathbf v = c_1 mathbf v_1 + c_2 mathbf v_2 rightarrow T(mathbf v) = c_1 mathbf w_1 + c_2 mathbf w_2 $$

Пример 3. Производная как линейное преобразование

Интересно, что взятие производной линейно. Предположим, что у нас есть некоторая функция $ f(x) = c_1 + c_2 x + c_3 x^2 $. Ее базис: ${ 1, x, x^2 }$. Тогда производной будет $f'(x) = c_2 + 2 c_3 x $ с базисом ${ 1, x }$. Найти производную можно с помощью матрицы

$$ begin{bmatrix} 0 & 1 & 0 \ 0 & 0 & 2 end{bmatrix} begin{bmatrix} c_1 \ c_2 \ c_3 end{bmatrix} = begin{bmatrix} c_2 \ 2c_3 end{bmatrix} $$

Решение системы уравнений как преобразование

Теперь рассмотрим решение системы линейных уравнений (simultaneous equations) с точки зрения трансформации пространства.

$$ begin{bmatrix} 2 & 3 \ 5 & 1 end{bmatrix} begin{bmatrix} a \ b end{bmatrix} = begin{bmatrix} 8 \ 13 end{bmatrix}$$

По сути, нам нужно найти такой вектор $begin{bmatrix} a \ b end{bmatrix}$, при умножении матрицы на который мы окажемся в точке $ begin{bmatrix} 8 \ 13 end{bmatrix} $.

Виды преобразований

Можно выделить некоторые часто встречающиеся виды преобразований. Создадим вектор $mathbf x$.

Единичная матрица

Если умножить единичную матрицу (identity matrix) на вектор $mathbf x$, ничего не произойдет.

|

I = np.array([[1, 0], [0, 1]]) np.dot(I, x) |

Обратите внимание, мы легко можем догадаться, что с вектором после преобразования ничего не произойдет, потому что столбцы трансформационной матрицы в точности повторяют векторы базиса $mathbf i$ и $mathbf j$.

Сжатие и растяжение

При сжатии или растяжении (scaling) координаты вектора соответственно уменьшаются или увеличиваются в размере. В случае базисных векторов, они не меняют направления. Приведем пример растяжения.

|

# столбцы — это тот же базис, но # единицы увеличены в три и два раза соответственно Scale = np.array([[3, 0], [0, 2]]) np.dot(Scale, x) |

Посмотрим, как это выглядит на графике.

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 |

ax = plt.axes() plt.xlim([—0.5, 9.5]) plt.ylim([—0.5, 9.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, np.dot(Scale, i)[0], np.dot(Scale, i)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Scale, j)[0], np.dot(Scale, j)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), 3, 2, fill = False, edgecolor = ‘b’, lw = 2)) ax.arrow(0, 0, np.dot(Scale, x)[0], np.dot(Scale, x)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘r’, ec = ‘r’) plt.show() |

Дадим некоторые пояснения. Преобразования пространства удобно описывать с помощью площади, образованной двумя (в пространстве $R^2$) векторами.

- Зеленый квадрат: площадь базисных векторов

- Синий квадрат: площадь масштабированных базисных векторов

- Красный вектор: масштабированный вектор $mathbf x$

Обратите внимание, векторы базиса $mathbf i$ и $mathbf j$ после трансформации сохранили направление, вектор $ mathbf r $ сместился выше. Понимание того, что некоторые векторы сохраняют направление, а некоторые — нет, очень пригодится позднее.

Приведем пример сжатия. Для этого нужно, чтобы ненулевые координаты матрицы были меньше единицы.

|

Squish = np.array([[.5, 0], [0, .5]]) np.dot(Squish, x) |

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 |

ax = plt.axes() plt.xlim([—0.5, 2.5]) plt.ylim([—0.5, 2.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, np.dot(Squish, i)[0], np.dot(Squish, i)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Squish, j)[0], np.dot(Squish, j)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), .5, .5, fill = False, edgecolor = ‘b’, lw = 2)) ax.arrow(0, 0, np.dot(Squish, x)[0], np.dot(Squish, x)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘r’, ec = ‘r’) plt.show() |

Отражение

Отражение (reflection) как бы «перекидывает» вектор на другую сторону от осей координат. Посмотрим на отражение относительно оси y (то есть «перекидывать» мы будем вектор $mathbf i$). Для этого в первом столбце трансформационной матрицы 1 меняется на $-1$.

|

Reflect_y = np.array([[—1, 0], [0, 2]]) # посмотрим, где окажется вектор x np.dot(Reflect_y, x) |

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 |

ax = plt.axes() plt.xlim([—1.5, 1.5]) plt.ylim([—0.2, 2.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # отражается относительно оси y ax.arrow(0, 0, np.dot(Reflect_y, i)[0], np.dot(Reflect_y, i)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) # вектор j мы растягиваем ax.arrow(0, 0, np.dot(Reflect_y, j)[0], np.dot(Reflect_y, j)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), —1, 2, fill = False, edgecolor = ‘b’, lw = 2)) plt.show() |

Выполним отражение относительно обеих осей.

|

Invert = np.array([[—1, 0], [0, —1]]) np.dot(Invert, x) |

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 |

ax = plt.axes() plt.xlim([—1.5, 1.5]) plt.ylim([—1.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # отражается относительно оси y ax.arrow(0, 0, np.dot(Invert, i)[0], np.dot(Invert, i)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) # отражается относительно оси x ax.arrow(0, 0, np.dot(Invert, j)[0], np.dot(Invert, j)[1], width = 0.02, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), —1, —1, fill = False, edgecolor = ‘b’, lw = 2)) plt.show() |

Матрица перестановки

Матрица перестановки (permutation matrix) позволяет поменять векторы $mathbf i$ и $mathbf j$ местами.

|

P = np.array([[0, 1], [1, 0]]) # посмотрим, где окажется вектор x np.dot(P, x) |

|

# а также базисные векторы np.dot(P, i), np.dot(P, j) |

|

(array([0, 1]), array([1, 0])) |

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 |

ax = plt.axes() plt.xlim([—0.5, 1.5]) plt.ylim([—0.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # i и j меняются местами ax.arrow(0, 0, np.dot(P, i)[0], np.dot(P, i)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(P, j)[0], np.dot(P, j)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘b’, lw = 1)) plt.show() |

Сдвиг (трансвекция)

Сдвиг или трансвекция (shear) предполагает, что один из базисных векторов остается на месте, второй сдвигается.

|

# вектор i остается на месте, j сдвигается Shear = np.array([[1, 1], [0, 1]]) np.dot(Shear, x) |

|

ax = plt.axes() plt.xlim([—0.5, 2.5]) plt.ylim([—0.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, np.dot(Shear, i)[0], np.dot(Shear, i)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Shear, j)[0], np.dot(Shear, j)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Polygon([[0, 0], [1, 0], [2, 1], [1, 1]], fill = False, edgecolor = ‘b’, lw = 2)) plt.show() |

Вращение

Посмотрим, как можно повернуть (rotate) базисные векторы на 90 градусов против часовой стрелки.

|

# поворот на 90 градусов против часовой стрелки Rotate = np.array([[0, —1], [1, 0]]) np.dot(Rotate, x) |

|

ax = plt.axes() plt.xlim([—1.5, 1.5]) plt.ylim([—0.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, np.dot(Rotate, i)[0], np.dot(Rotate, i)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Rotate, j)[0], np.dot(Rotate, j)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.add_patch(Rectangle((0, 0), 1, 1, fill = False, edgecolor = ‘g’, lw = 2)) ax.add_patch(Rectangle((0, 0), —1, 1, fill = False, edgecolor = ‘b’, lw = 2)) plt.show() |

Поворот на определенный угол против часовой стрелки.

|

theta = np.radians(90) Rotate = np.array([[np.cos(theta), —np.sin(theta)], [np.sin(theta), np.cos(theta)]]) np.dot(Rotate, x) |

Смысл такой трансформации представлен на схеме ниже. Для поворота на 90 градусов против часовой стрелки вспомним, что

- для вектора $mathbf i quad cos(90^{circ}) = 0, quad -sin(90^{circ}) = -1$

- для вектора $mathbf j quad sin(90^{circ}) = 1, quad cos(90^{circ}) = 0$

Видео про линейные преобразования⧉.

Композиция преобразований

Посмотрим, что произойдет, если применить сначала поворот на 90 градусов по часовой стрелке, затем отражение относительно оси y.

Так как матрица преобразования стоит слева от преобразуемого вектора, то для применения двух преобразований, матрица второго преобразования будет стоять слева от матрицы первого.

$$ Reflect_y cdot (Rotate cdot mathbf x ) $$

Подготовим матрицы.

|

# поворот по часовой стрелки theta = np.radians(90) Rotate = np.array([[np.cos(theta), np.sin(theta)], [—np.sin(theta), np.cos(theta)]]).round() Rotate |

|

array([[ 0., 1.], [-1., 0.]]) |

|

# отражение относительно оси y Reflect_y = np.array([[—1, 0], [0, 1]]) Reflect_y |

|

array([[-1, 0], [ 0, 1]]) |

Выполним преобразование.

|

np.dot(Reflect_y, np.dot(Rotate, i)), np.dot(Reflect_y, np.dot(Rotate, j)) |

|

(array([ 0., -1.]), array([-1., 0.])) |

Посмотрим на этот процесс графически. Вначале первое преобразование (вращение).

|

ax = plt.axes() plt.xlim([—1.5, 1.5]) plt.ylim([—1.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # поворот по часовой стрелке ax.arrow(0, 0, np.dot(Rotate, i)[0], np.dot(Rotate, i)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Rotate, j)[0], np.dot(Rotate, j)[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) plt.show() |

Теперь применим второе преобразование (отражение) к результату первого.

|

ax = plt.axes() plt.xlim([—1.5, 1.5]) plt.ylim([—1.5, 1.5]) plt.grid() ax.arrow(0, 0, i[0], i[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) ax.arrow(0, 0, j[0], j[1], width = 0.03, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘g’, ec = ‘g’) # отображение относительно оси y ax.arrow(0, 0, np.dot(Reflect_y, np.dot(Rotate, i))[0], np.dot(Reflect_y, np.dot(Rotate, i))[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) ax.arrow(0, 0, np.dot(Reflect_y, np.dot(Rotate, j))[0], np.dot(Reflect_y, np.dot(Rotate, j))[1], width = 0.01, head_width = 0.1, head_length = 0.2, length_includes_head = True, fc = ‘b’, ec = ‘b’) plt.show() |

Запишем, где оказались векторы $mathbf i$ и $mathbf j$ после второго преобразования и соединим эти координаты в матрицу. Затем умножим на исходные векторы $mathbf i$ и $mathbf j$.

|

Composition = np.array([[0, —1], [—1, 0]]) np.dot(Composition, i), np.dot(Composition, j) |

|

(array([ 0, -1]), array([-1, 0])) |

Результат аналогичен последовательному применению предыдущих преобразований.

|

# то же самое мы получим, перемножив матрицы преобразований np.dot(Reflect_y, Rotate) |

|

array([[ 0., -1.], [-1., 0.]]) |

Обратите внимание, что порядок операций важен. Поменяв матрицы преобразований местами, мы получим другой результат.

|

# выполнив отражение, а затем поворот, # мы вернем векторы в исходное положение np.dot(Rotate, np.dot(Reflect_y, i)), np.dot(Rotate, np.dot(Reflect_y, j)) |

|

(array([0., 1.]), array([1., 0.])) |

Это еще раз демонстрирует некоммутативность, но ассоциативность умножения матриц.

Приведем ссылки на видео:

- Умножение матриц как последовательность преобразований⧉

- Линейные преобразования в трехмерном пространстве⧉

Подведем итог

Мы посмотрели, как матрицы преобразовывают пространство и на примерах изучили, чем линейные преобразования отличаются от нелинейных. Кроме того, мы познакомились с основными видами линейных преобразований.

Рассмотрим системы линейных уравнений.

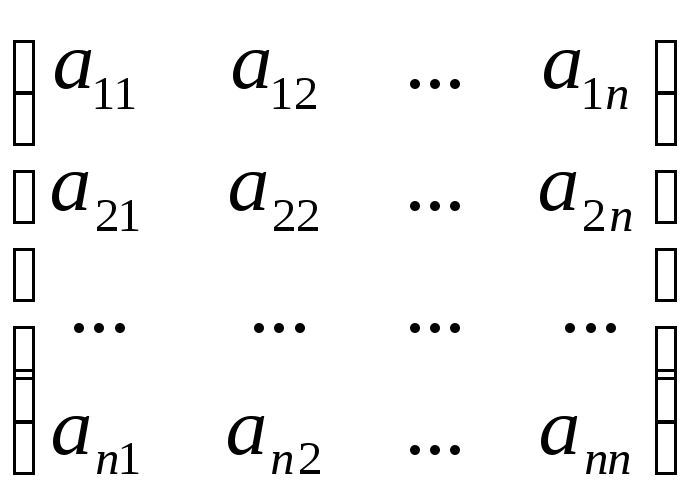

Матрицы линейных преобразований

Пусть

в n-

мерном линейном пространстве с базисом

,

,…,

задано линейное преобразование А. Тогда

векторы А,А

,…,А

—

также векторы этого пространства и их

можно представить в виде линейной

комбинации векторов базиса:

A=

a11+

a21+…+

an1

A=

a12+

a22+…+

an2

……………………………….

A=

an1+

an2+…+

ann

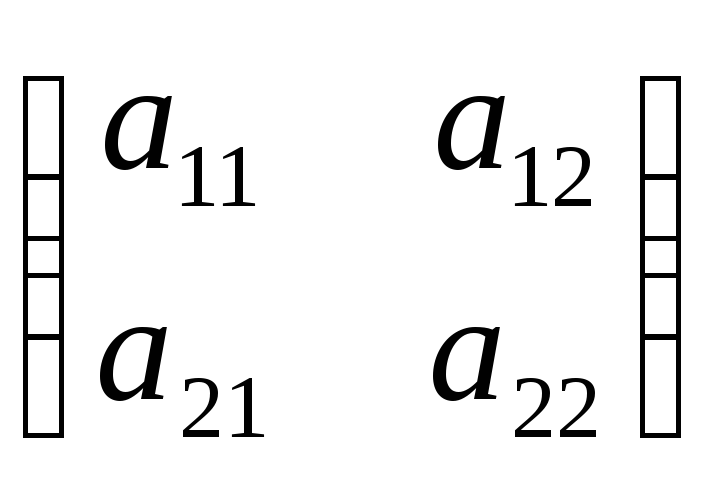

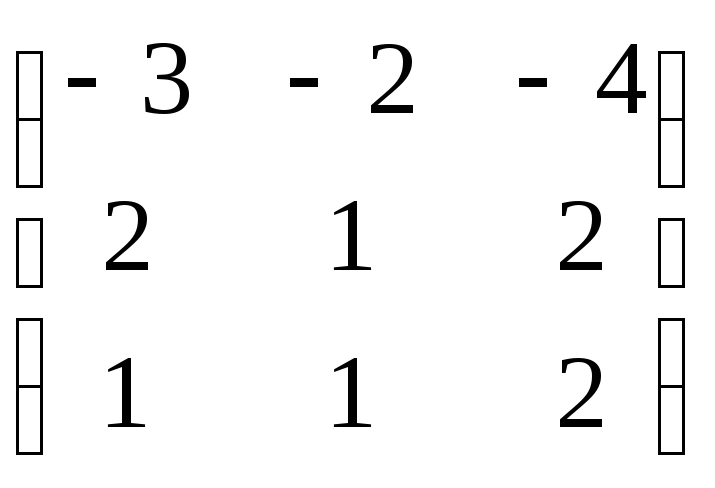

Тогда

матрица А =

называется матрицей

линейного преобразования А.

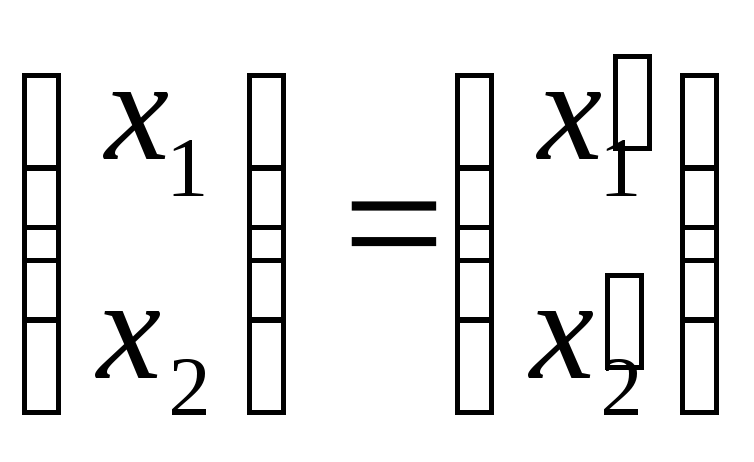

Если

в пространстве L

взять вектор

=

x1+

x2+…+

xn,

то A

L.

,

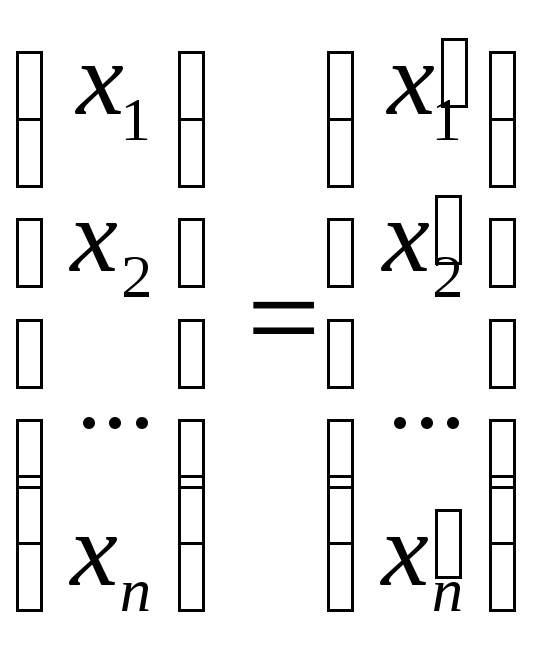

где

……………………………..

Эти

равенства можно назвать линейным

преобразованием в базисе

,

,…,

.

В

матричном виде:

А

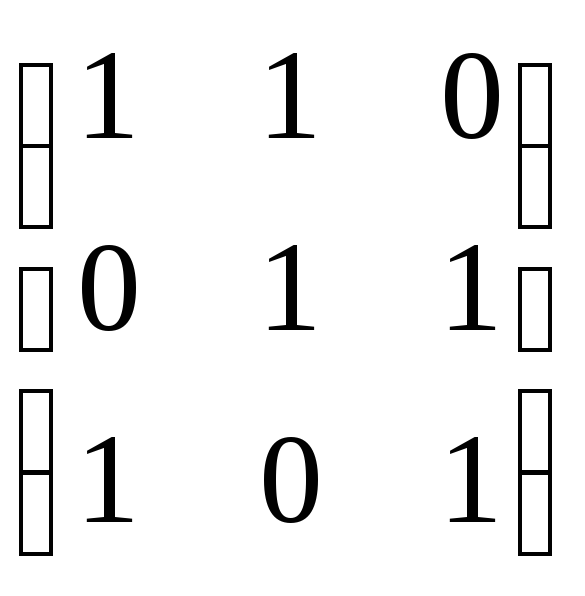

Пример.

Найти матрицу линейного преобразования,

заданного в виде:

x

= x + y

y

= y + z

z

= z + x

x

= 1x

+ 1y

+ 0z

y

= 0x

+ 1y

+ 1z

z

= 1x

+ 0y

+ 1z

A

=

На практике действия

над линейными преобразованиями сводятся

к действиям над их матрицами.

Определение:

Если вектор

переводится

в вектор

линейным преобразованием с матрицей

А, а вектор

в вектор

линейным преобразованием с матрицей

В, то последовательное применение этих

преобразований равносильно линейному

преобразованию, переводящему вектор

в вектор

(оно

называется произведением

составляющих преобразований).

С

= ВА

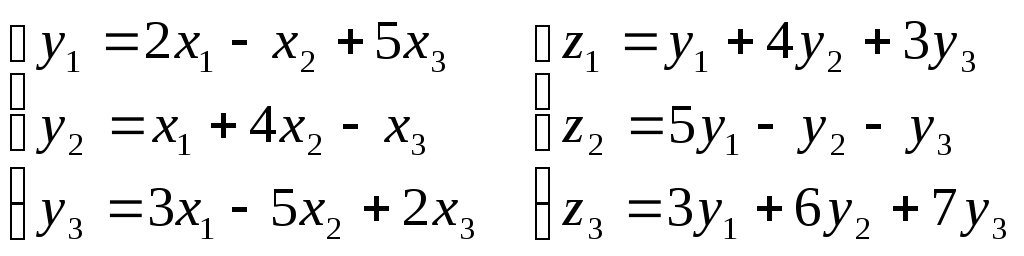

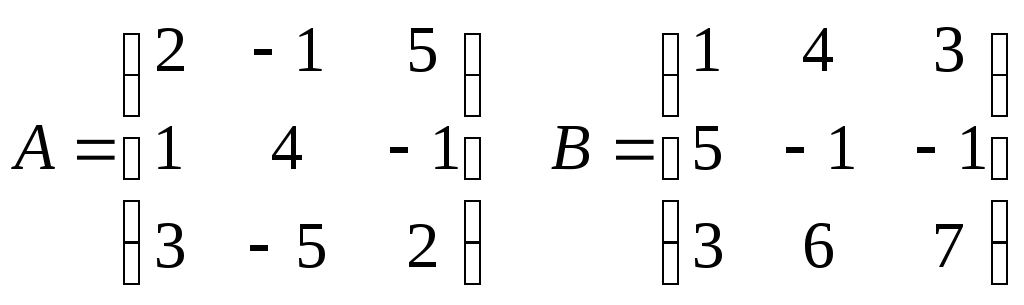

Пример.

Задано линейное преобразование А,

переводящее вектор

в

вектор

и линейное преобразование В, переводящее

вектор

в вектор

.

Найти матрицу линейного преобразования,

переводящего вектор

в вектор

.

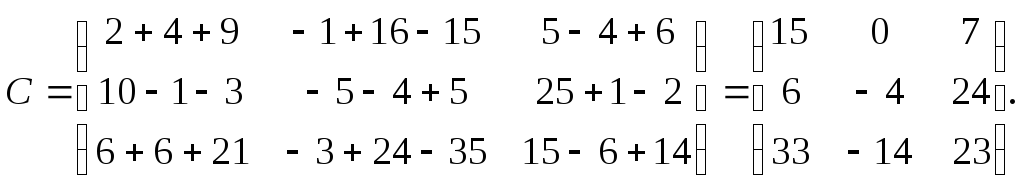

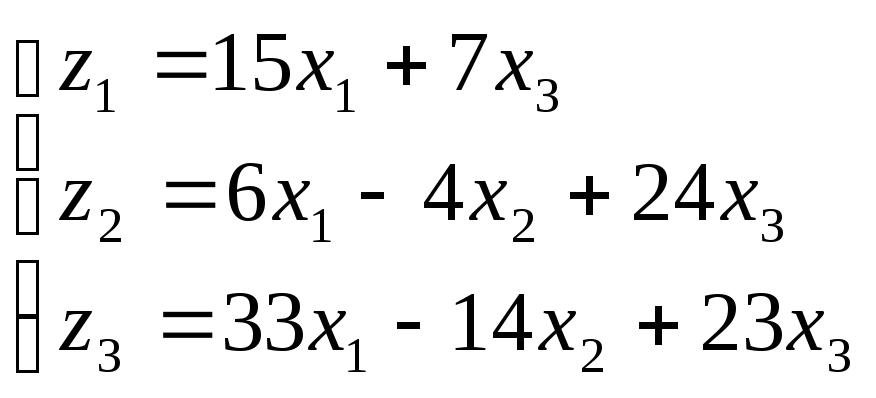

С

= ВА

Т.е.

Примечание:

Если А=

0, то преобразование вырожденное, т.е.,

например, плоскость преобразуется не

в целую плоскость, а в прямую.

Собственные значения и собственные векторы линейного преобразования

Определение:

Пусть L

– заданное n-

мерное линейное пространство. Ненулевой

вектор

L

называется собственным

вектором

линейного преобразования А, если

существует такое число ,

что выполняется равенство:

A.

При

этом число

называется собственным

значением (характеристическим числом)

линейного преобразования А, соответствующего

вектору

.

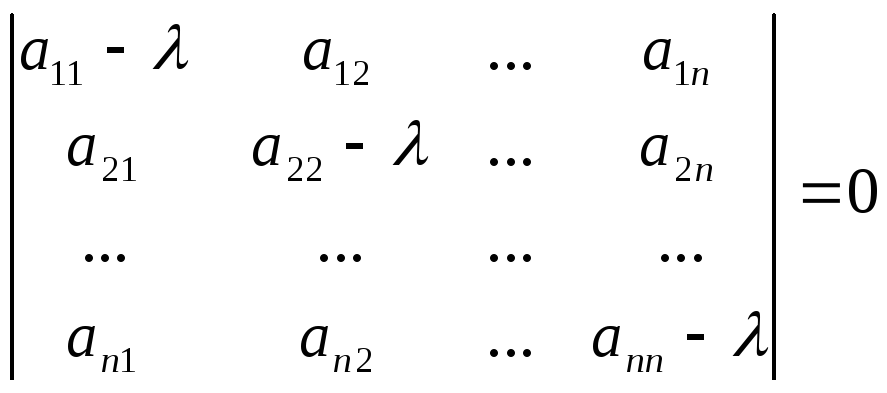

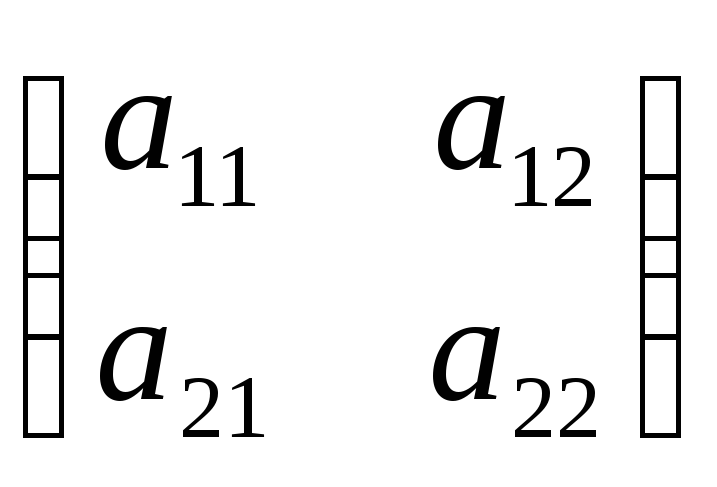

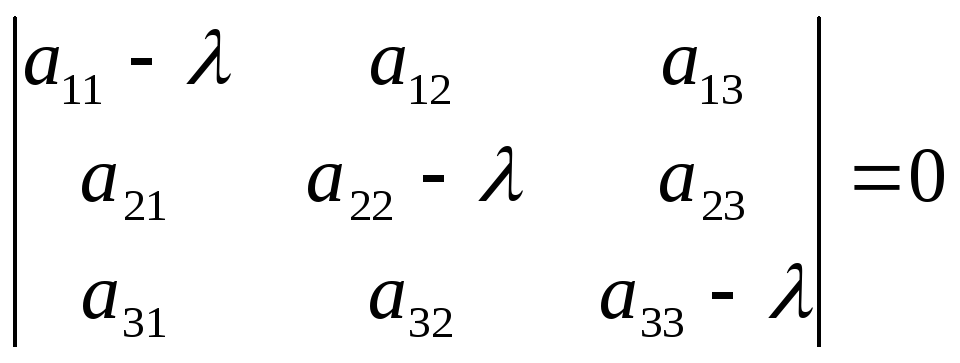

Определение:

Если линейное преобразование А в

некотором базисе

,

,…,

имеет матрицу А =

то собственные значения линейного

преобразования А можно найти как корни

1,

2,

… ,n

уравнения:

Это

уравнение называется характеристическим

уравнением,

а его левая часть- характеристическим

многочленом

линейного преобразования А.

Следует

отметить, что характеристический

многочлен линейного преобразования не

зависит от выбора базиса.

Рассмотрим

частный

случай. Пусть

А – некоторое линейное преобразование

плоскости, матрица которого равна

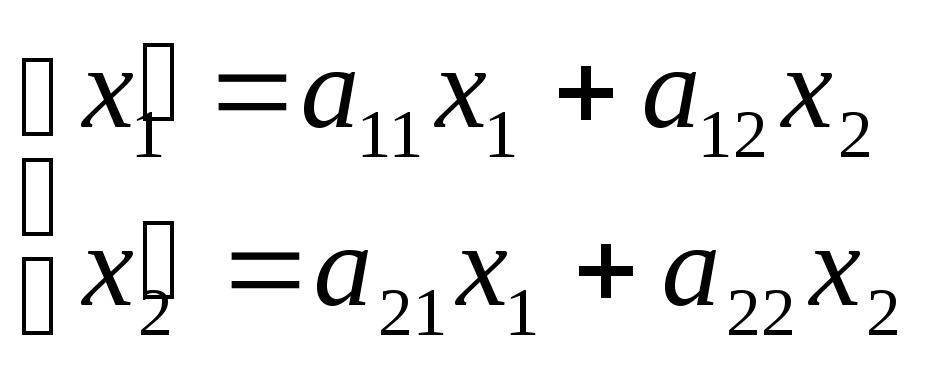

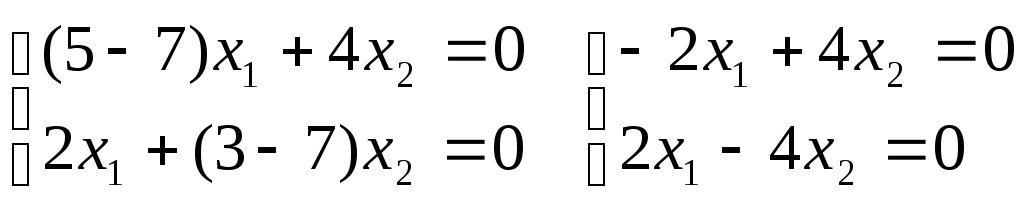

Тогда преобразование А может быть задано

формулами:

в

некотором базисе

.

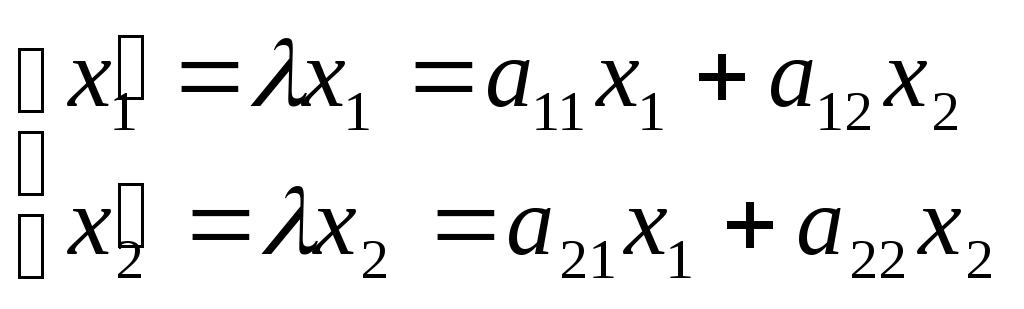

Если

преобразование А имеет собственный

вектор с собственным значением ,

то А.

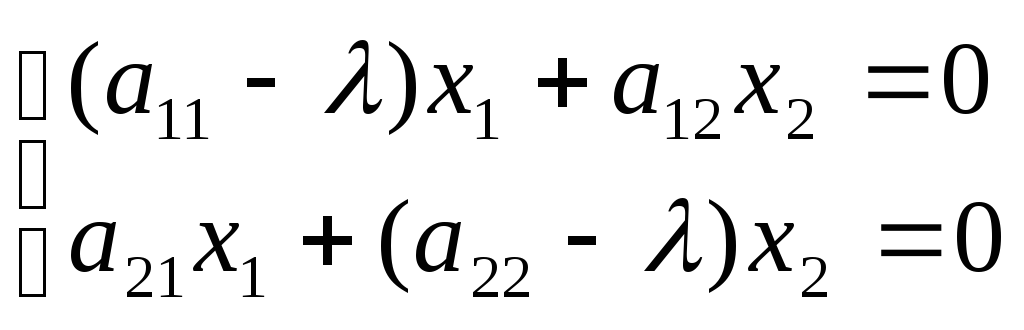

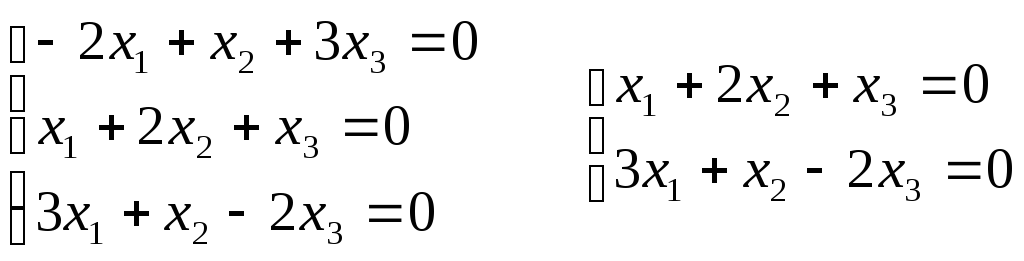

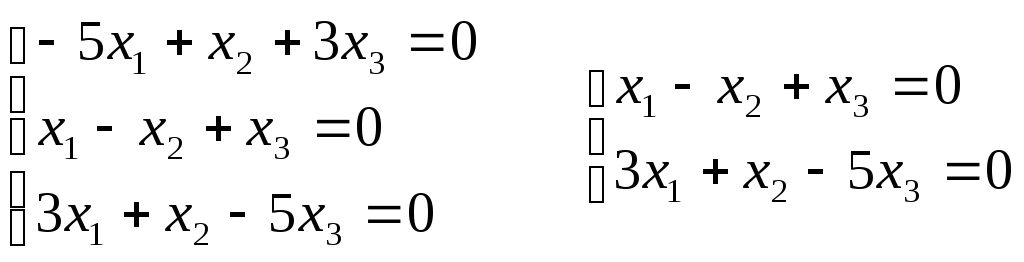

или

Т.к.

собственный вектор

ненулевой,

то х1

и х2

не равны нулю одновременно. Т.к. данная

система однородна, то для того, чтобы

она имела нетривиальное решение,

определитель системы должен быть равен

нулю. В противном случае по правилу

Крамера система имеет единственное

решение – нулевое, что невозможно.

Полученное

уравнение является характеристическим

уравнением линейного преобразования

А.

Таким

образом, можно найти собственный вектор

(х1,

х2)

линейного преобразования А с собственным

значением ,

где

— корень характеристического уравнения,

а х1

и х2

– корни системы уравнений при подстановке

в нее значения .

Понятно,

что если характеристическое уравнение

не имеет действительных корней, то

линейное преобразование А не имеет

собственных векторов.

Следует

отметить, что если

—

собственный вектор преобразования А,

то и любой вектор ему коллинеарный –

тоже собственный с тем же самым собственным

значением .

Действительно,

.

Если учесть, что векторы имеют одно

начало, то эти векторы образуют так

называемое собственное

направление или

собственную

прямую.

Т.к.

характеристическое уравнение может

иметь два различных действительных

корня 1

и 2,

то в этом случае при подстановке их в

систему уравнений получим бесконечное

количество решений. (Т.к. уравнения

линейно зависимы). Это множество решений

определяет две собственные

прямые.

Если

характеристическое уравнение имеет

два равных корня 1

= 2

= ,

то либо имеется лишь одна собственная

прямая, либо, если при подстановке в

систему она превращается в систему

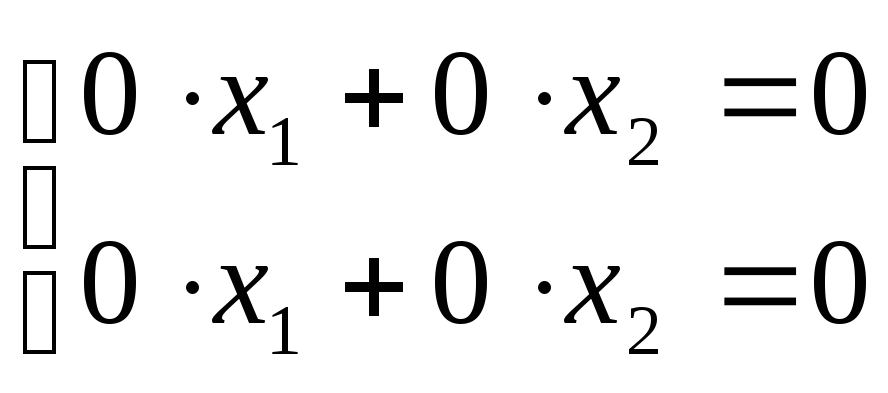

вида:

Эта система удовлетворяет любым значениям

х1

и х2.

Тогда все векторы будут собственными,

и такое преобразование называется

преобразованием

подобия.

Пример.

Найти характеристические числа и

собственные векторы линейного

преобразования с матрицей А =

.

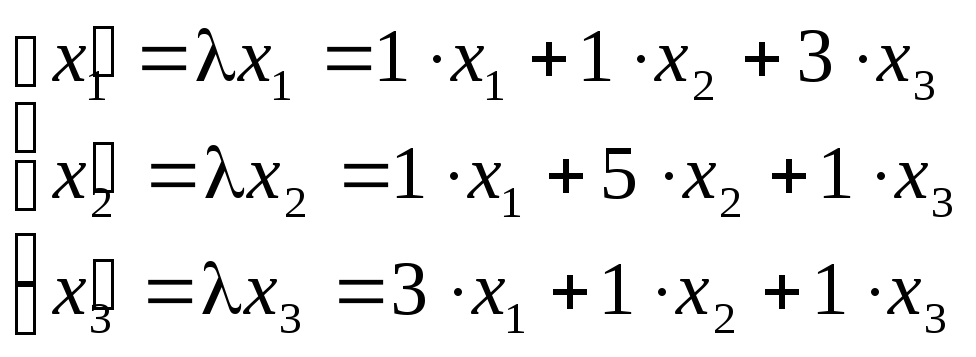

Запишем

линейное преобразование в виде:

Составим

характеристическое уравнение:

2

— 8

+ 7 = 0;

Корни

характеристического уравнения: 1

= 7; 2

= 1;

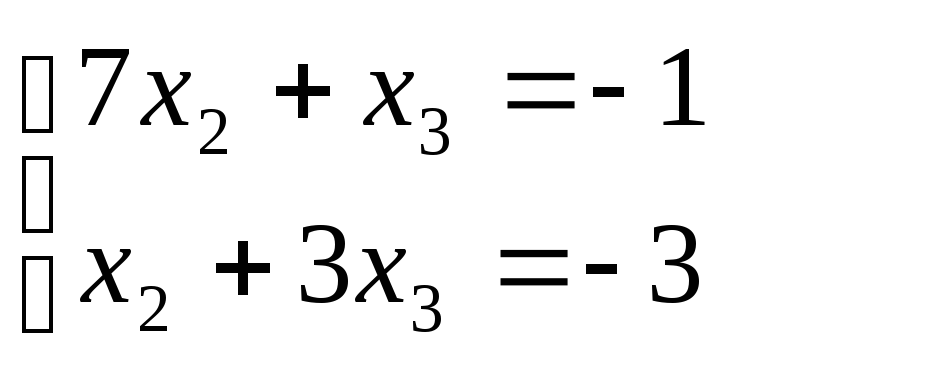

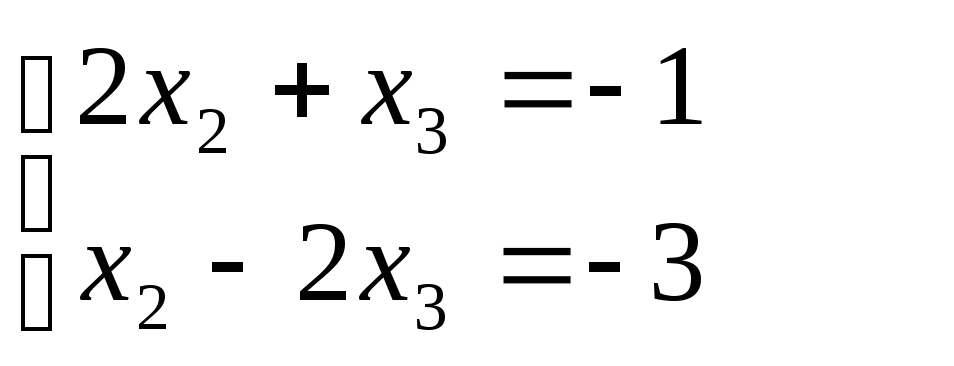

Для

корня 1

= 7:

Из

системы получается зависимость: x1

– 2x2

= 0. Собственные

векторы для первого корня характеристического

уравнения имеют координаты: (t;

0,5t)

где t—

параметр.

Для

корня 2

= 1:

Из

системы получается зависимость: x1

+ x2

= 0. Собственные

векторы для второго корня характеристического

уравнения имеют координаты: (t;

—t)

где t—

параметр.

Полученные

собственные векторы можно записать в

виде:

Пример.

Найти характеристические числа и

собственные векторы линейного

преобразования с матрицей А =

.

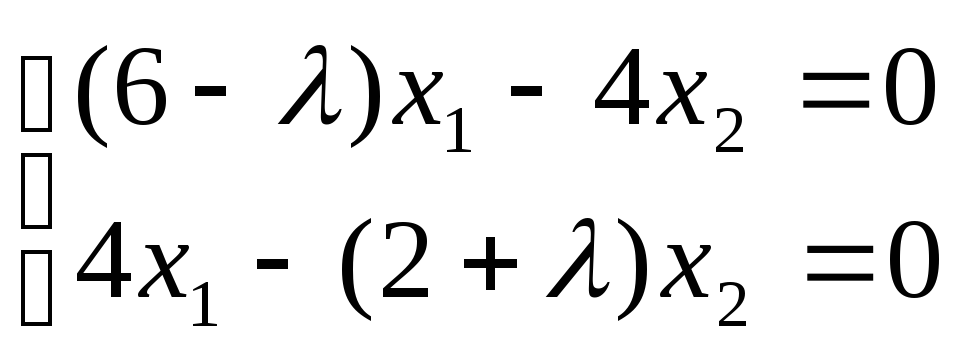

Запишем

линейное преобразование в виде:

Составим

характеристическое уравнение:

2

— 4

+ 4 = 0;

Корни

характеристического уравнения: 1

= 2

= 2;

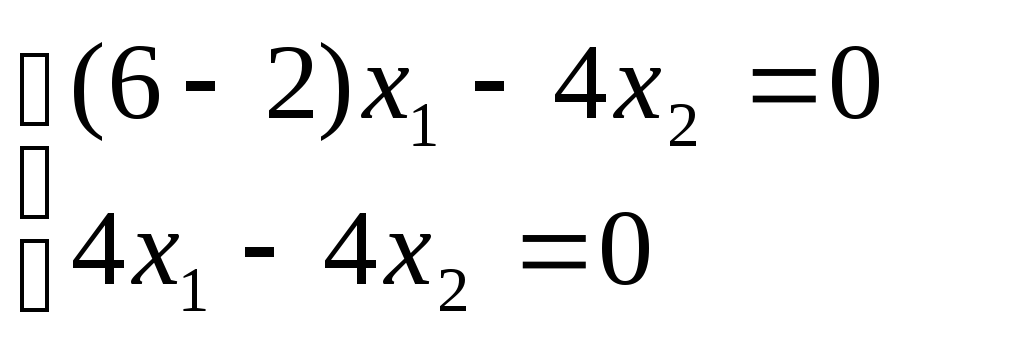

Получаем:

Из

системы получается зависимость: x1

– x2

= 0. Собственные

векторы для первого корня характеристического

уравнения имеют координаты: (t;

t)

где t—

параметр.

Собственный

вектор можно записать:

.

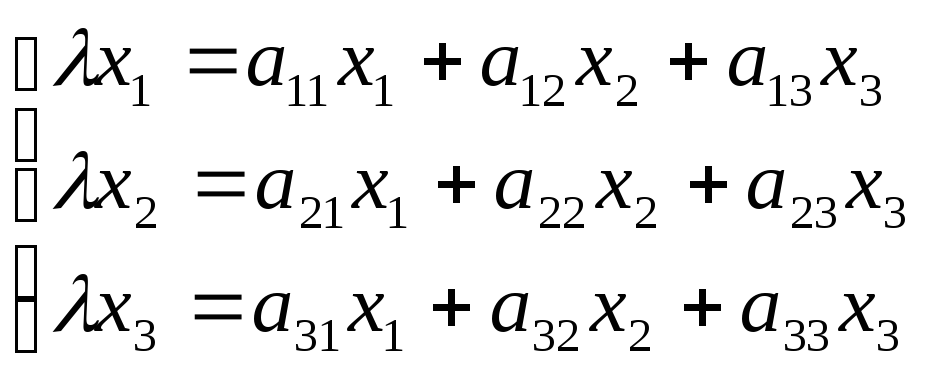

Рассмотрим

другой частный

случай. Если

—

собственный вектор линейного преобразования

А, заданного в трехмерном линейном

пространстве, а х1,

х2,

х3

– компоненты этого вектора в некотором

базисе

,

то

,

где

— собственное значение (характеристическое

число) преобразования А.

Если

матрица линейного преобразования А

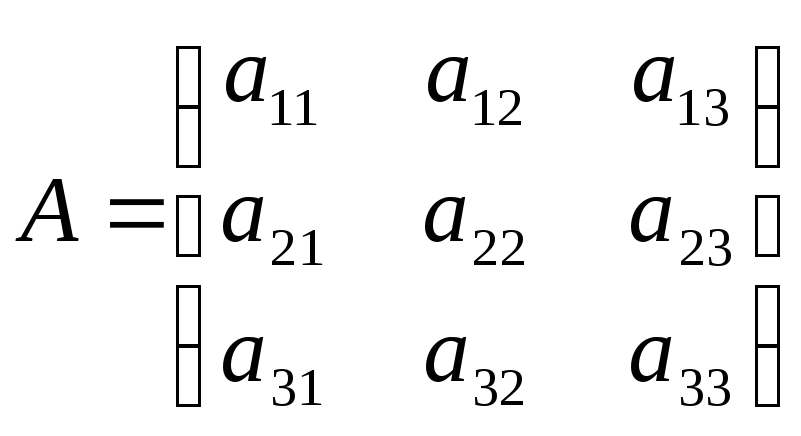

имеет вид:

то

Характеристическое

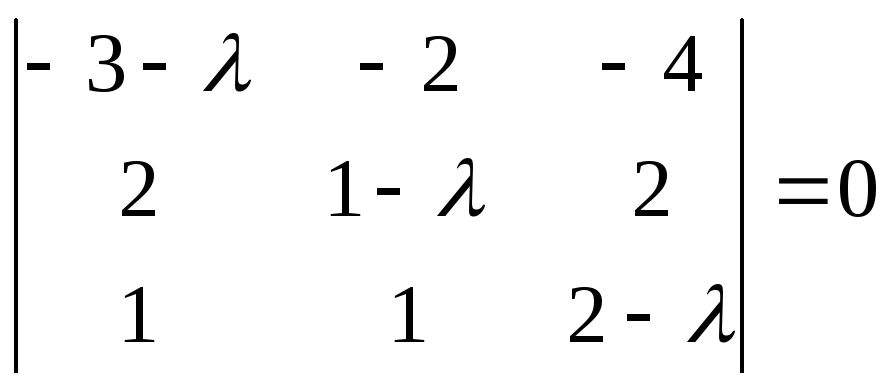

уравнение:

Раскрыв

определитель, получим кубическое

уравнение относительно .

Любое кубическое уравнение с действительными

коэффициентами имеет либо один, либо

три действительных корня.

Тогда

любое линейное преобразование в

трехмерном пространстве имеет собственные

векторы.

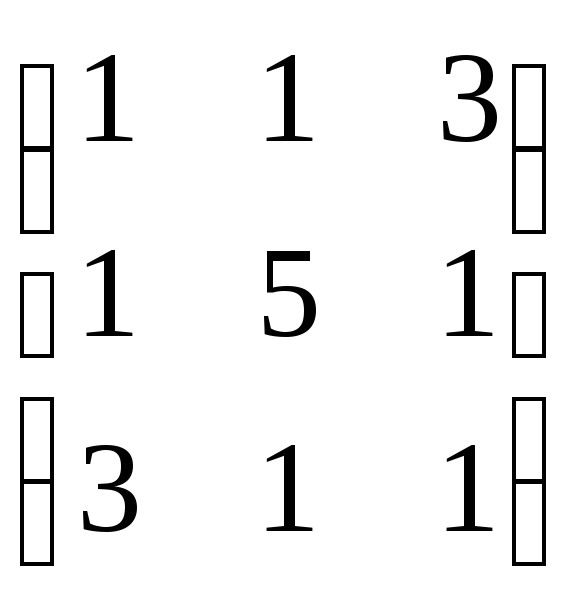

Пример.

Найти характеристические числа и

собственные векторы линейного

преобразования А, матрица линейного

преобразования А =

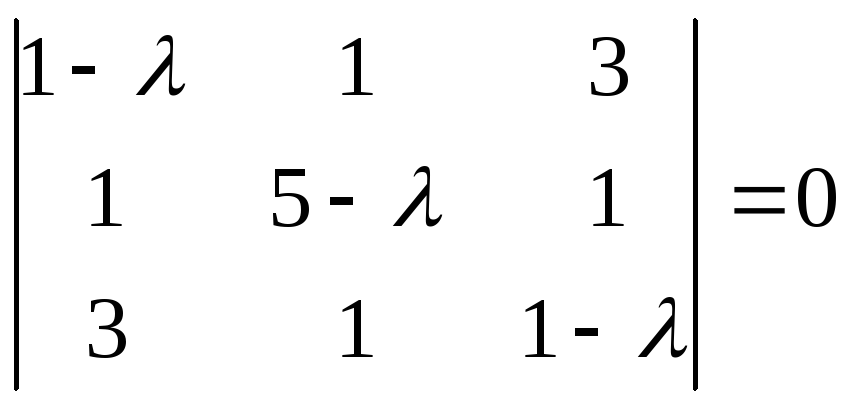

Составим

характеристическое уравнение:

(1

— )((5

— )(1

— )

— 1) — (1 —

— 3) + 3(1 — 15 + 3)

= 0

(1

— )(5

— 5

—

+ 2

— 1) + 2 +

— 42 + 9

= 0

(1

— )(4

— 6

+ 2)

+ 10

— 40 = 0

4

— 6

+ 2

— 4

+ 62

— 3

+ 10

— 40 = 0

-3

+ 72

– 36 = 0

-3

+ 92

— 22

– 36 = 0

-2(

+ 2) + 9(2

– 4) = 0

(

+ 2)(-2

+ 9

— 18) = 0

Собственные

значения: 1

= -2; 2

= 3; 3

= 6;

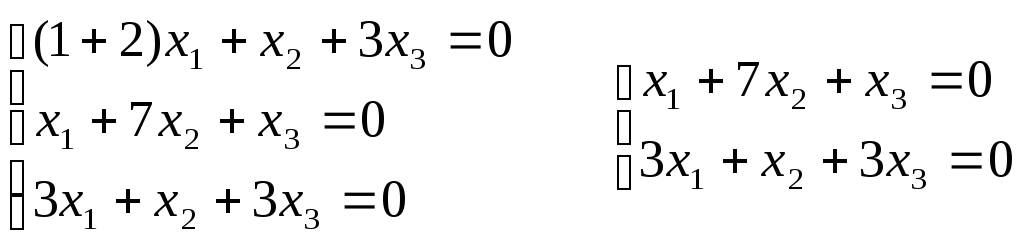

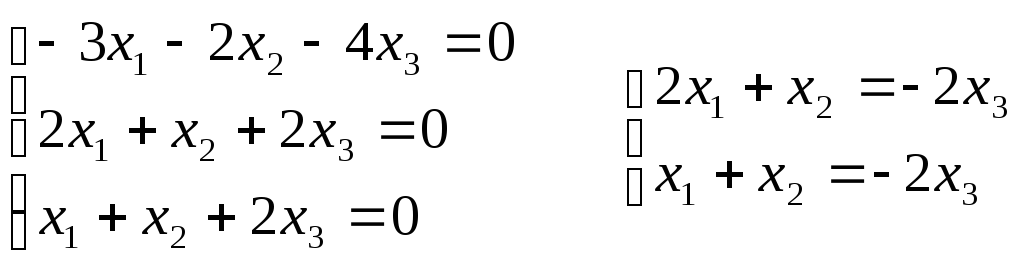

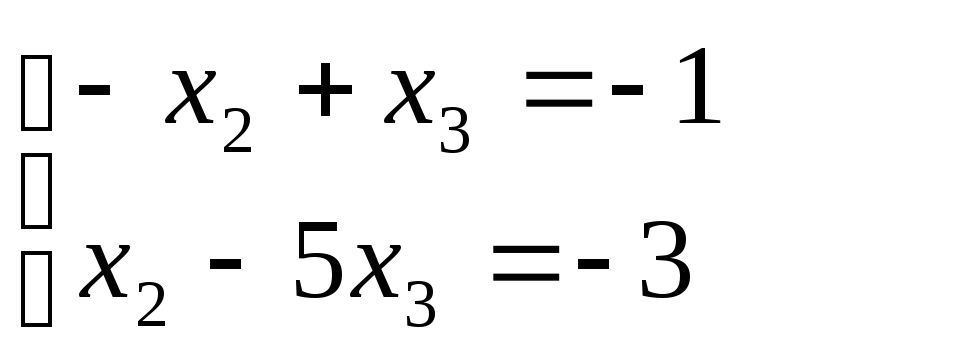

1)

Для 1

= -2:

Если

принять х1

= 1, то

х2

= 0; x3

= -1;

Собственные

векторы:

2)

Для 2

= 3:

Если

принять х1

= 1, то

х2

= -1; x3

= 1;

Собственные

векторы:

3)

Для 3

= 6:

Если

принять х1

= 1, то

х2

= 2; x3

= 1;

Собственные

векторы:

Пример.

Найти характеристические числа и

собственные векторы линейного

преобразования А, матрица линейного

преобразования А =

Составим

характеристическое уравнение:

-(3

+ )((1

— )(2

— )

– 2) + 2(4 — 2

— 2) — 4(2 — 1 + )

= 0

-(3

+ )(2

—

— 2

+ 2

— 2) + 2(2 — 2)

— 4(1 + )

= 0

-(3

+ )(2

— 3)

+ 4 — 4

— 4 — 4

= 0

-32

+ 9

— 3

+ 32

— 8

= 0

-3

+

= 0

1

= 0; 2

= 1; 3

= -1;

Для

1

= 0:

Если

принять х3

= 1, получаем х1

= 0, х2

= -2

Собственные

векторы

t,

где t

– параметр.

Для

самостоятельного решения:

Аналогично найти

и

для 2

и 3.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Будем рассматривать двумерный случай.

Матрица преобразования — это некоторая матрица . Мы будем рассматривать матрицы вида

Допустим есть какое-то преобразование , и (к точке применили преобразование и получили точку ).

Тогда матрица преобразования , умноженная на однородные координаты , даёт однородные координаты .

В каком-то смысле, любое линейное преобразование одновременно является матрицей, так же как точка — это набор координат.

Посмотрим как меняются координаты при преобразовании.

.

То есть новые координаты как-то линейно зависят от старых.

Рассмотрим частные случаи преобразований.

Содержание

- 1 Базовые преобразования

- 1.1 Параллельный перенос

- 1.2 Масштабирование вдоль осей

- 1.3 Поворот относительно начала координат

- 1.4 Тождественное преобразование

- 2 Композиция преобразований

Базовые преобразования

Параллельный перенос

Задаёт преобразование .

Обозначается , где — вектор параллельного переноса.

Пример

Задача: Найдите новые координаты точки после параллельного переноса плоскости на вектор .

Решение:

Вполне ожидаемый ответ.

Масштабирование вдоль осей

Задаёт преобразование .

Будем обозначать как . Числа и называются коэффициентами масштабирования.

Пример

Задача: Найдите новые координаты точки после масштабирования по оси с коэффициентом 2 (по оси масштаб остаётся таким же).

Решение:

Поворот относительно начала координат

Обозначается , где — угол поворота.

Как обычно, при повороте против часовой стрелки, и при повороте по часовой стрелке.

Пример

Задача: Найдите новые координаты точки после поворота плоскости на °.

Решение:

Замечание

, то есть центральная симметрия относительно начала координат меняет координаты точки на противоположные.

Тождественное преобразование

Это преобразование, оставляющее все точки неподвижными.

Его матрица:

Композиция преобразований

Задача: к точке применили осевую симметрию относительно , и затем применили параллельный перенос на . Какие новые координаты у точки?

Решение: обозначим нашу точку за , новую точку за

Посчитаем двумя способами.

1)

2) Воспользуемся ассоциативностью умножения матриц (сочетательный закон)

Заметим, что — тоже какая-то матрица преобразования, в данном случае «осевая симметрия относительно , с последующим параллельным переносом на »

Действительно,

Тогда матрица для будет .

Получается, при композиции преобразований их матрицы перемножаются.

Линейные операторы (преобразования)

Определение линейных операторов (преобразований)

Линейным преобразованием (линейным оператором) линейного пространства называется линейное отображение

пространства

в себя.

Поскольку линейное преобразование является частным случаем линейного отображения, к нему применимы все понятия и свойства, рассмотренные для отображений: инъективность, сюръективность, биективность, обратимость, ядро, образ, дефект, ранг и т.д.

Матрицей линейного оператора (преобразования) в базисе

пространства

называется квадратная матрица

, составленная из координатных столбцов образов базисных векторов

, найденных относительно базиса

.

Матрица биективного линейного оператора (преобразования) обратима, т.е. невырождена. Поэтому биективное (обратимое) преобразование называют также невырожденным.

Примеры линейных операторов (преобразований)

1. Обозначим — нулевое преобразование n-мерного пространства

, которое ставит в соответствие любому вектору

нулевой элемент

пространства

. Это преобразование не является инъективным, сюръективным, биективным, обратимым. Матрица нулевого преобразования (в любом базисе) нулевая, ядро преобразования

, образ преобразования

, дефект

, ранг

.

2. Обозначим — тождественное преобразование n-мерного пространства

, которое ставит в соответствие каждому вектору

этот же вектор

. Это преобразование является инъективным, сюръективным, биективным, обратимым. Матрица тождественного преобразования (в любом базисе) единичная n-го порядка, ядро преобразования

, образ преобразования

, дефект

, ранг

.

3. Обозначим — центральную симметрию n-мерного пространства

(относительно нулевого вектора

), т.е. преобразование, которое каждому вектору ставит в соответствие противоположный ему вектор:

. Это преобразование линейное, инъективное, сюръективное, биективное, обратимое. Матрица преобразования противоположна единичной (в любом базисе):

; ядро преобразования

, образ преобразования

, дефект

, ранг

.

4. Обозначим — гомотетию n-мерного пространства

(с коэффициентом

), т.е. преобразование, которое каждому вектору ставит в соответствие коллинеарный ему вектор:

. Это преобразование линейное. При

оно инъективное, сюръективное, биективное, обратимое. Матрица преобразования пропорциональна единичной (в любом базисе):

, ядро преобразования

, образ преобразования

, дефект

, ранг

. При

(см. пункт 1); при

(см. пункт 2); при

(см. пункт 3).

5. Рассмотрим линейное пространство радиус-векторов (с общим началом в точке

), принадлежащих одной плоскости (рис. 9.1). Обозначим

— поворот вокруг точки

(на угол

в положительном направлении (против часовой стрелки)). Это преобразование линейное, инъективное, сюръективное, биективное, обратимое. Найдем матрицу поворота в стандартном ортонормированием базисе

. Раскладывая образы

базисных векторов по базису, получаем

Составляем матрицу (9.1) преобразования (оператора), записывая найденные координаты образов по столбцам:

Ядро оператора (преобразования) , образ преобразования

, дефект

, ранг

. При

(см. пункт 2); при

(см. пункт 3).

6. Обозначим — оператор дифференцирования, который каждому многочлену степени не выше и ставит в соответствие его производную, рассматриваемую как многочлен степени не выше

. Это преобразование линейное, неинъективное, несюръективное, небиективное, необратимое. Квадратная матрица ((n+l)-го порядка) преобразования в стандартном базисе имеет вид

Ядро преобразования — пространство многочленов нулевой степени, образ

— пространство многочленов степени не выше

, дефект

, ранг

.

Рассмотрим преобразование линейного пространства тригонометрических многочленов (частоты

) с действительными коэффициентами:

, т.е.

— множество функций вида

, где

. Заметим, что это множество является двумерным вещественным линейным пространством. Стандартный базис пространства

образуют функции

, поскольку они линейно независимы (тождественное равенство нулю

возможно только в тривиальном случае

). При дифференцировании функции

получаем функцию

того же вида. Следовательно, преобразование

определено. Это преобразование линейное, инъективное, сюръективное, биективное, обратимое. Найдем матрицу преобразования в стандартном базисе

. Раскладывая образы базисных векторов, получаем

Составляем матрицу (9.1) преобразования, записывая найденные координаты образов по столбцам: . Ядро преобразования

— нулевое подпространство, образ

, дефект

, ранг

,

.

Аналогичными свойствами обладает преобразование , где

— множество функций вида

с комплексными коэффициентами

и

. Множество

является двумерным комплексным линейным пространством.

7. Пусть линейное пространство разлагается в прямую сумму подпространств . Обозначим

— оператор проектирования на подпространство

параллельно подпространству

, который каждому вектору

, где

, ставит в соответствие его составляющую (проекцию)

, т.е.

(рис.9.2). Это преобразование линейное. При

оно неинъективное, несюръективное, небиективное, необратимое. Ядро преобразования

, образ преобразования

, дефект

, Ранг

,. При

; при

.

8. Пусть линейное пространство разлагается в прямую сумму подпространств . Обозначим

— оператор отражения в подпространстве

параллельно подпространству

(или преобразование симметрии относительно подпространства

параллельно подпространству

), который каждому вектору

, где

, ставит в соответствие вектор

, т.е.

(рис. 9.3). Это преобразование линейное, инъективное, сюръективное, биективное, обратимое. Ядро преобразования

, образ преобразования

, дефект

, ранг

. При

.

Матрицы линейного оператора (преобразования) в разных базисах

Найдем связь матриц одного и того же линейного оператора (преобразования) в разных базисах.

Пусть в базисе преобразование

имеет матрицу

, а в базисе

— матрицу

. Если

— матрица перехода от базиса

к базису

, то

(9.4)

Докажем формулу (9.4). Пусть векторы и

в базисах

и

имеют координатные столбцы

и

соответственно. Если

, то по формуле (9.2) имеем

Подставляя в первое равенство связи координат векторов в разных базисах

получаем

или, учитывая обратимость матрицы

. Сравнивая последнее равенство с

, убеждаемся в справедливости (9.4).

Замечания 9.2

1. Матрицы линейного преобразования в разных базисах оказываются подобными. И наоборот, любые две подобные матрицы являются матрицами некоторого линейного преобразования, найденными относительно разных базисов.

2. Для матриц преобразований справедливы свойства, рассмотренные ранее. В частности, при фиксированном базисе матрица суммы преобразований равна сумме их матриц, матрица произведения преобразования на число равна произведению матрицы преобразования на это же число, матрица композиции преобразований равна произведению матриц преобразований, матрица обратного преобразования является обратной для матрицы обратимого преобразования.

Алгебра линейных операторов (преобразований)

Рассмотрим множество — линейных преобразований (операторов) n-мерного линейного пространства

. Напомним, что два преобразования

и

называются равными, если

.

На множестве определены две линейные операции: сложение преобразований и умножение преобразования на число, поскольку в результате этих операций получается линейное преобразование.

Нетрудно показать, что эти операции удовлетворяют условиям:

1. ;

2. ;

3. существует нулевое преобразование такое, что

;

4. для каждого преобразования существует противоположное преобразование

такое, что

;

5. и любого числа

;

6. и любых чисел

;

7. и любых чисел

;

8. .

В условиях 5-7 говорится о числах из того же числового поля, над которым определено линейное пространство .

Условия 1-8 повторяют аксиомы линейного пространства. Поэтому множество с линейными операциями является линейным пространством. Если пространство

вещественное (комплексное), то и пространство

вещественное (комплексное).

Найдем размерность пространства . При фиксированном базисе имеется взаимно однозначное соответствие между линейными преобразованиями и их матрицами, причем это соответствие сохраняет линейные операции. Следовательно, пространство

изоморфно пространству

— квадратных матриц n-го порядка. Размерность пространства

равна

. По теореме 8.3:

то есть

Кроме линейных операций в множестве определена операция умножения элементов. Произведением преобразований

и

назовем их композицию, т.е.

. В результате композиции линейных преобразований получается линейное преобразование. Операция умножения удовлетворяет следующим условиям:

1. ;

2. ;

3. ;

4. существует тождественное преобразование такое, что

.

Первое условие выражает ассоциативность операции умножения, условия 2 и 3 — законы дистрибутивности, условие 4 — существование нейтрального элемента. Множество с операциями сложения и умножения элементов является кольцом с единицей (вообще говоря, некоммутативное, так как в общем случае

).

Операции умножения операторов (преобразований) и произведения операторов на число (из заданного числового поля) удовлетворяют условию:

5.

Линейное пространство, которое является кольцом, удовлетворяющим условию 5, называется алгеброй. Поэтому множество называют алгеброй линейных операторов (преобразований).

Многочлены от линейного оператора (преобразования)

В алгебре можно определить целую неотрицательную степень оператора

, полагая по определению

Пусть — многочлен переменной

. Многочленом

от линейного преобразования

называется преобразование

.

Многочлен называется аннулирующим для линейного преобразования

, если

— нулевое преобразование. Заметим, что у каждого линейного преобразования

n-мерного линейного пространства

существует аннулирующий многочлен степени не выше

. Действительно, система из

элементов

линейного пространства

линейно зависима (так как

). Поэтому существуют такие числа

, не все равные нулю одновременно, что

. Следовательно, многочлен

— аннулирующий для преобразования

.

Замечания 9.3

1. При фиксированном базисе каждому преобразованию (оператору) можно сопоставить его матрицу. Свойства линейных операций 1-8, записанные для матриц преобразований, повторяют свойства линейных операций с матрицами, а свойствам 1-5 произведения операторов отвечают свойства операции умножения матриц.

2. При фиксированном базисе многочлен от линейного преобразования

имеет матрицу

, где

— матрица преобразования

в том же базисе. Поэтому свойства многочленов от матриц переносятся на многочлены от линейного преобразования. В частности, многочлены от одного преобразования перестановочны:

3. Функции от матриц определяются при помощи многочленов от матриц. Поэтому можно определить функции от линейных преобразований.

Математический форум (помощь с решением задач, обсуждение вопросов по математике).

Если заметили ошибку, опечатку или есть предложения, напишите в комментариях.

![{displaystyle mathbf {v} =v_{1}mathbf {e} _{1}+v_{2}mathbf {e} _{2}+cdots +v_{n}mathbf {e} _{n}=sum _{i}v_{i}mathbf {e} _{i}=E[mathbf {v} ]_{E}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cd7e2feda21844936fee6fcb19e447df7c275853)

![{displaystyle {begin{aligned}A(mathbf {v} )&=Aleft(sum _{i}v_{i}mathbf {e} _{i}right)=sum _{i}{v_{i}A(mathbf {e} _{i})}\&={begin{bmatrix}A(mathbf {e} _{1})&A(mathbf {e} _{2})&cdots &A(mathbf {e} _{n})end{bmatrix}}[mathbf {v} ]_{E}=Acdot [mathbf {v} ]_{E}\[3pt]&={begin{bmatrix}mathbf {e} _{1}&mathbf {e} _{2}&cdots &mathbf {e} _{n}end{bmatrix}}{begin{bmatrix}a_{1,1}&a_{1,2}&cdots &a_{1,n}\a_{2,1}&a_{2,2}&cdots &a_{2,n}\vdots &vdots &ddots &vdots \a_{n,1}&a_{n,2}&cdots &a_{n,n}\end{bmatrix}}{begin{bmatrix}v_{1}\v_{2}\vdots \v_{n}end{bmatrix}}end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/78e7c729b432477f302eb9fd9d627f2bfa5b56ab)