Содержание:

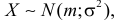

Нормальный закон распределения:

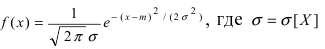

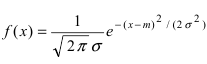

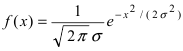

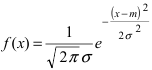

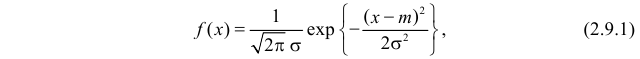

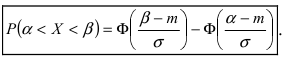

Нормальный закон распределения имеет плотность вероятности

где

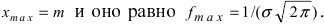

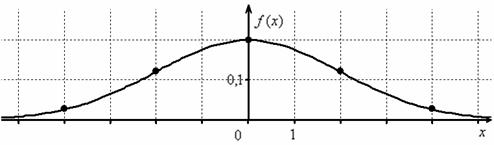

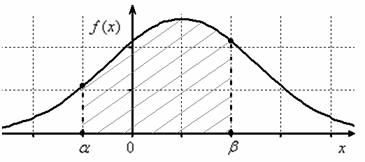

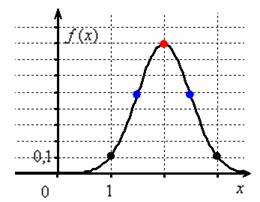

График функции плотности вероятности (2.9.1) имеет максимум в точке

Помимо геометрического смысла, параметры нормального закона распределения имеют и вероятностный смысл. Параметр

где

Значения функции

Если

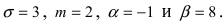

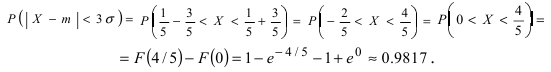

Пример:

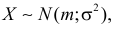

Случайная величина X имеет нормальный закон распределения

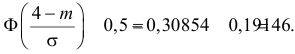

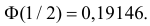

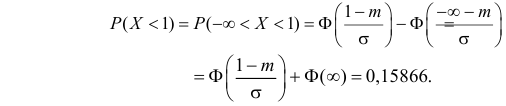

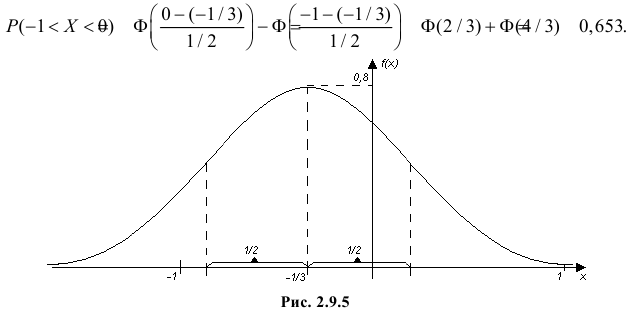

Решение. Воспользуемся формулой (2.9.2):

Так как

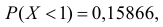

Аналогично

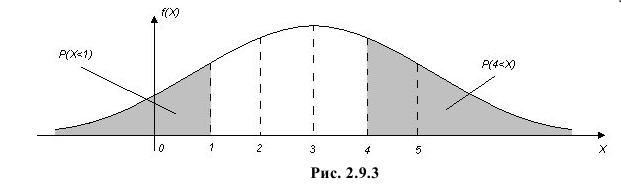

График функции плотности вероятности этого закона распределения изображен на рис. 2.9.3.

Ответ.

Пример:

Ошибка измерения X имеет нормальный закон распределения, причем систематическая ошибка равна 1 мк, а дисперсия ошибки равна 4 мк2. Какова вероятность того, что в трех независимых измерениях ошибка ни разу не превзойдет по модулю 2 мк?

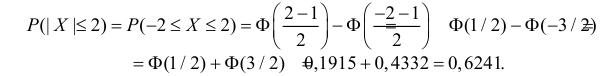

Решение. По условиям задачи

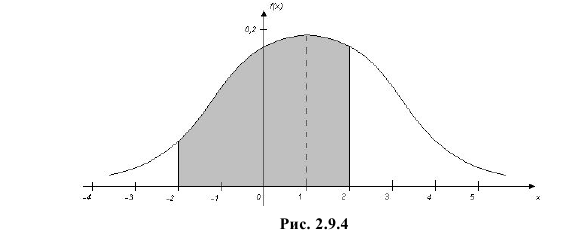

Вычисленная вероятность численно равна заштрихованной площади на рис. 2.9.4.

Каждое измерение можно рассматривать как независимый опыт. Поэтому по формуле Бернулли (2.6.1) вероятность того, что в трех независимых измерениях ошибка ни разу не превзойдет 2 мк, равна

Ответ.

Пример:

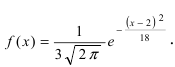

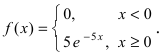

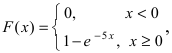

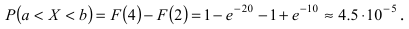

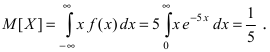

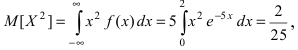

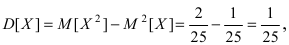

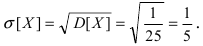

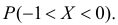

Функция плотности вероятности случайной величины X имеет вид

Требуется определить коэффициент

Замечание. Если каждый закон распределения из некоторого семейства законов распределения имеет функцию распределения ,

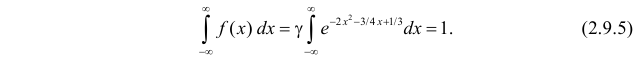

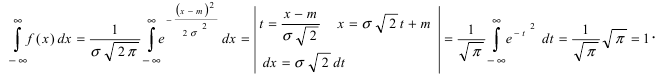

Решение. Так как (2.9.4) функция плотности вероятности, то интеграл от нее по всей числовой оси должен быть равен единице:

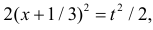

Преобразуем выражение в показателе степени, выделяя полный квадрат:

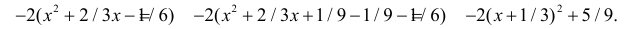

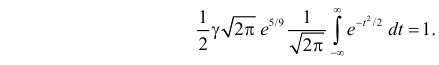

Тогда (2.9.5) можно записать в виде

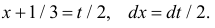

Сделаем замену переменных так, чтобы

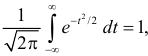

Умножим и разделим левую часть равенства на

Так как

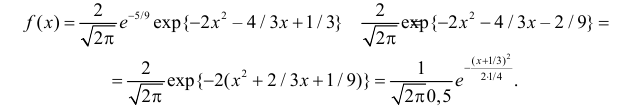

Поэтому

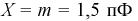

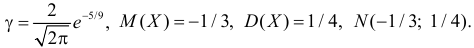

Последняя запись означает, что случайная величина имеет нормальный закон распределения с параметрами

Ответ.

Пример:

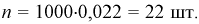

Цех на заводе выпускает транзисторы с емкостью коллекторного перехода

Решение.

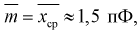

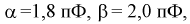

Статистическими исследованиями в цеху установлено, что

Чтобы вычислить количество транзисторов, попадающих в группу

Для расчета этой вероятности надо построить математическую модель. Экспериментальные данные говорят о том, что нормальное распределение можно принять в качестве математической модели. Эмпирическая оценка (установлена статистическими исследованиями в цеху) среднего значения

дает

Обозначая

Тогда количество транзисторов

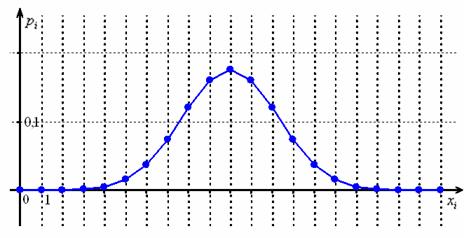

Нормальное распределение и его свойства

Если выйти на улицу любого города и случайным образом выбранных прохожих спросить о том, какой у них рост, вес, возраст, доход, и т.п., а потом построить график любой из этих величин, например, роста… Но не будем спешить, сначала посмотрим, как можно построить такой график.

Сначала, мы просто запишем результаты своего исследования. Потом, мы отсортируем всех людей по группам, так чтобы каждый попал в свой диапазон роста, например, «от 180 до 181 включительно».

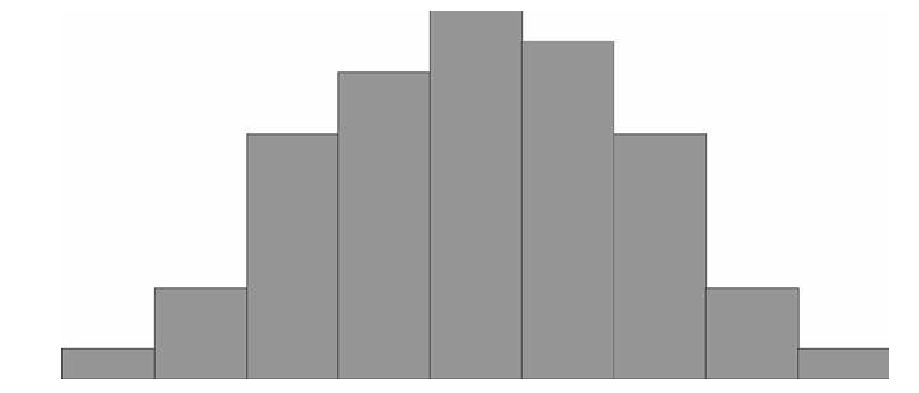

После этого мы должны посчитать количество людей в каждой подгруппе-диапазоне, это будет частота попадания роста жителей города в данный диапазон. Обычно эту часть удобно оформить в виде таблички. Если затем эти частоты построить по оси у, а диапазоны отложить по оси х, можно получить так называемую гистограмму, упорядоченный набор столбиков, ширина которых равна, в данном случае, одному сантиметру, а длина будет равна той частоте, которая соответствует каждому диапазону роста. Если

Вам попалось достаточно много жителей, то Ваша схема будет выглядеть примерно так:

Дальше можно уточнить задачу. Каждый диапазон разбить на десять, жителей рассортировать по росту с точностью до миллиметра. Диаграмма станет глаже, но уменьшится по высоте, «оплывет» вниз, т.к. в каждом маленьком диапазоне количество жителей уменьшается. Чтобы избежать этого, просто увеличим масштаб по вертикальной оси в 10 раз. Если гипотетически повторить эту процедуру несколько раз, будет вырисовываться та знаменитая колоколообразная фигура, которая характерна для нормального (или Гауссова) распределения. В результате, относительная частота встречаемости каждого конкретного диапазона роста может быть посчитана как отношение площади «ломтика» кривой, приходящегося на этот диапазон к площади подо всей кривой. Стандартизированные кривые нормального распределения, значения функций которых приводятся в таблицах книг по статистике, всегда имеют суммарную площадь под кривой равную единице. Это связано с тем, что, как Вы помните из курса теории вероятности, вероятность достоверного события всегда равна 100% (или единице), а для любого человека иметь хоть какое-то значение роста — достоверное событие. А вот вероятность того, что рост произвольного человека попадет в определенный выбранный нами диапазон, будет зависеть от трех факторов.

Во-первых, от величины такого диапазона — чем точнее наши требования, тем меньше вероятности, что нам повезет.

Во-вторых, от того, насколько «популярен» выбранный нами рост. Напомним, что мода — самое часто встречающееся значение роста. Кстати для нормального распределения мода, медиана и среднее значение совпадают. Кривая нормального распределения симметрична относительно среднего значения.

И, в-третьих, вероятность попадания роста в определенный диапазон зависит от характеристики рассеивания случайной величины. Отчасти это связано с единицами измерения (представьте, что мы бы измеряли людей в дюймах, а не в миллиметрах, но сами люди и их рост были бы теми же). Но дело не только в этом. Просто некоторые процессы кучнее группируются возле среднего значения, в то время как другие более разбросаны.

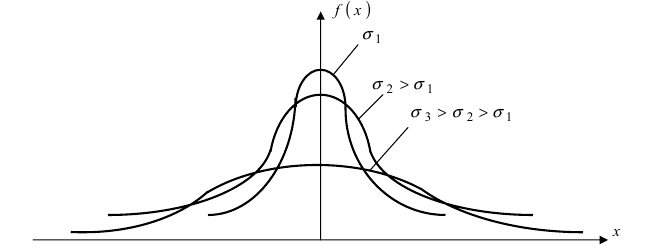

Например, рост собак и рост домашних кошек имеют разный разброс значений, их кривые нормального распределения будут выглядеть по-разному (напомним еще раз, что площадь под обеими кривыми будет единичной).

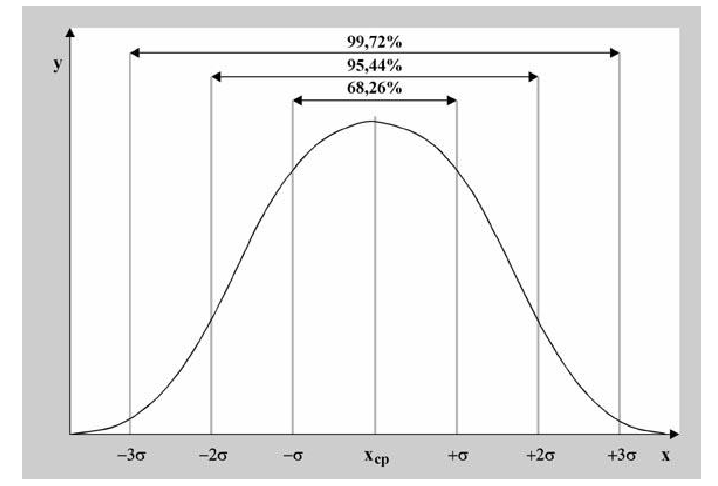

Так, кривая для роста кошек будет более узкой и высокой, а для роста собак кривая будет ниже и шире. Для характеристики разброса конечного ряда данных в прошлом разделе мы использовали величину среднего квадратического отклонения. Аналогичная величина используется для характеристики кривой нормального распределения. Она обозначается буквой s и называется в этом случае стандартным отклонением. Это очень важная величина для кривой нормального распределения. Кривая нормального распределения полностью задана, если известно среднее значение

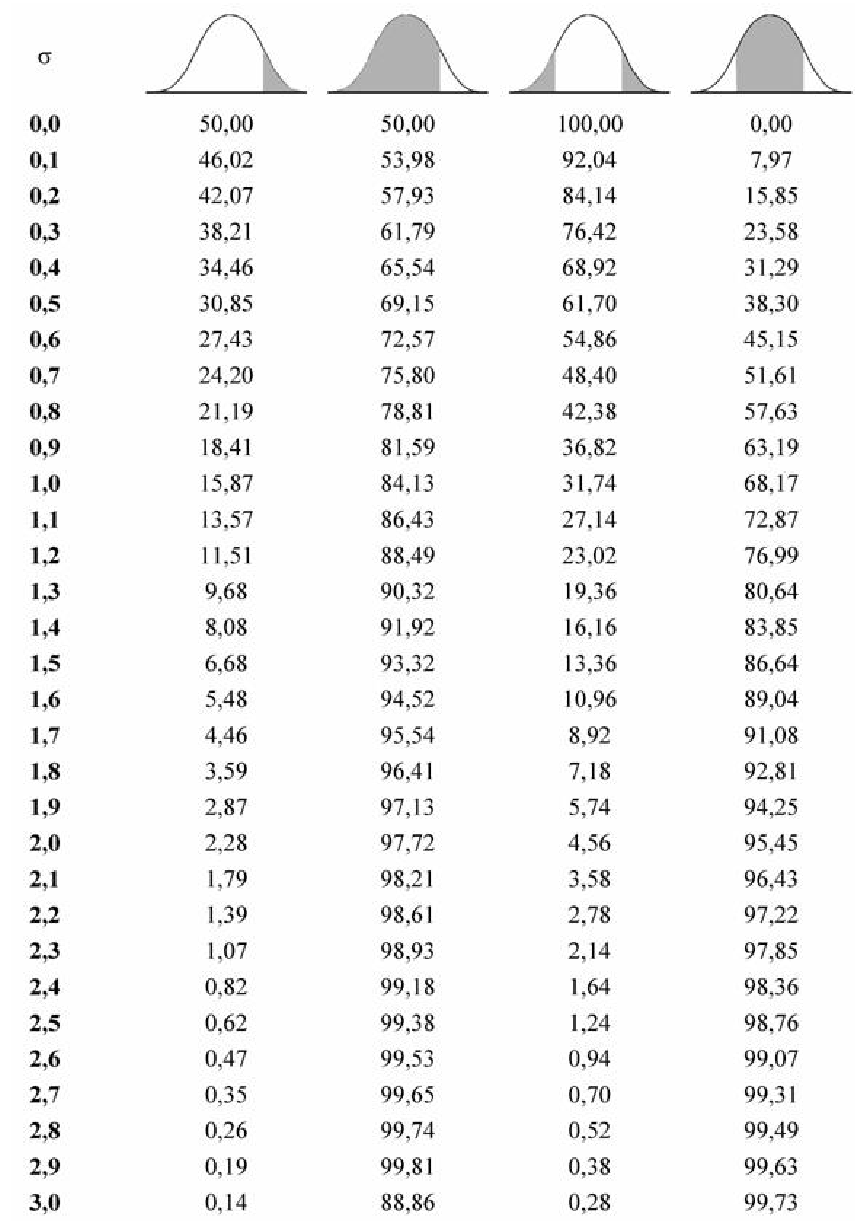

Для вычисления других значений вероятности, которые могут Вам понадобиться, можно воспользоваться приведенной таблицей:

Таблица вероятности попадания случайной величины в отмеченный (заштрихованный) диапазон

Нормальный закон распределения

Нормальный закон распределения случайных величин, который иногда называют законом Гаусса или законом ошибок, занимает особое положение в теории вероятностей, так как 95 % изученных случайных величин подчиняются этому закону. Природа этих случайных величин такова, что их значение в проводимом эксперименте связано с проявлением огромного числа взаимно независимых случайных факторов, действие каждого из которых составляет малую долю их совокупного действия. Например, длина детали, изготавливаемой на станке с программным управлением, зависит от случайных колебаний резца в момент отрезания, от веса и толщины детали, ее формы и температуры, а также от других случайных факторов. По нормальному закону распределения изменяются рост и вес мужчин и женщин, дальность выстрела из орудия, ошибки различных измерений и другие случайные величины.

Определение: Случайная величина X называется нормальной, если она подчиняется нормальному закону распределения, т.е. ее плотность распределения задается формулой

Приведенная дифференциальная функция распределения удовлетворяет всем свойствам плотности вероятности, проверим, например, свойство 4.:

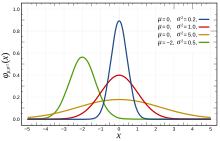

Выясним геометрический смысл параметров

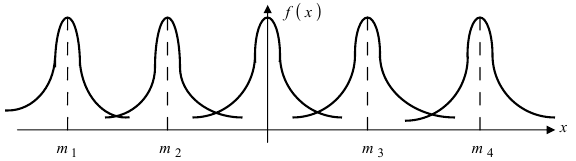

Рис. 8. Изменение графика плотности вероятности в зависимости от изменения математического ожидания при фиксированном значении средне-квадратичного отклонения. Из рисунка видно, кривая

Рис. 9. Изменение графика плотности вероятности в зависимости от изменения средне-квадратичного отклонения при фиксированном значении математического ожидания.

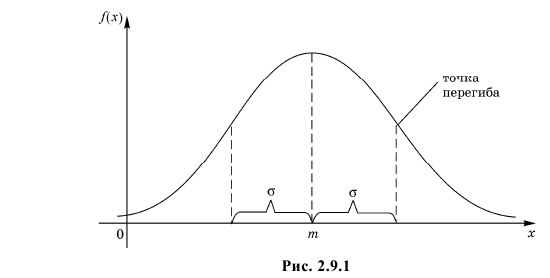

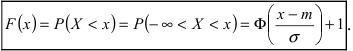

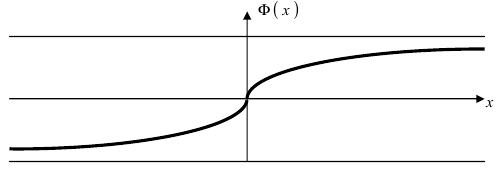

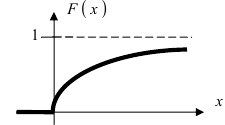

Интегральная функция нормального распределения имеет вид:

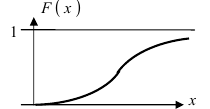

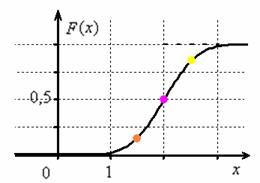

График функции распределения имеет вид (Рис. 10):

Рис. 10. Графика интегральной функции распределения нормальной случайной величины.

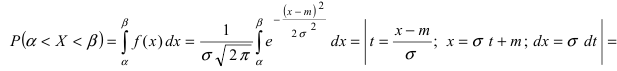

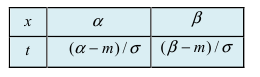

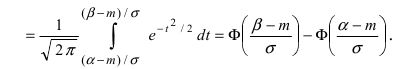

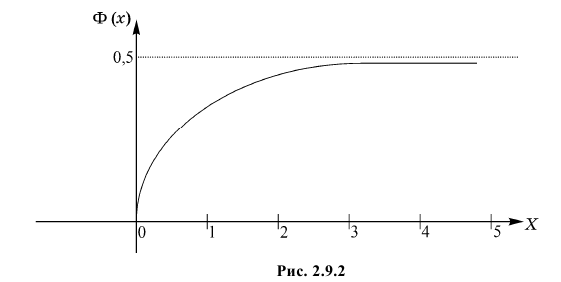

Вероятность попадания нормальной случайной величины в заданный интервал

Пусть требуется определить вероятность того, что нормальная случайная величина попадает в интервал

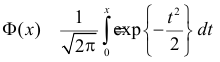

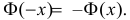

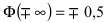

Рассмотрим основные свойства функции Лапласа Ф(х):

- Ф(0) = 0 — график функции Лапласа проходит через начало координат.

- Ф (-х) = — Ф(х) — функция Лапласа является нечетной функцией, поэтому

- таблицы для функции Лапласа приведены только для неотрицательных значений аргумента.

— график функции Лапласа имеет горизонтальные асимптоты

Следовательно, график функции Лапласа имеет вид (Рис. 11):

Рис. 11. График функции Лапласа.

Пример №1

Закон распределения нормальной случайной величины X имеет вид:

Решение:

Согласно условиям задачи

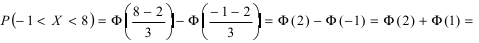

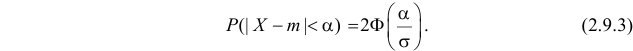

Вычисление вероятности заданного отклонения

Вычисление вероятности заданного отклонения. Правило

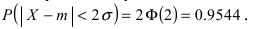

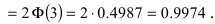

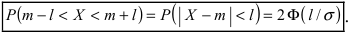

Если интервал, в который попадает нормальная случайная величина X, симметричен относительно математического ожидания

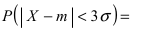

Данная формула показывает, что отклонение случайной величины Х от ее математического ожидания на заданную величину l равна удвоенному значению функции Лапласа от отношения / к среднему квадратичному отклонению. Если положить

Показательный закон распределения

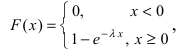

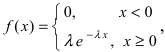

Определение: Закон распределения, определяемый фу нкцией распределения:

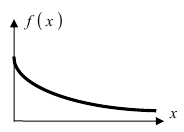

График экспоненциального закона распределения имеет вид (Рис. 12):

Рис. 12. График функции распределения для случая экспоненциального закона.

Дифференциальная функция распределения (плотность вероятности) имеет вид:

Рис. 13. График плотности вероятности для случая экспоненциального закона.

Пример №2

Случайная величина X подчиняется дифференциальной функции распределения

Решение:

Интегральная функция распределения

отклонение

- Основные законы распределения вероятностей

- Асимптотика схемы независимых испытаний

- Функции случайных величин

- Центральная предельная теорема

- Повторные независимые испытания

- Простейший (пуассоновский) поток событий

- Случайные величины

- Числовые характеристики случайных величин

2.5.3. Нормальный закон распределения вероятностей

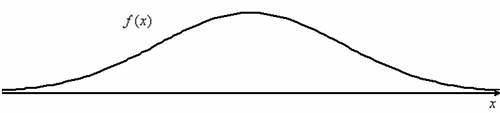

Без преувеличения его можно назвать философским законом. Наблюдая за различными объектами и процессами окружающего мира, мы часто

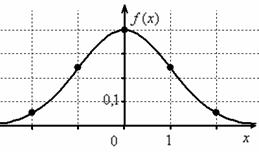

сталкиваемся с тем, что чего-то бывает мало, и что бывает норма. Перед вами принципиальный вид функции плотности нормального распределения вероятностей:

Какие можно примести примеры? Их просто тьма. Это, например, рост, вес людей (и не только), их физическая сила, умственные способности и

т.д. Существует «основная масса» (по тому или иному признаку) и существуют отклонения в обе стороны.

Это различные характеристики неодушевленных объектов (те же размеры, вес). Это случайная продолжительность процессов…, снова пришёл

на ум грустный пример, и поэтому скажу время «жизни» лампочек

быстрые, но большинство двигаются со «стандартными» скоростями.

Более того, даже дискретные распределения бывают близкИ к нормальному, и в конце

урока мы раскроем важную предпосылку «нормальности». А сейчас математика, математика, математика, которая в древности не зря считалась

философией!

Непрерывная случайная величина , распределённая по нормальному закону, имеет функцию

плотности

определяется параметрами и

.

Эта функция получила фамилию некоронованного короля математики, К.Ф. Гаусса и в своё время была изображена вместе с его портретом

на купюре в 10 немецких марок. Для функции Гаусса выполнены общие свойства плотности, а

именно (почему?) и

распределённая случайная величина достоверно примет одно из действительных значений. Теоретически – какое

угодно, практически – узнаем позже.

Следующие замечательные факты я тоже приведу без доказательства:

– то есть, математическое ожидание нормально распределённой случайной величины в точности равно «а», а

среднее квадратическое отклонение в точности равно «сигме»: .

Эти значения выводятся с помощью общих формул, и желающие могут найти подробные выкладки в учебной литературе.

Ну а мы переходим к насущным практическим вопросам. Практики будет много, и она будет интересна не только «чайникам», но и более

подготовленным читателям:

Задача 118

Нормально распределённая случайная величина задана параметрами . Записать её функцию плотности и построить график.

Несмотря на кажущуюся простоту задания, в нём существует немало тонкостей.

Первый момент касается обозначений. Они стандартные: матожидание обозначают буквой (реже

или

(«мю»)), а стандартное отклонение – буквой

. Кстати, обратите внимание, что в условии ничего не

сказано о сущности параметров «а» и «сигма», и несведущий человек может только догадываться, что это такое.

Решение начнём шаблонной фразой: функция плотности нормально

распределённой случайной величины имеет вид

и:

Первая, более лёгкая часть задачи выполнена. Теперь график. Вот на нём-то, на моей памяти, студентов «заворачивали» десятки раз,

причём, многих неоднократно. По той причине, что график функции Гаусса обладает несколькими принципиальными

особенностями, которые нужно обязательно отобразить на чертеже.

Сначала полная картина, затем комментарии:

На первом шаге декартову систему координат. При выполнении чертежа от руки во многих случаях оптимален следующий масштаб:

по оси абсцисс: 2 тетрадные клетки = 1 ед.,

по оси ординат: 2 тетрадные клетки = 0,1 ед., при этом саму ось следует расположить из тех соображений, что в точке функция достигает

максимума, и вертикальная прямая (на чертеже её нет) является линией симметрии

графика.

И логично, что в первую очередь удобно найти максимум функции:

Отмечаем вершину графика (красная точка).

Далее вычислим значения функции при , а точнее только одно из них – в силу симметрии графика они

равны:

Отмечаем синим цветом.

Внимание! и

– это точки перегиба нормальной кривой. На интервале

график является

выпуклым вверх, а на крайних интервалах – вогнутым вниз.

Далее отклоняемся от центра влево и право ещё на одно стандартное отклонение и рассчитываем высоту:

Отмечаем точки на чертеже (зелёный цвет) и видим, что этого вполне достаточно.

На завершающем этапе аккуратно чертим график, и особо аккуратно отражаем его выпуклость /

вогнутость! Ну и, наверное, вы давно поняли, что ось абсцисс – это горизонтальная асимптота, и «залезать» за неё

категорически нельзя!

Поговорим о том, как меняется форма нормальной кривой в зависимости от значений и

.

При увеличении или уменьшении «а» (при неизменном «сигма») график сохраняет свою форму и перемещается вправо или

влево соответственно. Так, при (уменьшили «а» на 3) функция принимает вид

и наш график «переезжает»

на 3 единицы влево – ровнехонько в начало координат:

Нормально распределённая величина с нулевым математическим ожиданием получила вполне естественное название – центрированная; её

функция плотности

чётная, и график симметричен относительно оси ординат.

В случае изменения «сигмы» (при постоянном «а»), график «остаётся на месте», но меняет форму. При увеличении он становится более

низким и вытянутым, словно осьминог, растягивающий щупальца. И, наоборот, при уменьшении график становится более узким и высоким

– как «удивлённый осьминог». Так, при уменьшении «сигмы» в два раза: предыдущий график сужается и вытягивается вверх в два

раза:

Нормальное распределёние с единичным значением «сигма» называется нормированным, а если оно ещё и центрировано (наш

случай), то такое распределение называют стандартным. Оно имеет ещё более простую функцию плотности, которая уже встречалась в локальной теореме Лапласа: . Стандартное распределение нашло широкое применение, и

очень скоро мы окончательно поймём его предназначение.

И как-то незаслуженно осталась в тени функция распределения вероятностей.

Вспоминаем её определение:

вероятность того, что случайная величина примет значение, МЕНЬШЕЕ, чем переменная

, которая «пробегает» все

действительные значения до «плюс» бесконечности.

Внутри интеграла используют другую букву, чтобы не возникало «накладок» с обозначениями, ибо здесь каждому значению ставится в соответствие

несобственный интеграл

. Почти все значения

не поддаются

абсолютно точному расчету, но с современными вычислительными мощностями с этим нет никаких трудностей (ролик на Ютубе).

Так, например, график функции

имеет следующий вид:

На чертеже хорошо видно выполнение всех свойств функции распределения, и из

технических нюансов здесь следует обратить внимание на горизонтальные асимптоты и точку перегиба .

Теперь вспомним одну из ключевых задач темы, а именно выясним, как найти – вероятность того, что

нормальная случайная величина примет

значение из интервала . Геометрически эта вероятность равна площади между

нормальной кривой и осью абсцисс на соответствующем участке:

но каждый раз вымучивать приближенное значение

«лёгкую» формулу:

! Вспоминает также, что:

Тут можно снова задействовать Эксель, но есть пара весомых «но»: во-первых, он не всегда под рукой, а во-вторых, «готовые» значения

, скорее всего,

вызовут вопросы у преподавателя. Почему?

Об этом я неоднократно рассказывал ранее: в своё время (и ещё не очень давно) роскошью был обычный калькулятор, и в учебной

литературе до сих пор сохранился «ручной» способ решения рассматриваемой задачи. Его суть состоит в том, чтобы свести решение к

стандартному распределению:

, где

Зачем это нужно? Дело в том, что значения скрупулезно подсчитаны нашими предками и сведены в

специальную таблицу, которая есть во многих книгах по терверу. Но ещё чаще встречается таблица значений функции Лапласа:

функцией и этой таблицей (см. Приложение Таблицы) мы уже имели дело в интегральной теореме Лапласа.

Итак, вероятность того, что нормальная случайная величина с параметрами

и

примет значение из интервала

, можно вычислить по формуле:

, где

– функция Лапласа.

Таким образом, наша задача становится чуть ли не устной! Порой, здесь хмыкают и говорят, что метод устарел. Может быть…, но

парадокс состоит в том, что «устаревший метод» очень быстро приводит к результату!

И ещё в этом заключена большая мудрость – если вдруг пропадёт электричество или восстанут машины, то у человечества останется

возможность заглянуть в бумажные таблицы и спасти мир =) Классика жанра:

Задача 119

Из пункта ведётся стрельба из орудия вдоль прямой

. Предполагается, что дальность

полёта распределена нормально с математическим ожиданием 1000 м и средним квадратическим отклонением 5 м. Определить (в процентах) сколько

снарядов упадёт с перелётом от 5 до 70м.

Решение: в задаче рассматривается нормально распределённая случайная величина – дальность полёта снаряда, и по

условию .

Так как речь идёт о перелёте за цель, то . Вычислим вероятность

– того, что снаряд упадёт в пределах этой

дистанции.

Если в вашей методичке дана таблица значений функции

:

Для самопроверки можно «забить» и затем

в Пункт 9

Калькулятора, и кроме того, для стандартного нормального распределения в Экселе существует прямая функция

=НОРМСТРАСП(z).

Но гораздо чаще, и в этом курсе в частности, встречается таблица значений функции Лапласа

Дробные значения традиционно округляем до 4 знаков после запятой, как это сделано в типовой таблице. И для контроля есть Пункт

5 макета.

Напоминаю, что . Всегда контролируйте, таблица КАКОЙ функции

перед вашими глазами.

Ответ требуется дать в процентах, поэтому рассчитанную вероятность нужно умножить на 100 и снабдить результат

содержательным комментарием:

– с перелётом от 5 до 70 м упадёт примерно 15,87% снарядов

Тренируемся самостоятельно:

Задача 120

Диаметр подшипников, изготовленные на заводе, представляет собой случайную величину, распределенную нормально с математическим

ожиданием 1,5 см и средним квадратическим отклонением 0,04 см. Найти вероятность того, что размер наугад взятого подшипника колеблется от

1,4 до 1,6 см.

В образце решения и далее я буду использовать функцию Лапласа, как самый распространённый вариант. Кстати, обратите внимание, что

согласно формулировке, в этой задаче корректнее будет включить концы интервала в рассмотрение.

И уже в этом примере нам встретился особый случай – когда интервал симметричен относительно математического ожидания. В

такой ситуации его можно записать в виде и, пользуясь нечётностью функции Лапласа

, упростить рабочую

формулу :

Параметр «дельта» называют отклонением от математического ожидания, и двойное неравенство удобно «упаковать» с помощью модуля:

–

вероятность того, что значение случайной величины отклонится от математического ожидания менее чем на

.

Таким, образом задача про подшипники решается гораздо короче:

–

вероятность того, что диаметр наугад взятого подшипника отличается от 1,5 см не более чем на 0,1 см.

Результат этой задачи получился близким к единице, но хотелось бы ещё бОльшей надежности – а именно, узнать границы, в которых

находится диаметр почти всех подшипников. Существует ли какой-нибудь критерий на этот счёт? Существует! На этот вопрос отвечает

так называемое правило «трех сигм».

Его суть состоит в том, что практически достоверным является тот факт, что

нормально распределённая случайная величина примет значение из промежутка

. И в самом деле, вероятность

отклонения от матожидания менее чем на составляет:

или

99,73%

В «пересчёте на подшипники» – это 9973 штуки с диаметром от 1,38 до 1,62 см и всего лишь 27 «некондиционных» экземпляров.

Продолжаем решать суровые советские задачи:

Задача 121

Случайная величина ошибки взвешивания распределена по нормальному закону

с нулевым математическим ожиданием и стандартным отклонением 3 грамма. Найти вероятность того, что очередное взвешивание будет проведено с

ошибкой, не превышающей по модулю 5 грамм.

Решение очень простое. По условию, и сразу заметим, что по правилу «трёх сигм», при

очередном взвешивании (чего-то или кого-то) мы почти 100% получим погрешность менее 9 грамм. Но в задаче фигурирует более узкое

отклонение и по

формуле :

–

вероятность того, что очередное взвешивание будет проведено с ошибкой, не превышающей 5 грамм.

Ответ:

Этот пример принципиально отличается от вроде бы похожей задачи параграфа о равномерном распределении. Там была погрешность округления результатов измерений,

здесь же речь идёт о случайной погрешности самих измерений. Такие погрешности возникают в связи с техническими характеристиками самого

прибора (диапазон допустимых ошибок, как правило, указывают в его паспорте), а также по вине самого экспериментатора – когда мы,

например, «на глазок» снимаем показания со стрелки механических весов.

Помимо прочих, существуют ещё так называемые систематические ошибки измерения. Это уже неслучайные ошибки, которые

возникают по причине некорректной настройки или эксплуатации прибора. Так, например, неотрегулированные напольные весы могут стабильно

«прибавлять» килограмм, а продавец систематически обвешивать покупателей. Или не систематически, ведь можно обсчитать

случае, случайной такая «ошибка» не будет, и её матожидание отлично от нуля.

…срочно разрабатываю курс по подготовке продавцов =)

Самостоятельно решаем обратную задачу:

Задача 122

Диаметр валика – случайная нормально распределенная случайная величина, среднее квадратическое отклонение ее равно мм. Найти длину интервала,

симметричного относительно математического ожидания, в который с вероятностью попадет длина диаметра валика.

Пункт 5* Калькулятора в помощь. Обратите внимание, что здесь не известно математическое ожидание,

но это нисколько не мешает решить поставленную задачу.

И экзаменационное задание, которое я настоятельно рекомендую для закрепления материала:

Задача 123

Нормально распределенная случайная величина задана своими параметрами

(математическое ожидание) и

(среднее квадратическим отклонение).

Требуется:

а) записать плотность вероятности и схематически изобразить ее график;

б) найти вероятность того, что примет значение из интервала

;

в) найти вероятность того, что отклонится по модулю от

не более чем на

;

г) применяя правило «трех сигм», найти значения случайной величины .

Такие задачи предлагаются повсеместно, и за годы практики мне их довелось решить сотни и сотни штук. Обязательно попрактикуйтесь в

ручном построении чертежа и использовании таблицы

Задача 124

Плотность распределения вероятностей случайной величины имеет вид

. Найти

, математическое ожидание

, дисперсию

, функцию распределения

, построить графики плотности и

функции распределения, найти .

Решение: прежде всего, обратим внимание, что в условии ничего не сказано о характере случайной величины. Само по

себе присутствие экспоненты ещё ничего не значит: это может оказаться, например, показательное или вообще произвольное непрерывное распределение. И поэтому «нормальность» распределения ещё нужно обосновать:

функция определена при любом действительном значении

, и если её

удастся привести к виду

распределена по нормальному закону.

Пробуем привести. Для этого выделяем полный квадрат и

организуем трёхэтажную дробь:

Обязательно выполняем проверку, возвращая показатель в исходный вид:

, что мы и

хотели увидеть.

Таким образом, мы действительно имеем дело с нормальным распределением:

правилу действий со степенями «отщипываем» . И здесь можно сразу записать очевидные числовые

характеристики:

Теперь найдём значение параметра . Поскольку множитель нормального распределения имеет

вид и

, то:

выражаем и

подставляем в нашу функцию:

ещё раз пробежим глазами и убедимся, что полученная функция имеет вид

Построим график плотности:

и график функции распределения

Пару слов на счёт ручного построения последнего графика – на случай отсутствия под рукой Экселя или даже обычного калькулятора. В

точке функция

распределения принимает значение и здесь находится перегиб графика (малиновая точка).

Кроме того, для более или менее приличного чертежа желательно найти ещё хотя бы пару точек. Берём традиционное значение и

стандартизируем его по формуле . Далее по таблице значений функции Лапласа находим:

– жёлтая точка на

чертеже. С симметричной оранжевой точкой никаких проблем: и:

.

После чего аккуратно проводим интегральную кривую, не забывая о перегибе и двух горизонтальных асимптотах.

Да, и ещё нужно вычислить:

–

вероятность того, что случайная величина примет значение из данного отрезка.

Задача была непростой, и посему блеснём академичным стилем, ответ:

А теперь обещанный секрет:

понятие о центральной предельной теореме.

которую также называют теоремой Ляпунова. Её суть состоит в том, что если случайная величина является суммой очень большого числа взаимно

независимых случайных величин , влияние каждой из которых на всю сумму ничтожно мало, то

имеет

распределение, близкое к нормальному.

В окружающем мире условие теоремы Ляпунова выполняется очень часто, и поэтому нормальное распределение встречается буквально на

каждом шагу.

Так, например, молекул воздуха очень и очень много, и каждая из них своим движением оказывает ничтожно малое влияние на всю

совокупность. Поэтому скорость молекул воздуха распределена нормально.

Большая популяция некоторых особей. Каждая из них (или подавляющее большинство) оказывает несущественное влияние на жизнь всей

популяции, следовательно, продолжительность жизни этих особей тоже распределена по нормальному закону.

Теперь вернёмся к знакомой задаче, где проводится независимых

испытаний, в каждом из которых некое событие может появиться с постоянной вероятностью

. Эти испытания можно

считать попарно независимым случайными величинами , и при достаточно большом значении «эн» биномиальное распределение случайной величины

– числа появлений события

в

испытаниях – очень близко к

нормальному распределению.

Уже при и

в многоугольнике биномиального распределения хорошо просматривается нормальная кривая:

И чем больше , тем ближе будет сходство. Причём, вероятность

может быть любой, но

не слишком малой.

Именно этот факт мы и использовали в теоремах Лапласа – когда приближали биномиальные

вероятности соответствующими значениями функций нормального распределения.

Подчёркиваю, что теорема Ляпунова носит статус теоремы, а значит, строго доказана в теории.

И в заключение книги хочется ответить на один философский вопрос: имеет ли в нашей жизни значение случайность? Безусловно! Везение

играет немаловажную, а порой, и огромную роль: встретить хороших друзей, встретить «своего» человека, найти деятельность по душе и т.д. –

всё это нередко происходит благодаря случаю….

Но, с другой стороны, гораздо более важнА системная и упорная деятельность, после которой следуют закономерные результаты.

Желательно, полезные, конечно J

Дополнительную информацию можно найти в соответствующем разделе портала mathprofi.ru (ссылка

на карту раздела). Из учебной литературы рекомендую:

Гмурман В. Е. Теория вероятностей и математическая статистика (уч. пособие);

Гмурман В. Е. Руководство к решению задач по теории вероятности (задачник с примерами решений).

Везения в главном!

| Оглавление |

Полную и свежую версию этой книги в pdf-формате,

а также курсы по другим темам можно найти здесь.

Также вы можете изучить эту тему подробнее – просто, доступно, весело и бесплатно!

С наилучшими пожеланиями, Александр Емелин

Нормальным называют распределение вероятностей непрерывной случайной величины

, плотность которого имеет вид:

где

–

математическое ожидание,

–

среднее квадратическое отклонение

.

Вероятность того, что

примет

значение, принадлежащее интервалу

:

где

– функция Лапласа:

Вероятность того, что абсолютная

величина отклонения меньше положительного числа

:

В частности, при

справедливо

равенство:

Асимметрия, эксцесс,

мода и медиана нормального распределения соответственно равны:

, где

Правило трех сигм

Преобразуем формулу:

Положив

. В итоге получим

если

, и, следовательно,

, то

то есть вероятность того, что

отклонение по абсолютной величине будет меньше утроенного среднего квадратического отклонение, равна 0,9973.

Другими словами, вероятность того,

что абсолютная величина отклонения превысит утроенное среднее квадратическое отклонение, очень мала, а именно равна

0,0027. Это означает, что лишь в 0,27% случаев так может произойти. Такие

события исходя из принципа невозможности маловероятных

событий можно считать практически невозможными. В этом и состоит

сущность правила трех сигм: если случайная величина распределена нормально, то

абсолютная величина ее отклонения от математического ожидания не превосходит

утроенного среднего квадратического отклонения.

На практике правило трех сигм

применяют так: если распределение изучаемой случайной величины неизвестно, но

условие, указанное в приведенном правиле, выполняется, то есть основание

предполагать, что изучаемая величина распределена нормально; в противном случае

она не распределена нормально.

Смежные темы решебника:

- Таблица значений функции Лапласа

- Непрерывная случайная величина

- Показательный закон распределения случайной величины

- Равномерный закон распределения случайной величины

Пример 2

Ошибка

высотометра распределена нормально с математическим ожиданием 20 мм и средним

квадратичным отклонением 10 мм.

а) Найти

вероятность того, что отклонение ошибки от среднего ее значения не превзойдет 5

мм по абсолютной величине.

б) Какова

вероятность, что из 4 измерений два попадут в указанный интервал, а 2 – не

превысят 15 мм?

в)

Сформулируйте правило трех сигм для данной случайной величины и изобразите

схематично функции плотности вероятностей и распределения.

Решение

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

а) Вероятность того, что случайная величина, распределенная по

нормальному закону, отклонится от среднего не более чем на величину

:

В нашем

случае получаем:

б) Найдем

вероятность того, что отклонение ошибки от среднего значения не превзойдет 15

мм:

Пусть событие

– ошибки 2

измерений не превзойдут 5 мм и ошибки 2 измерений не превзойдут 0,8664 мм

– ошибка не

превзошла 5 мм;

– ошибка не

превзошла 15 мм

в)

Для заданной нормальной величины получаем следующее правило трех сигм:

Ошибка высотометра будет лежать в интервале:

Функция плотности вероятностей:

График плотности распределения нормально распределенной случайной величины

Функция распределения:

График функции

распределения нормально распределенной случайной величины

Задача 1

Среднее

количество осадков за июнь 19 см. Среднеквадратическое отклонение количества

осадков 5 см. Предполагая, что количество осадков нормально-распределенная

случайная величина найти вероятность того, что будет не менее 13 см осадков.

Какой уровень превзойдет количество осадков с вероятностью 0,95?

Задача 2

Найти

закон распределения среднего арифметического девяти измерений нормальной

случайной величины с параметрами m=1.0 σ=3.0. Чему равна вероятность того, что

модуль разности между средним арифметическим и математическим ожиданием

превысит 0,5?

Указание:

воспользоваться таблицами нормального распределения (функции Лапласа).

Задача 3

Отклонение

напряжения в сети переменного тока описывается нормальным законом

распределения. Дисперсия составляет 20 В. Какова вероятность при изменении

выйти за пределы требуемых 10% (22 В).

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 4

Автомат

штампует детали. Контролируется длина детали Х, которая распределена нормально

с математическим ожиданием (проектная длинна), равная 50 мм. Фактическая длина

изготовленных деталей не менее 32 и не более 68 мм. Найти вероятность того, что

длина наудачу взятой детали: а) больше 55 мм; б) меньше 40 мм.

Задача 5

Случайная

величина X распределена нормально с математическим ожиданием a=10и средним

квадратическим отклонением σ=5. Найти

интервал, симметричный относительно математического ожидания, в котором с

вероятностью 0,9973 попадает величина Х в результате испытания.

Задача 6

Заданы

математическое ожидание ax=19 и среднее квадратическое отклонение σ=4

нормально распределенной случайной величины X. Найти: 1) вероятность

того, что X примет значение, принадлежащее интервалу (α=15;

β=19); 2) вероятность того, что абсолютная величина отклонения значения

величины от математического ожидания окажется меньше δ=18.

Задача 7

Диаметр

выпускаемой детали – случайная величина, распределенная по нормальному закону с

математическим ожиданием и дисперсией, равными соответственно 10 см и 0,16 см2.

Найти вероятность того, что две взятые наудачу детали имеют отклонение от

математического ожидания по абсолютной величине не более 0,16 см.

Задача 8

Ошибка

прогноза температуры воздуха есть случайная величина с m=0,σ=2℃. Найти вероятность

того, что в течение недели ошибка прогноза трижды превысит по абсолютной

величине 4℃.

Задача 9

Непрерывная

случайная величина X распределена по нормальному

закону: X∈N(a,σ).

а) Написать

плотность распределения вероятностей и функцию распределения.

б) Найти

вероятность того, что в результате испытания случайная величина примет значение

из интервала (α,β).

в) Определить

приближенно минимальное и максимальное значения случайной величины X.

г) Найти

интервал, симметричный относительно математического ожидания a, в котором с

вероятностью 0,98 будут заключены значения X.

a=5; σ=1.3;

α=4; β=6

Задача 10

Производится измерение вала без

систематических ошибок. Случайные ошибки измерения X

подчинены нормальному закону с σx=10. Найти вероятность того, что измерение будет

произведено с ошибкой, превышающей по абсолютной величине 15 мм.

Задача 11

Высота

стебля озимой пшеницы — случайная величина, распределенная по нормальному закону

с параметрами a = 75 см, σ = 1 см. Найти вероятность того, что высота стебля:

а) окажется от 72 до 80 см; б) отклонится от среднего не более чем на 0,5 см.

Задача 12

Деталь,

изготовленная автоматом, считается годной, если отклонение контролируемого

размера от номинала не превышает 10 мм. Точность изготовления деталей

характеризуется средним квадратическим отклонением, при данной технологии

равным 5 мм.

а)

Считая, что отклонение размера детали от номинала есть нормально распределенная

случайная величина, найти долю годных деталей, изготовляемых автоматом.

б) Какой

должна быть точность изготовления, чтобы процент годных деталей повысился до

98?

в)

Написать выражение для функции плотности вероятности и распределения случайной

величины.

Задача 13

Диаметр

детали, изготовленной цехом, является случайной величиной, распределенной по

нормальному закону. Дисперсия ее равна 0,0001 см, а математическое ожидание –

2,5 см. Найдите границы, симметричные относительно математического ожидания, в

которых с вероятностью 0,9973 заключен диаметр наудачу взятой детали. Какова

вероятность того, что в серии из 1000 испытаний размер диаметра двух деталей

выйдет за найденные границы?

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 14

Предприятие

производит детали, размер которых распределен по нормальному закону с

математическим ожиданием 20 см и стандартным отклонением 2 см. Деталь будет

забракована, если ее размер отклонится от среднего (математического ожидания)

более, чем на 2 стандартных отклонения. Наугад выбрали две детали. Какова вероятность

того, что хотя бы одна из них будет забракована?

Задача 15

Диаметры

деталей распределены по нормальному закону. Среднее значение диаметра равно d=14 мм

, среднее квадратическое

отклонение σ=2 мм

. Найти вероятность того,

что диаметр наудачу взятой детали будет больше α=15 мм и не меньше β=19 мм; вероятность того, что диаметр детали

отклонится от стандартной длины не более, чем на Δ=1,5 мм.

Задача 16

В

электропечи установлена термопара, показывающая температуру с некоторой

ошибкой, распределенной по нормальному закону с нулевым математическим

ожиданием и средним квадратическим отклонением σ=10℃. В момент когда термопара

покажет температуру не ниже 600℃, печь автоматически отключается. Найти

вероятность того, что печь отключается при температуре не превышающей 540℃ (то

есть ошибка будет не меньше 30℃).

Задача 17

Длина

детали представляет собой нормальную случайную величину с математическим

ожиданием 40 мм и среднеквадратическим отклонением 3 мм. Найти:

а)

Вероятность того, что длина взятой наугад детали будет больше 34 мм и меньше 43

мм;

б)

Вероятность того, что длина взятой наугад детали отклонится от ее

математического ожидания не более, чем на 1,5 мм.

Задача 18

Случайное

отклонение размера детали от номинала распределены нормально. Математическое

ожидание размера детали равно 200 мм, среднее квадратическое отклонение равно

0,25 мм, стандартами считаются детали, размер которых заключен между 199,5 мм и

200,5 мм. Из-за нарушения технологии точность изготовления деталей уменьшилась

и характеризуется средним квадратическим отклонением 0,4 мм. На сколько

повысился процент бракованных деталей?

Задача 19

Случайная

величина X~N(1,22). Найти P{2

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 20

Заряд пороха для охотничьего ружья

должен составлять 2,3 г. Заряд отвешивается на весах, имеющих ошибку

взвешивания, распределенную по нормальному закону со средним квадратическим

отклонением, равным 0,2 г. Определить вероятность повреждения ружья, если максимально

допустимый вес заряда составляет 2,8 г.

Задача 21

Заряд

охотничьего пороха отвешивается на весах, имеющих среднеквадратическую ошибку

взвешивания 150 мг. Номинальный вес порохового заряда 2,3 г. Определить

вероятность повреждения ружья, если максимально допустимый вес порохового

заряда 2,5 г.

Задача 21

Найти

вероятность попадания снарядов в интервал (α1=10.7; α2=11.2).

Если случайная величина X распределена по

нормальному закону с параметрами m=11;

σ=0.2.

Задача 22

Плотность

вероятности распределения случайной величины имеет вид

Найти

вероятность того, что из 3 независимых случайных величин, распределенных по

данному закону, 3 окажутся на интервале (-∞;5).

Задача 23

Непрерывная

случайная величина имеет нормальное распределение. Её математическое ожидание

равно 12, среднее квадратичное отклонение равно 2. Найти вероятность того, что

в результате испытания случайная величина примет значение в интервале (8,14)

Задача 24

Вероятность

попадания нормально распределенной случайной величины с математическим

ожиданием m=4 в интервал (3;5) равна 0,6. Найти дисперсию данной случайной

величины.

Задача 25

В

нормально распределенной совокупности 17% значений случайной величины X

меньше 13% и 47% значений случайной величины X

больше 19%. Найти параметры этой совокупности.

Задача 26

Студенты

мужского пола образовательного учреждения были обследованы на предмет

физических характеристик и обнаружили, что средний рост составляет 182 см, со

стандартным отклонением 6 см. Предполагая нормальное распределение для роста,

найдите вероятность того, что конкретный студент-мужчина имеет рост более 185

см.

|

Probability density function The red curve is the standard normal distribution |

|

|

Cumulative distribution function |

|

| Notation |

|

|---|---|

| Parameters |

= mean (location) = mean (location) = variance (squared scale) = variance (squared scale) |

| Support |

|

|

|

| CDF |

![{displaystyle {frac {1}{2}}left[1+operatorname {erf} left({frac {x-mu }{sigma {sqrt {2}}}}right)right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/187f33664b79492eedf4406c66d67f9fe5f524ea) |

| Quantile |

|

| Mean |

|

| Median |

|

| Mode |

|

| Variance |

|

| MAD |

|

| Skewness |

|

| Ex. kurtosis |

|

| Entropy |

|

| MGF |

|

| CF |

|

| Fisher information |

|

| Kullback-Leibler divergence |

|

| CVaR (ES) |

[1] [1] |

In statistics, a normal distribution or Gaussian distribution is a type of continuous probability distribution for a real-valued random variable. The general form of its probability density function is

The parameter

Normal distributions are important in statistics and are often used in the natural and social sciences to represent real-valued random variables whose distributions are not known.[2][3] Their importance is partly due to the central limit theorem. It states that, under some conditions, the average of many samples (observations) of a random variable with finite mean and variance is itself a random variable—whose distribution converges to a normal distribution as the number of samples increases. Therefore, physical quantities that are expected to be the sum of many independent processes, such as measurement errors, often have distributions that are nearly normal.[4]

Moreover, Gaussian distributions have some unique properties that are valuable in analytic studies. For instance, any linear combination of a fixed collection of normal deviates is a normal deviate. Many results and methods, such as propagation of uncertainty and least squares parameter fitting, can be derived analytically in explicit form when the relevant variables are normally distributed.

A normal distribution is sometimes informally called a bell curve.[5] However, many other distributions are bell-shaped (such as the Cauchy, Student’s t, and logistic distributions). For other names, see Naming.

The univariate probability distribution is generalized for vectors in the multivariate normal distribution and for matrices in the matrix normal distribution.

Definitions[edit]

Standard normal distribution[edit]

The simplest case of a normal distribution is known as the standard normal distribution or unit normal distribution. This is a special case when

The variable

Although the density above is most commonly known as the standard normal, a few authors have used that term to describe other versions of the normal distribution. Carl Friedrich Gauss, for example, once defined the standard normal as

which has a variance of 1/2, and Stephen Stigler[6] once defined the standard normal as

which has a simple functional form and a variance of

General normal distribution[edit]

Every normal distribution is a version of the standard normal distribution, whose domain has been stretched by a factor

The probability density must be scaled by

If

Notation[edit]

The probability density of the standard Gaussian distribution (standard normal distribution, with zero mean and unit variance) is often denoted with the Greek letter

The normal distribution is often referred to as

Alternative parameterizations[edit]

Some authors advocate using the precision

This choice is claimed to have advantages in numerical computations when

Alternatively, the reciprocal of the standard deviation

According to Stigler, this formulation is advantageous because of a much simpler and easier-to-remember formula, and simple approximate formulas for the quantiles of the distribution.

Normal distributions form an exponential family with natural parameters

Cumulative distribution functions[edit]

The cumulative distribution function (CDF) of the standard normal distribution, usually denoted with the capital Greek letter

The related error function

![[-x,x]](https://wikimedia.org/api/rest_v1/media/math/render/svg/e23c41ff0bd6f01a0e27054c2b85819fcd08b762)

These integrals cannot be expressed in terms of elementary functions, and are often said to be special functions. However, many numerical approximations are known; see below for more.

The two functions are closely related, namely

For a generic normal distribution with density

The complement of the standard normal CDF,

The graph of the standard normal CDF

The CDF of the standard normal distribution can be expanded by Integration by parts into a series:

where

An asymptotic expansion of the CDF for large x can also be derived using integration by parts. For more, see Error function#Asymptotic expansion.[13]

A quick approximation to the standard normal distribution’s CDF can be found by using a Taylor series approximation:

Recursive computation with Taylor Series expansion[edit]

The recursive nature of the

Where:

Using the Taylor series and Newton’s method for the inverse function[edit]

An application for the above Taylor series expansion is to use Newton’s method to reverse the computation. That is, if we have a value for the CDF,

To solve, select a known approximate solution,

Repeat the following process until the difference between the computed

Where

When the repeated computations converge to an error below the chosen acceptably small value, x will be the value needed to obtain a

Standard deviation and coverage[edit]

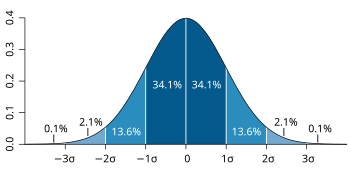

For the normal distribution, the values less than one standard deviation away from the mean account for 68.27% of the set; while two standard deviations from the mean account for 95.45%; and three standard deviations account for 99.73%.

About 68% of values drawn from a normal distribution are within one standard deviation σ away from the mean; about 95% of the values lie within two standard deviations; and about 99.7% are within three standard deviations.[5] This fact is known as the 68-95-99.7 (empirical) rule, or the 3-sigma rule.

More precisely, the probability that a normal deviate lies in the range between

To 12 significant digits, the values for

|

|

|

|

OEIS | ||

|---|---|---|---|---|---|---|

| 1 | 0.682689492137 | 0.317310507863 |

|

OEIS: A178647 | ||

| 2 | 0.954499736104 | 0.045500263896 |

|

OEIS: A110894 | ||

| 3 | 0.997300203937 | 0.002699796063 |

|

OEIS: A270712 | ||

| 4 | 0.999936657516 | 0.000063342484 |

|

|||

| 5 | 0.999999426697 | 0.000000573303 |

|

|||

| 6 | 0.999999998027 | 0.000000001973 |

|

For large

Quantile function[edit]

The quantile function of a distribution is the inverse of the cumulative distribution function. The quantile function of the standard normal distribution is called the probit function, and can be expressed in terms of the inverse error function:

For a normal random variable with mean

The quantile

The following table gives the quantile

|

|

|

|

|

|---|---|---|---|---|

| 0.80 | 1.281551565545 | 0.999 | 3.290526731492 | |

| 0.90 | 1.644853626951 | 0.9999 | 3.890591886413 | |

| 0.95 | 1.959963984540 | 0.99999 | 4.417173413469 | |

| 0.98 | 2.326347874041 | 0.999999 | 4.891638475699 | |

| 0.99 | 2.575829303549 | 0.9999999 | 5.326723886384 | |

| 0.995 | 2.807033768344 | 0.99999999 | 5.730728868236 | |

| 0.998 | 3.090232306168 | 0.999999999 | 6.109410204869 |

For small

Properties[edit]

The normal distribution is the only distribution whose cumulants beyond the first two (i.e., other than the mean and variance) are zero. It is also the continuous distribution with the maximum entropy for a specified mean and variance.[14][15] Geary has shown, assuming that the mean and variance are finite, that the normal distribution is the only distribution where the mean and variance calculated from a set of independent draws are independent of each other.[16][17]

The normal distribution is a subclass of the elliptical distributions. The normal distribution is symmetric about its mean, and is non-zero over the entire real line. As such it may not be a suitable model for variables that are inherently positive or strongly skewed, such as the weight of a person or the price of a share. Such variables may be better described by other distributions, such as the log-normal distribution or the Pareto distribution.

The value of the normal distribution is practically zero when the value

The Gaussian distribution belongs to the family of stable distributions which are the attractors of sums of independent, identically distributed distributions whether or not the mean or variance is finite. Except for the Gaussian which is a limiting case, all stable distributions have heavy tails and infinite variance. It is one of the few distributions that are stable and that have probability density functions that can be expressed analytically, the others being the Cauchy distribution and the Lévy distribution.

Symmetries and derivatives[edit]

The normal distribution with density

Furthermore, the density

Moments[edit]

The plain and absolute moments of a variable

If

Here

The central absolute moments coincide with plain moments for all even orders, but are nonzero for odd orders. For any non-negative integer

The last formula is valid also for any non-integer

These expressions remain valid even if

| Order | Non-central moment | Central moment |

|---|---|---|

| 1 |

|

|

| 2 |

|

|

| 3 |

|

|

| 4 |

|

|

| 5 |

|

|

| 6 |

|

|

| 7 |

|

|

| 8 |

|

|

The expectation of

![[a,b]](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935)

where

Fourier transform and characteristic function[edit]

The Fourier transform of a normal density

where

In probability theory, the Fourier transform of the probability distribution of a real-valued random variable

Moment and cumulant generating functions[edit]

The moment generating function of a real random variable

The cumulant generating function is the logarithm of the moment generating function, namely

Since this is a quadratic polynomial in

Stein operator and class[edit]

Within Stein’s method the Stein operator and class of a random variable

![{displaystyle f:mathbb {R} to mathbb {R} {mbox{ such that }}mathbb {E} [|f'(X)|]<infty }](https://wikimedia.org/api/rest_v1/media/math/render/svg/69d73a6b7e591a67eaff64aaf974a8c37584626e)

Zero-variance limit[edit]

In the limit when

However, one can define the normal distribution with zero variance as a generalized function; specifically, as Dirac’s «delta function»

Its CDF is then the Heaviside step function translated by the mean

Maximum entropy[edit]

Of all probability distributions over the reals with a specified mean

where

where

At maximum entropy, a small variation

Since this must hold for any small

Using the constraint equations to solve for

The entropy of a normal distribution is equal to

Other properties[edit]

- If the characteristic function

of some random variable

is of the form

, where

is a polynomial, then the Marcinkiewicz theorem (named after Józef Marcinkiewicz) asserts that

can be at most a quadratic polynomial, and therefore

is a normal random variable.[28] The consequence of this result is that the normal distribution is the only distribution with a finite number (two) of non-zero cumulants.

- If

and

are jointly normal and uncorrelated, then they are independent. The requirement that

and

should be jointly normal is essential; without it the property does not hold.[29][30][proof] For non-normal random variables uncorrelatedness does not imply independence.

- The Kullback–Leibler divergence of one normal distribution

from another

is given by:[31]

The Hellinger distance between the same distributions is equal to

- The Fisher information matrix for a normal distribution w.r.t.

and

is diagonal and takes the form

- The conjugate prior of the mean of a normal distribution is another normal distribution.[32] Specifically, if

are iid

and the prior is

, then the posterior distribution for the estimator of

will be

- The family of normal distributions not only forms an exponential family (EF), but in fact forms a natural exponential family (NEF) with quadratic variance function (NEF-QVF). Many properties of normal distributions generalize to properties of NEF-QVF distributions, NEF distributions, or EF distributions generally. NEF-QVF distributions comprises 6 families, including Poisson, Gamma, binomial, and negative binomial distributions, while many of the common families studied in probability and statistics are NEF or EF.

- In information geometry, the family of normal distributions forms a statistical manifold with constant curvature

. The same family is flat with respect to the (±1)-connections

and

.[33]

[edit]

Central limit theorem[edit]

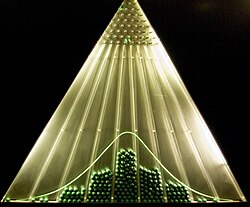

As the number of discrete events increases, the function begins to resemble a normal distribution

Comparison of probability density functions,

The central limit theorem states that under certain (fairly common) conditions, the sum of many random variables will have an approximately normal distribution. More specifically, where

mean scaled by

Then, as

The theorem can be extended to variables

Many test statistics, scores, and estimators encountered in practice contain sums of certain random variables in them, and even more estimators can be represented as sums of random variables through the use of influence functions. The central limit theorem implies that those statistical parameters will have asymptotically normal distributions.

The central limit theorem also implies that certain distributions can be approximated by the normal distribution, for example:

Whether these approximations are sufficiently accurate depends on the purpose for which they are needed, and the rate of convergence to the normal distribution. It is typically the case that such approximations are less accurate in the tails of the distribution.

A general upper bound for the approximation error in the central limit theorem is given by the Berry–Esseen theorem, improvements of the approximation are given by the Edgeworth expansions.

This theorem can also be used to justify modeling the sum of many uniform noise sources as Gaussian noise. See AWGN.

Operations and functions of normal variables[edit]

a: Probability density of a function

The probability density, cumulative distribution, and inverse cumulative distribution of any function of one or more independent or correlated normal variables can be computed with the numerical method of ray-tracing[35] (Matlab code). In the following sections we look at some special cases.

Operations on a single normal variable[edit]

If

, for any real numbers

and

, is also normally distributed, with mean

and standard deviation

. That is, the family of normal distributions is closed under linear transformations.

- The exponential of

is distributed log-normally: eX ~ ln(N (μ, σ2)).

- The absolute value of

has folded normal distribution: |X| ~ Nf (μ, σ2). If

this is known as the half-normal distribution.

- The absolute value of normalized residuals, |X − μ|/σ, has chi distribution with one degree of freedom:

.

- The square of X/σ has the noncentral chi-squared distribution with one degree of freedom:

. If

, the distribution is called simply chi-squared.

- The log-likelihood of a normal variable

is simply the log of its probability density function:

Since this is a scaled and shifted square of a standard normal variable, it is distributed as a scaled and shifted chi-squared variable.

- The distribution of the variable X restricted to an interval [a, b] is called the truncated normal distribution.

- (X − μ)−2 has a Lévy distribution with location 0 and scale σ−2.

Operations on two independent normal variables[edit]

- If

and

are two independent normal random variables, with means

,

and standard deviations

,

, then their sum

will also be normally distributed,[proof] with mean

and variance

.

- In particular, if

and

are independent normal deviates with zero mean and variance

, then

and

are also independent and normally distributed, with zero mean and variance

. This is a special case of the polarization identity.[36]

- If

,

are two independent normal deviates with mean

and deviation

, and

,

are arbitrary real numbers, then the variable

is also normally distributed with mean

and deviation

. It follows that the normal distribution is stable (with exponent

).

Operations on two independent standard normal variables[edit]

If

Operations on multiple independent normal variables[edit]

[edit]

- A quadratic form of a normal vector, i.e. a quadratic function

of multiple independent or correlated normal variables, is a generalized chi-square variable.

Operations on the density function[edit]

The split normal distribution is most directly defined in terms of joining scaled sections of the density functions of different normal distributions and rescaling the density to integrate to one. The truncated normal distribution results from rescaling a section of a single density function.

Infinite divisibility and Cramér’s theorem[edit]

For any positive integer

Conversely, if

This result is known as Cramér’s decomposition theorem, and is equivalent to saying that the convolution of two distributions is normal if and only if both are normal. Cramér’s theorem implies that a linear combination of independent non-Gaussian variables will never have an exactly normal distribution, although it may approach it arbitrarily closely.[28]

Bernstein’s theorem[edit]

Bernstein’s theorem states that if

More generally, if

Extensions[edit]

The notion of normal distribution, being one of the most important distributions in probability theory, has been extended far beyond the standard framework of the univariate (that is one-dimensional) case (Case 1). All these extensions are also called normal or Gaussian laws, so a certain ambiguity in names exists.

- The multivariate normal distribution describes the Gaussian law in the k-dimensional Euclidean space. A vector X ∈ Rk is multivariate-normally distributed if any linear combination of its components Σk

j=1aj Xj has a (univariate) normal distribution. The variance of X is a k×k symmetric positive-definite matrix V. The multivariate normal distribution is a special case of the elliptical distributions. As such, its iso-density loci in the k = 2 case are ellipses and in the case of arbitrary k are ellipsoids. - Rectified Gaussian distribution a rectified version of normal distribution with all the negative elements reset to 0

- Complex normal distribution deals with the complex normal vectors. A complex vector X ∈ Ck is said to be normal if both its real and imaginary components jointly possess a 2k-dimensional multivariate normal distribution. The variance-covariance structure of X is described by two matrices: the variance matrix Γ, and the relation matrix C.

- Matrix normal distribution describes the case of normally distributed matrices.

- Gaussian processes are the normally distributed stochastic processes. These can be viewed as elements of some infinite-dimensional Hilbert space H, and thus are the analogues of multivariate normal vectors for the case k = ∞. A random element h ∈ H is said to be normal if for any constant a ∈ H the scalar product (a, h) has a (univariate) normal distribution. The variance structure of such Gaussian random element can be described in terms of the linear covariance operator K: H → H. Several Gaussian processes became popular enough to have their own names:

- Brownian motion,

- Brownian bridge,

- Ornstein–Uhlenbeck process.

- Gaussian q-distribution is an abstract mathematical construction that represents a «q-analogue» of the normal distribution.

- the q-Gaussian is an analogue of the Gaussian distribution, in the sense that it maximises the Tsallis entropy, and is one type of Tsallis distribution. Note that this distribution is different from the Gaussian q-distribution above.

- The Kaniadakis κ-Gaussian distribution is a generalization of the Gaussian distribution which arises from the Kaniadakis statistics, being one of the Kaniadakis distributions.

A random variable X has a two-piece normal distribution if it has a distribution

where μ is the mean and σ1 and σ2 are the standard deviations of the distribution to the left and right of the mean respectively.

The mean, variance and third central moment of this distribution have been determined[45]

where E(X), V(X) and T(X) are the mean, variance, and third central moment respectively.

One of the main practical uses of the Gaussian law is to model the empirical distributions of many different random variables encountered in practice. In such case a possible extension would be a richer family of distributions, having more than two parameters and therefore being able to fit the empirical distribution more accurately. The examples of such extensions are:

- Pearson distribution — a four-parameter family of probability distributions that extend the normal law to include different skewness and kurtosis values.

- The generalized normal distribution, also known as the exponential power distribution, allows for distribution tails with thicker or thinner asymptotic behaviors.

Statistical inference[edit]

Estimation of parameters[edit]

It is often the case that we do not know the parameters of the normal distribution, but instead want to estimate them. That is, having a sample

Taking derivatives with respect to

Sample mean[edit]

Estimator

The variance of this estimator is equal to the μμ-element of the inverse Fisher information matrix

From the standpoint of the asymptotic theory,

Sample variance[edit]

The estimator

The difference between

The first of these expressions shows that the variance of

Applying the asymptotic theory, both estimators

In particular, both estimators are asymptotically efficient for

Confidence intervals[edit]

By Cochran’s theorem, for normal distributions the sample mean

This quantity t has the Student’s t-distribution with (n − 1) degrees of freedom, and it is an ancillary statistic (independent of the value of the parameters). Inverting the distribution of this t-statistics will allow us to construct the confidence interval for μ;[47] similarly, inverting the χ2 distribution of the statistic s2 will give us the confidence interval for σ2:[48]

where tk,p and χ 2

k,p are the pth quantiles of the t— and χ2-distributions respectively. These confidence intervals are of the confidence level 1 − α, meaning that the true values μ and σ2 fall outside of these intervals with probability (or significance level) α. In practice people usually take α = 5%, resulting in the 95% confidence intervals.

Approximate formulas can be derived from the asymptotic distributions of

The approximate formulas become valid for large values of n, and are more convenient for the manual calculation since the standard normal quantiles zα/2 do not depend on n. In particular, the most popular value of α = 5%, results in |z0.025| = 1.96.

Normality tests[edit]

Normality tests assess the likelihood that the given data set {x1, …, xn} comes from a normal distribution. Typically the null hypothesis H0 is that the observations are distributed normally with unspecified mean μ and variance σ2, versus the alternative Ha that the distribution is arbitrary. Many tests (over 40) have been devised for this problem. The more prominent of them are outlined below:

Diagnostic plots are more intuitively appealing but subjective at the same time, as they rely on informal human judgement to accept or reject the null hypothesis.

- Q–Q plot, also known as normal probability plot or rankit plot—is a plot of the sorted values from the data set against the expected values of the corresponding quantiles from the standard normal distribution. That is, it’s a plot of point of the form (Φ−1(pk), x(k)), where plotting points pk are equal to pk = (k − α)/(n + 1 − 2α) and α is an adjustment constant, which can be anything between 0 and 1. If the null hypothesis is true, the plotted points should approximately lie on a straight line.

- P–P plot – similar to the Q–Q plot, but used much less frequently. This method consists of plotting the points (Φ(z(k)), pk), where

. For normally distributed data this plot should lie on a 45° line between (0, 0) and (1, 1).

Goodness-of-fit tests:

Moment-based tests:

- D’Agostino’s K-squared test

- Jarque–Bera test

- Shapiro–Wilk test: This is based on the fact that the line in the Q–Q plot has the slope of σ. The test compares the least squares estimate of that slope with the value of the sample variance, and rejects the null hypothesis if these two quantities differ significantly.

Tests based on the empirical distribution function:

- Anderson–Darling test

- Lilliefors test (an adaptation of the Kolmogorov–Smirnov test)

Bayesian analysis of the normal distribution[edit]

Bayesian analysis of normally distributed data is complicated by the many different possibilities that may be considered:

- Either the mean, or the variance, or neither, may be considered a fixed quantity.

- When the variance is unknown, analysis may be done directly in terms of the variance, or in terms of the precision, the reciprocal of the variance. The reason for expressing the formulas in terms of precision is that the analysis of most cases is simplified.

- Both univariate and multivariate cases need to be considered.

- Either conjugate or improper prior distributions may be placed on the unknown variables.

- An additional set of cases occurs in Bayesian linear regression, where in the basic model the data is assumed to be normally distributed, and normal priors are placed on the regression coefficients. The resulting analysis is similar to the basic cases of independent identically distributed data.

The formulas for the non-linear-regression cases are summarized in the conjugate prior article.

Sum of two quadratics[edit]

Scalar form[edit]

The following auxiliary formula is useful for simplifying the posterior update equations, which otherwise become fairly tedious.

This equation rewrites the sum of two quadratics in x by expanding the squares, grouping the terms in x, and completing the square. Note the following about the complex constant factors attached to some of the terms:

- The factor

has the form of a weighted average of y and z.

This shows that this factor can be thought of as resulting from a situation where the reciprocals of quantities a and b add directly, so to combine a and b themselves, it’s necessary to reciprocate, add, and reciprocate the result again to get back into the original units. This is exactly the sort of operation performed by the harmonic mean, so it is not surprising that

is one-half the harmonic mean of a and b.

Vector form[edit]

A similar formula can be written for the sum of two vector quadratics: If x, y, z are vectors of length k, and A and B are symmetric, invertible matrices of size

where

Note that the form x′ A x is called a quadratic form and is a scalar:

In other words, it sums up all possible combinations of products of pairs of elements from x, with a separate coefficient for each. In addition, since

Sum of differences from the mean[edit]

Another useful formula is as follows:

where

With known variance[edit]

For a set of i.i.d. normally distributed data points X of size n where each individual point x follows

This can be shown more easily by rewriting the variance as the precision, i.e. using τ = 1/σ2. Then if

First, the likelihood function is (using the formula above for the sum of differences from the mean):

Then, we proceed as follows:

In the above derivation, we used the formula above for the sum of two quadratics and eliminated all constant factors not involving μ. The result is the kernel of a normal distribution, with mean

This can be written as a set of Bayesian update equations for the posterior parameters in terms of the prior parameters:

That is, to combine n data points with total precision of nτ (or equivalently, total variance of n/σ2) and mean of values

The above formula reveals why it is more convenient to do Bayesian analysis of conjugate priors for the normal distribution in terms of the precision. The posterior precision is simply the sum of the prior and likelihood precisions, and the posterior mean is computed through a precision-weighted average, as described above. The same formulas can be written in terms of variance by reciprocating all the precisions, yielding the more ugly formulas

With known mean[edit]

For a set of i.i.d. normally distributed data points X of size n where each individual point x follows

The likelihood function from above, written in terms of the variance, is:

where

Then:

The above is also a scaled inverse chi-squared distribution where

or equivalently

Reparameterizing in terms of an inverse gamma distribution, the result is:

With unknown mean and unknown variance[edit]

For a set of i.i.d. normally distributed data points X of size n where each individual point x follows

Logically, this originates as follows:

- From the analysis of the case with unknown mean but known variance, we see that the update equations involve sufficient statistics computed from the data consisting of the mean of the data points and the total variance of the data points, computed in turn from the known variance divided by the number of data points.

- From the analysis of the case with unknown variance but known mean, we see that the update equations involve sufficient statistics over the data consisting of the number of data points and sum of squared deviations.

- Keep in mind that the posterior update values serve as the prior distribution when further data is handled. Thus, we should logically think of our priors in terms of the sufficient statistics just described, with the same semantics kept in mind as much as possible.

- To handle the case where both mean and variance are unknown, we could place independent priors over the mean and variance, with fixed estimates of the average mean, total variance, number of data points used to compute the variance prior, and sum of squared deviations. Note however that in reality, the total variance of the mean depends on the unknown variance, and the sum of squared deviations that goes into the variance prior (appears to) depend on the unknown mean. In practice, the latter dependence is relatively unimportant: Shifting the actual mean shifts the generated points by an equal amount, and on average the squared deviations will remain the same. This is not the case, however, with the total variance of the mean: As the unknown variance increases, the total variance of the mean will increase proportionately, and we would like to capture this dependence.

- This suggests that we create a conditional prior of the mean on the unknown variance, with a hyperparameter specifying the mean of the pseudo-observations associated with the prior, and another parameter specifying the number of pseudo-observations. This number serves as a scaling parameter on the variance, making it possible to control the overall variance of the mean relative to the actual variance parameter. The prior for the variance also has two hyperparameters, one specifying the sum of squared deviations of the pseudo-observations associated with the prior, and another specifying once again the number of pseudo-observations. Note that each of the priors has a hyperparameter specifying the number of pseudo-observations, and in each case this controls the relative variance of that prior. These are given as two separate hyperparameters so that the variance (aka the confidence) of the two priors can be controlled separately.